实测,本地大模型控制台:本地部署、数据集管理、训练+微调,一站式搞定,Windows 也支持

实测,本地大模型控制台:本地部署、数据集管理、训练+微调,一站式搞定,Windows 也支持

Ai学习的老章

发布于 2026-03-27 12:49:34

发布于 2026-03-27 12:49:34

Unsltoh 刚刚放出的 Studio 有点东西

大模型下载、运行、训练、微调、导出、数据集处理都串起来到了统一入口

还有个示例:Qwen3.5-4B 搜索了 20 多个网站,引用了其来源,并找到了最佳答案!

通过 Unsloth Studio 仅用 4GB RAM 本地运行, 4B 模型通过在思考过程中直接执行工具调用+网络搜索实现

简介

一句话说,Unsloth Studio 是 一个本地 Web UI,用来统一做模型运行、数据处理、训练和导出

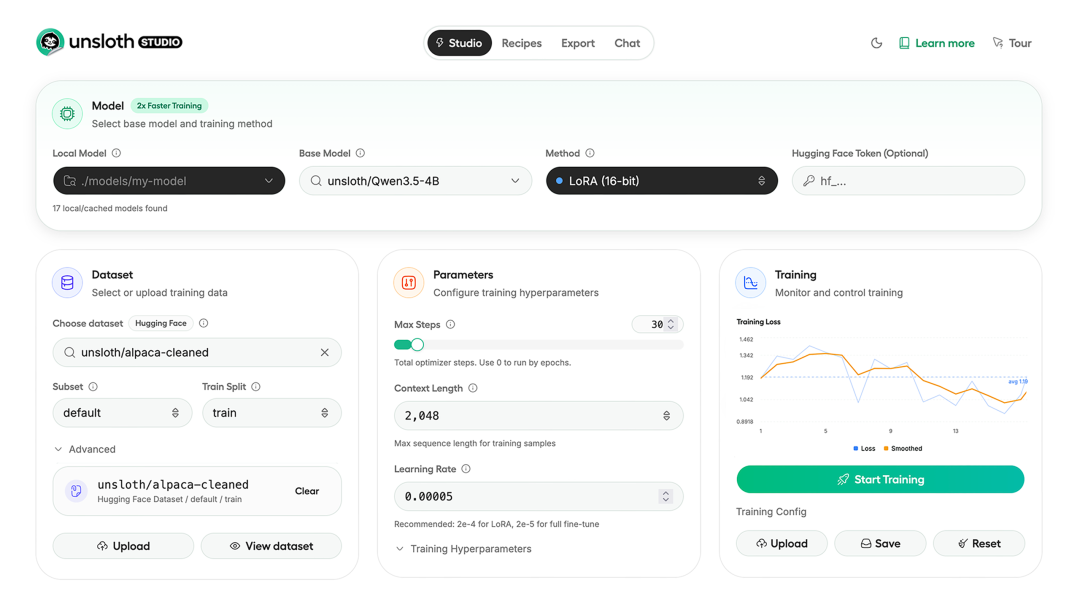

下图是官方 README 给出的主界面截图,整体就是一个很典型的本地 AI 控制台:

Unsloth Studio 主界面

Unsloth Studio 主界面

- 模型支持: 本地运行 GGUF 和 safetensors 格式的模型,支持文本、视觉、TTS、Embedding 等多种模型类型

- 平台兼容: 支持 Windows、Mac、Linux 系统

- 训练与微调: 提供数据集整理与生成、训练过程可视化、模型对比(Model Arena)功能,并可使用 AI 助手对音频、视觉、LLM 进行微调,支持导出 GGUF 和 safetensors 模型

- 数据工具: 提供数据设计、合成数据生成、快速并行数据准备及嵌入微调工具

- 交互界面: 聊天界面集成自动修复、工具调用、Python & Bash 代码执行、网络搜索、以及图像与文档输入功能

这类产品最怕的一点就是摊子铺得很大,最后每一块都只做了个皮毛

但 Unsloth Studio 现在给我的感觉是,方向对了,而且它抓的几个点很懂实际用户:

- 你可以直接搜模型、跑模型

- 你可以上传 PDF、CSV、JSON、DOCX 这些文件

- 你可以把训练后的模型继续导出到 llama.cpp、vLLM、Ollama 这些栈里

- 它甚至把 Tool Calling、Web Search、代码执行也放进了 Studio Chat

对于“我既想本地跑一下,又想继续微调一下,再顺手导出来接现有系统”的用户,这套思路很顺

功能亮点

我把最值得关注的几个点拎出来

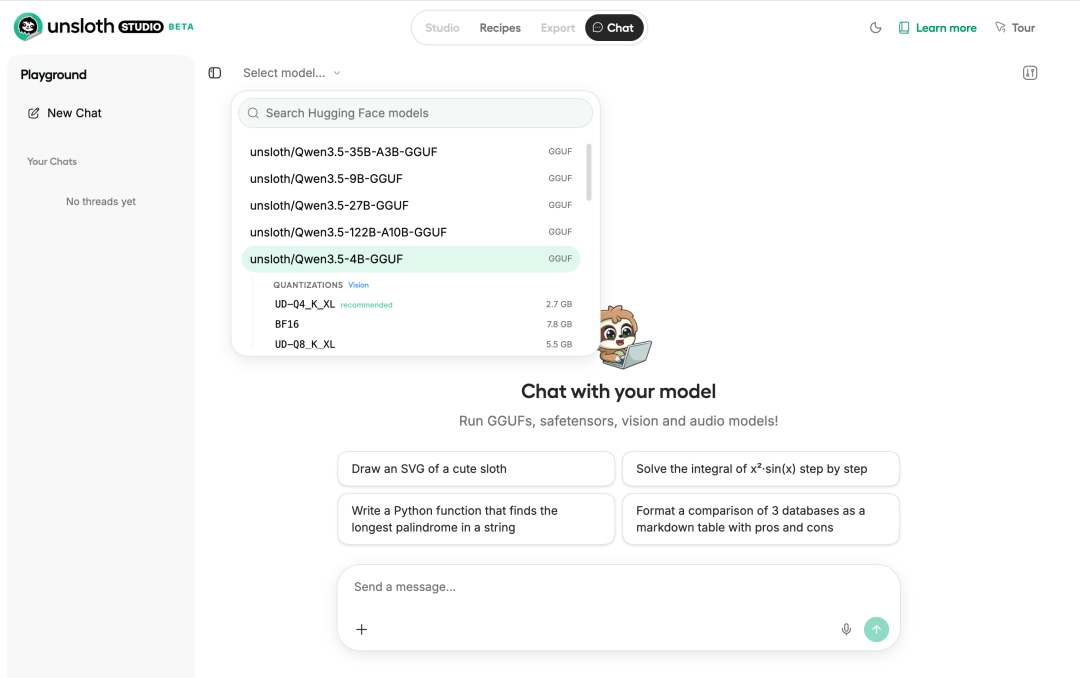

1. 本地跑大模型,入口更统一了

它支持搜索和运行 GGUF、safetensors 模型,也支持图片、文档、音频、代码文件上传。

把“本地模型桌面化”,风格上很像把本地模型管理、聊天、参数调节整合到了一起:

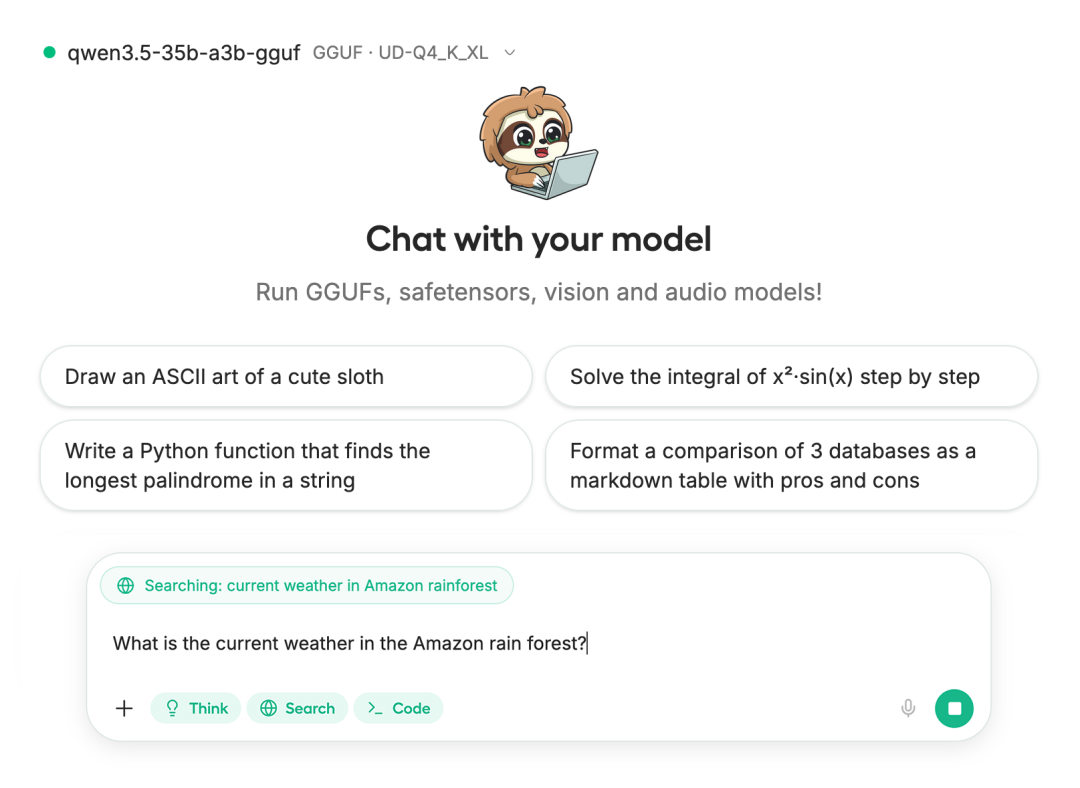

Unsloth Studio 运行模型界面

Unsloth Studio 运行模型界面

2. 它把 Tool Calling 和代码执行也塞进来了

这一点我挺喜欢

很多本地 UI 做到聊天就停了,能跑工具、能执行 Bash 和 Python 的并不多。

Unsloth Studio 支持代码执行、Web Search,以及所谓的 self-healing tool calling。

这个方向一旦成熟,对本地 Agent 会非常有意思

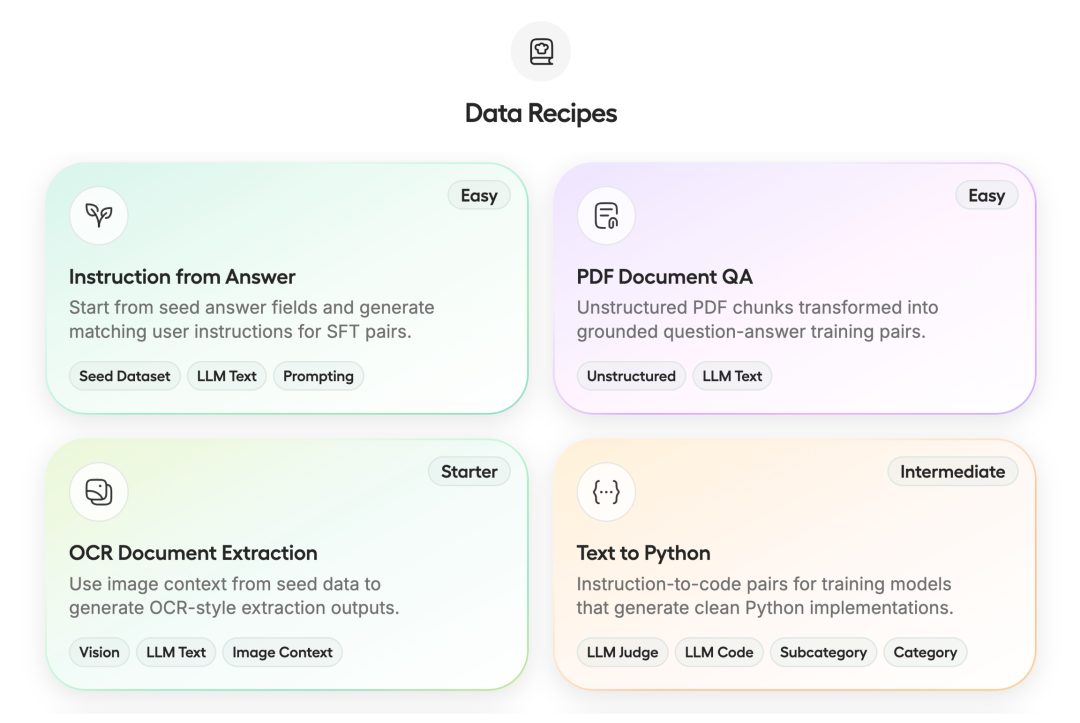

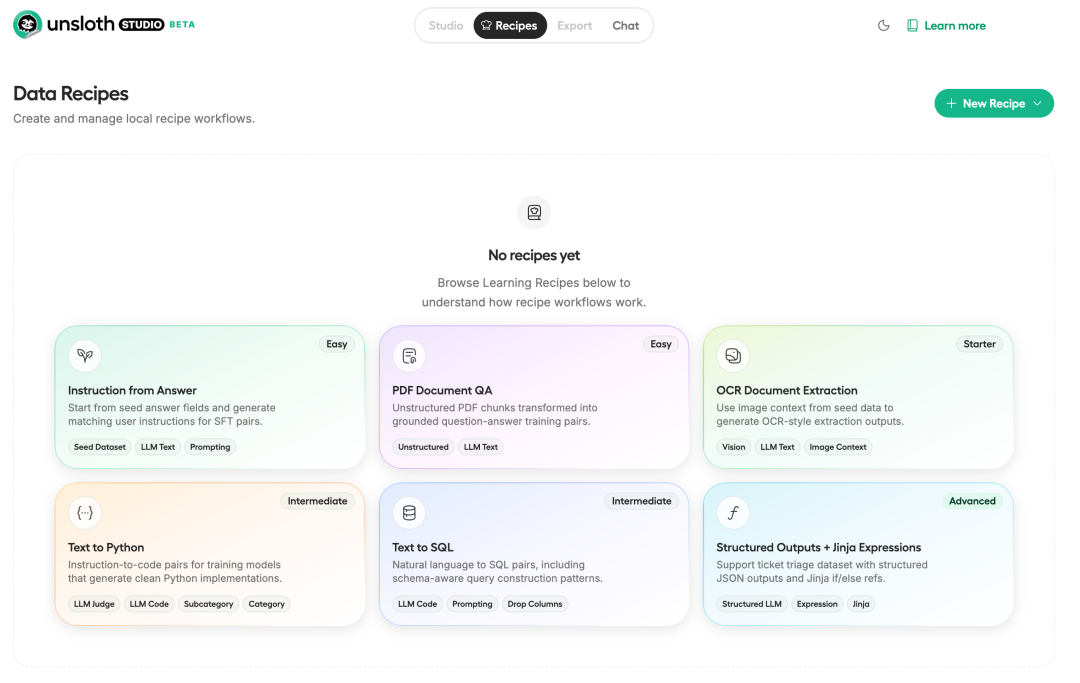

3. Data Recipes 很像它的隐藏大招

官方一直在强调 Data Recipes

简单理解,就是你把 PDF、CSV、JSON 这些资料丢进去,它帮你转成可用的数据集,走的是图节点工作流,底层是 NVIDIA Nemo Data Designer

如果它后续稳定下来,这个价值其实不小

因为大量微调项目最麻烦的环节,就是前面那堆数据整理

官方截图如下:

Unsloth Studio Data Recipes

Unsloth Studio Data Recipes

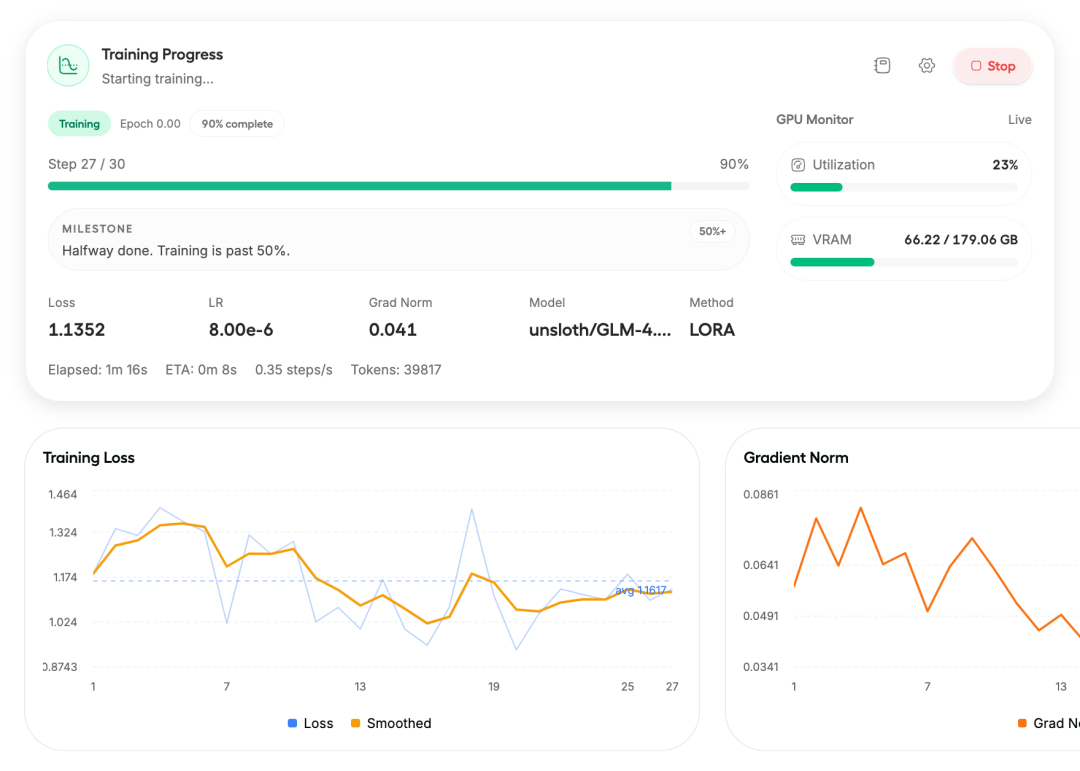

4. 训练过程可视化和导出能力也做进去了

这两块我觉得挺实用:

- Observability:实时看训练 loss、gradient norm、GPU 使用率

- Export / Save models:导出 GGUF、16-bit safetensors,继续接 llama.cpp、vLLM、Ollama

这就很像一个真正围绕“训练闭环”做的产品,而不是单纯套了一层聊天壳子

Unsloth Studio Observability

Unsloth Studio Observability

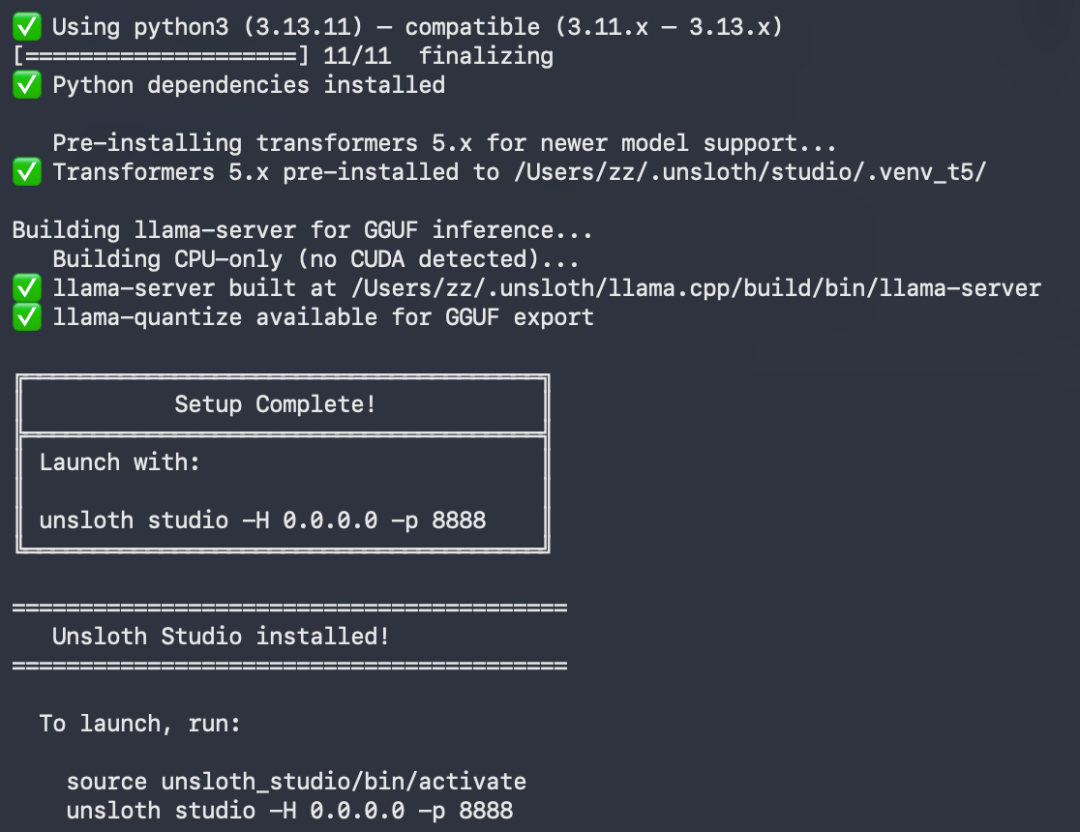

安装

安装方式非常直接,MacOS、Linux、WSL:

curl -fsSL https://raw.githubusercontent.com/unslothai/unsloth/main/install.sh | sh

它做了下面几件事:

- 检查系统依赖,比如

cmake、git - 自动安装

uv - 创建名为

unsloth_studio的虚拟环境 - 执行

uv pip install unsloth --torch-backend=auto - 最后再跑

unsloth studio setup

Windows Powershell

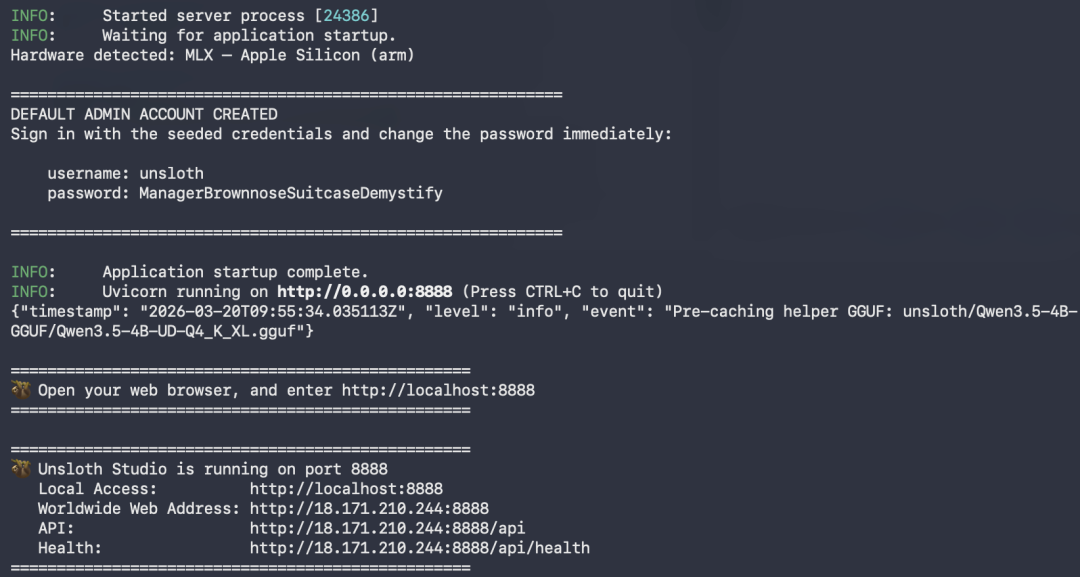

安装完成后,启动命令如下:

source unsloth_studio/bin/activate

unsloth studio -H 0.0.0.0 -p 8888

浏览器打开:

http://localhost:8888

首次启动会要求你创建密码,然后进入一个 onboarding 向导,选择模型、数据集和一些基础配置

安装体验

这条一键命令确实省心,但首装并不算快

我这边日志里,依赖解析就花了大约 2 分钟,随后开始下载和安装 torch、transformers、pyarrow、tokenizers、diffusers、unsloth 等包。

你如果看到终端一段时间没有明显新输出,不用太慌,大概率还在后台继续拉依赖。

我这次在本机实测时,一键安装脚本跑了 35 分钟,进程依然停留在 uv pip install unsloth --torch-backend=auto 这一步。

官方文档里也专门提醒了首装可能需要 5 到 10 分钟,原因是后面还会涉及 llama.cpp 相关构建。

这一点我很建议大家有点耐心,别看到安静了就顺手 Ctrl + C。但如果你本地也卡到半小时以上,我建议你去看一下网络、镜像源、磁盘空间,以及 uv 的下载缓存。

一个需要注意的小细节

更新说明里,官方写了 MacOS 和 CPU 已经启用了 Data Recipes;

但安装页和系统要求页里,又依然写着 Mac 和 CPU 当前主要支持 Chat,训练部分还要再等等。

所以更稳妥的理解方式是:

- Windows、Linux、WSL 是当前主战场

- NVIDIA GPU 用户可以把训练能力作为重点来看

- Mac 用户当前先把它当成本地聊天和工作流入口

适合谁

下面这几类用户,我觉得 Unsloth Studio 很值得盯一下:

- 想本地跑模型,又不想一直在命令行里切来切去

- 已经在玩 GGUF、Ollama、llama.cpp、vLLM,想找一个统一入口

- 想从“跑模型”继续往“做数据、做训练、做导出”再走一步

- 想研究本地 Agent、Tool Calling、代码执行这类能力

如果你只是想要一个极致稳定、只负责聊天的本地工具,那它当前这个 Beta 状态还需要你多一点耐心。

总结

Unsloth Studio 最吸引我的地方,在于它试图把本地 AI 这条链路真正串起来,单点功能反而不是我最看重的部分。

从聊天,到数据准备,到训练,到可视化,到导出,这条路径如果真被它打通,那它就很有机会成为本地 AI 工作台里的重要玩家。

#Unsloth #UnslothStudio #本地部署 #大模型 #GGUF #Agent

制作不易,如果这篇文章觉得对你有用,可否点个关注。给我个三连击:点赞、转发和在看。若可以再给我加个🌟,谢谢你看我的文章,我们下篇再见!

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-03-22,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录