大家都在防 AI 偷内容,先消失的可能是互联网记忆

大家都在防 AI 偷内容,先消失的可能是互联网记忆

随机比特

发布于 2026-03-30 16:40:33

发布于 2026-03-30 16:40:33

这两个月,越来越多网站开始拦 AI 抓取。

这件事听上去完全合理。 谁都不想自己花钱做出来的内容,最后变成模型的免费燃料。

但真正让我警惕的,不是平台开始反击。 而是反击的边界,正在变得越来越粗。

因为现在被一起挡在门外的,已经不只是 AI 公司。 连 Internet Archive 这样的保存机构,也开始进不去了。

问题到这里就变了。

模型少抓一点内容,最多只是少吃一口数据。 可如果网页旧版本、删改记录、历史页面也没人再保存,后面真正消失的,是我们回头查证一件事到底有没有发生过的能力。

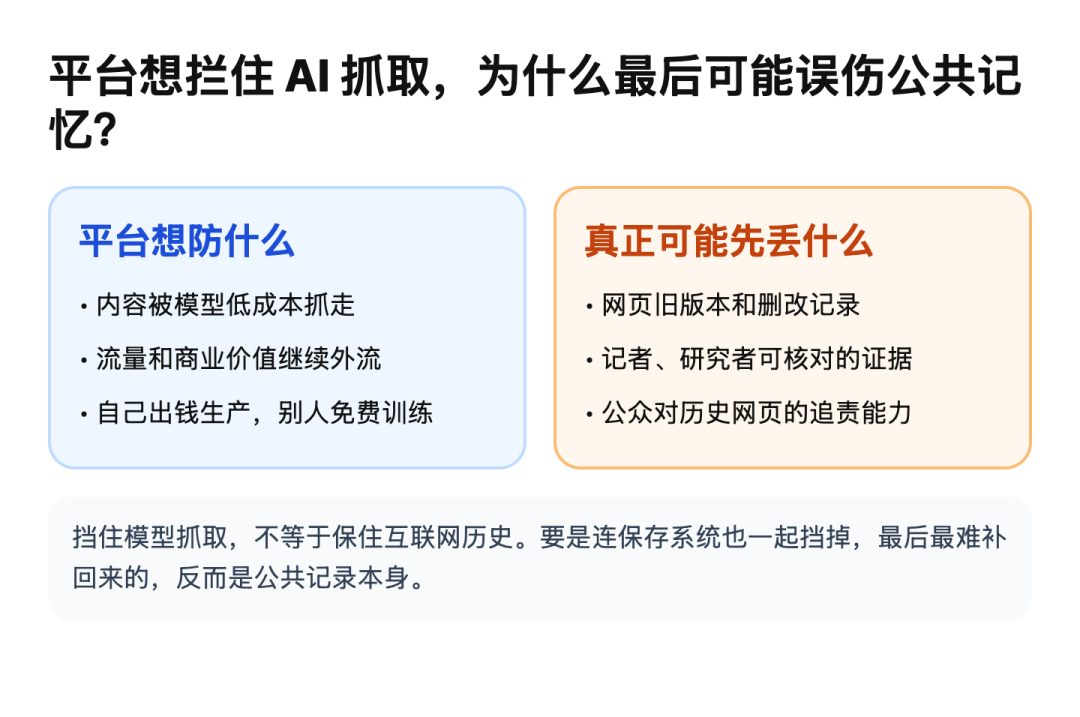

01-compare

这不是技术圈小事,而是互联网的“记忆层”在变薄

Nieman Lab 今年 1 月的一篇报道提到,来自 9 个国家的 241 家新闻网站,已经明确禁止至少一种 Internet Archive 爬虫访问。

这背后的原因也不难理解。 很多出版机构担心,AI 公司会把 Wayback Machine 当成一个更容易下手的后门,把内容批量抽走。

从出版方视角看,这种焦虑完全成立。 今天的内容行业,本来就在同时面对三件事:

第一,内容生产成本越来越高。 第二,流量分发权越来越弱。 第三,AI 公司又想把现成内容继续拿去训练、摘要、改写。

所以平台一看到“爬虫”,本能就是先挡再说。

问题是,Internet Archive 不是普通意义上的 AI 爬虫。

它的作用更接近一个公共保存层。 很多网页今天还在,明天就可能改版、删稿、404、换口径。 如果没有人把这些版本保存下来,互联网上很多东西就会像从来没存在过一样。

真正会先受伤的,不是模型,而是追责能力

这件事最容易被低估的地方在于: 大家会以为,少一个档案网站,最多只是“查资料没那么方便”。

其实远不止。

如果保存链路断掉,最先受影响的是三类人。

第一类,是记者

很多新闻追踪,靠的不是某一刻的截图,而是版本对比。 同一篇稿子改过什么,哪个页面删过哪句话,哪个机构什么时候换了表述,这些东西都要靠归档记录去核。

没有归档,很多“前后不一致”就很难证明。

第二类,是研究者

今天很多研究并不是缺观点,而是缺可验证的原始材料。 如果网页历史越来越残缺,研究就会越来越依赖二手转述。 二手转述一多,误差就会越来越大。

第三类,是普通读者

很多人平时不会主动打开档案站。 但你一定享受过它带来的结果: 有人帮你把删掉的承诺找回来,有人帮你把旧页面翻出来,有人帮你证明“这不是你记错了,是它真的改过”。

说白了,档案不是给少数极客用的,它本来就是公共讨论的证据底座。

这场冲突的真正难点,不是要不要保护内容

我不觉得这件事的答案是“大家都应该继续无条件开放”。

出版机构保护内容,没问题。 防 AI 公司偷数据,也没问题。

问题在于,今天很多防御动作是把所有访问者都压成同一种风险。

商业抓取、训练抓取、搜索抓取、保存抓取,在现实里其实不是一回事。 但平台在操作上,往往会用同一把锤子一起砸。

这样做短期最省事。 长期却会留下一个很麻烦的后果: 商业利益保住了一部分,公共记忆却被顺手削薄了。

Internet Archive 的 Mark Graham 讲得很直接。 他的核心意思不是“别管 AI 了”,而是: 如果因为 AI 抓取焦虑,把保存系统也一起封掉,最后伤到的是公共记录本身。

这句话我觉得特别重要。 因为它提醒我们,AI 时代真正稀缺的,未必只是内容生产能力。 更稀缺的,可能是:

- 还有没有人保存原始版本

- 这些记录以后还能不能访问

- 公众还能不能据此追责和校对

AI 时代最贵的基础设施之一,可能是“还在的历史记录”

过去我们谈 AI,喜欢谈模型、算力、芯片、数据中心。 这些当然都重要。

但今天我越来越觉得,还有一层基础设施被低估了: 可被验证、可被追溯、可被长期保存的公共知识。

如果这一层开始断裂,后果不是马上看得见的。 它更像一种慢性失忆。

今天少一页归档,明天少一段上下文,后天少一个版本对照。 再过一段时间,我们仍然拥有海量内容,却越来越难判断哪些是真的发生过,哪些只是后来被重新讲述过。

这才是我觉得最值得警惕的地方。

AI 不会因为少抓一点档案内容就停下来。 但如果互联网的历史记录越来越薄,未来的人要回头理解今天,成本会高很多。 而一个不能稳定保存自己历史的互联网,最后会变得非常好改写,也非常难追责。

所以,这件事真正该讨论的,不是“要不要挡”。 而是: 能不能把内容保护和公共保存拆开,别再用同一刀把两边一起砍掉。

不然到最后,我们可能真的会发现: 大家原本是想防 AI,结果先让互联网自己失忆了。

你觉得内容平台应该怎么平衡“防 AI 抓取”和“保留公共记录”?评论区聊聊。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-03-23,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录