利用腾讯云GPU服务器HAI搭建COMFYUI

原创很多同行都在本地部署COMFYUI,由于不能迁移,所以我就买了腾讯云的GPU服务器来搭建,下面分享我是如何搭建的,也消耗了一些时间摸索,所以分享出来给需要的人。我没有采用国内节点,阿里的魔搭,想原汁原味一点。

1、购买GPU服务器后,点击进入,选择云端环境Pytorch并安装

这里记得买韩国首尔的,不要买国内的,后面下载AI模型会特别慢,国内开了学术加速下载才4M,首尔的是11M,买错了要及时销毁应用,腾讯云是会给退款的。都是经验,就怕你们走弯路,呵呵。

系统会自动环境配置,自带Ubuntu20.04, Python 3.10, Pytorch 2.5.1, CUDA 12.4, cuDNN 9, JupyterLab, CloudStudio,这些都是必须的应用,不要卸载任何一个。

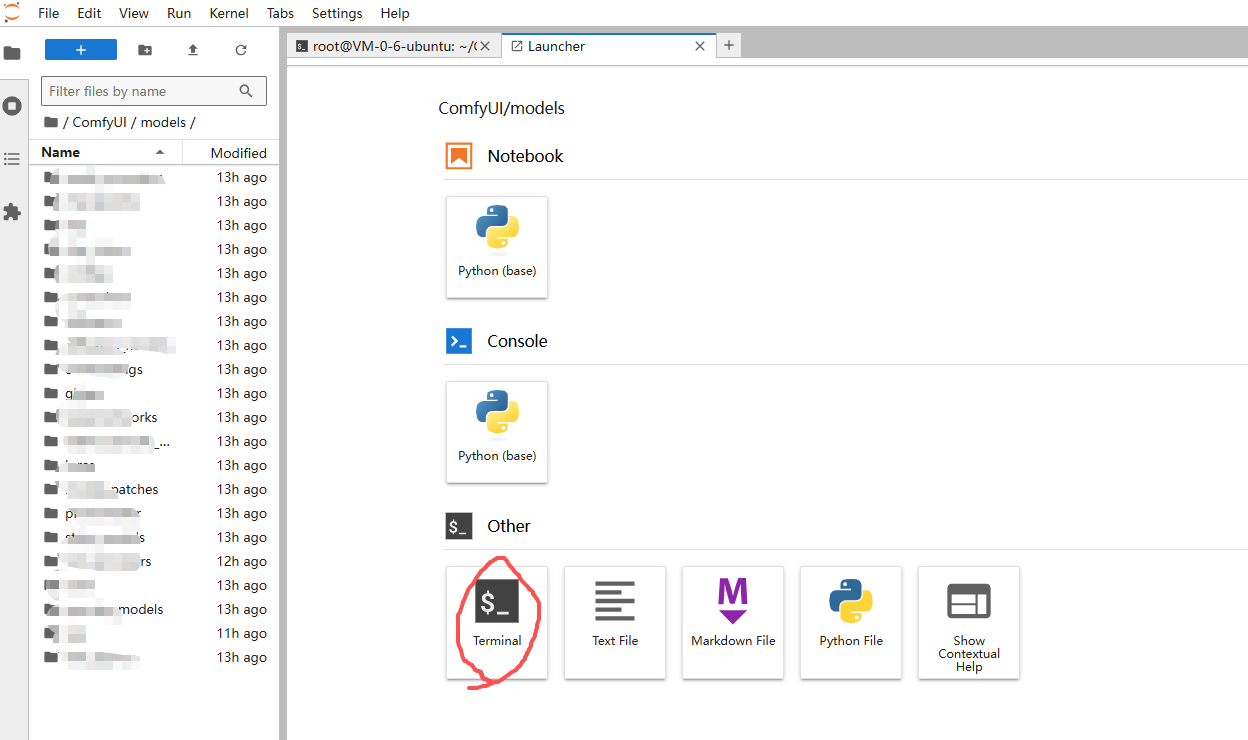

2、选择右侧JupyterLab,不要选择SSH需要重置密码,JupyterLab自带SSH不过是叫Terminal,点击就会进入操作界面,不过是通过指令操作的。

3、安装COMFYUI指令,要一行一行去执行。点击Terminal去执行代码。

① 克隆拉取 ComfyUI 仓库

cd /root

git clone https://github.com/comfyanonymous/ComfyUI.git

cd ComfyUI

② 安装依赖

pip install -r requirements.txt

由于已有 PyTorch 2.5.1 + CUDA 12.4,无需重复安装 torch,依赖会自动复用。

③ 启动 ComfyUI

python main.py --listen 0.0.0.0 --port 8188

④ 开放端口访问

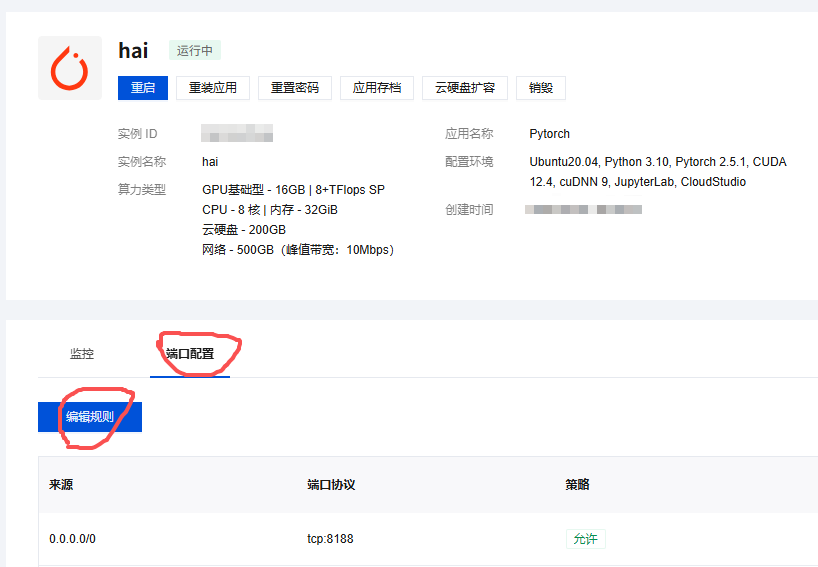

回到控制台,点击「端口配置」标签页

添加端口 8188,即可通过 http://你的服务器外网IP:8188 访问 ComfyUI

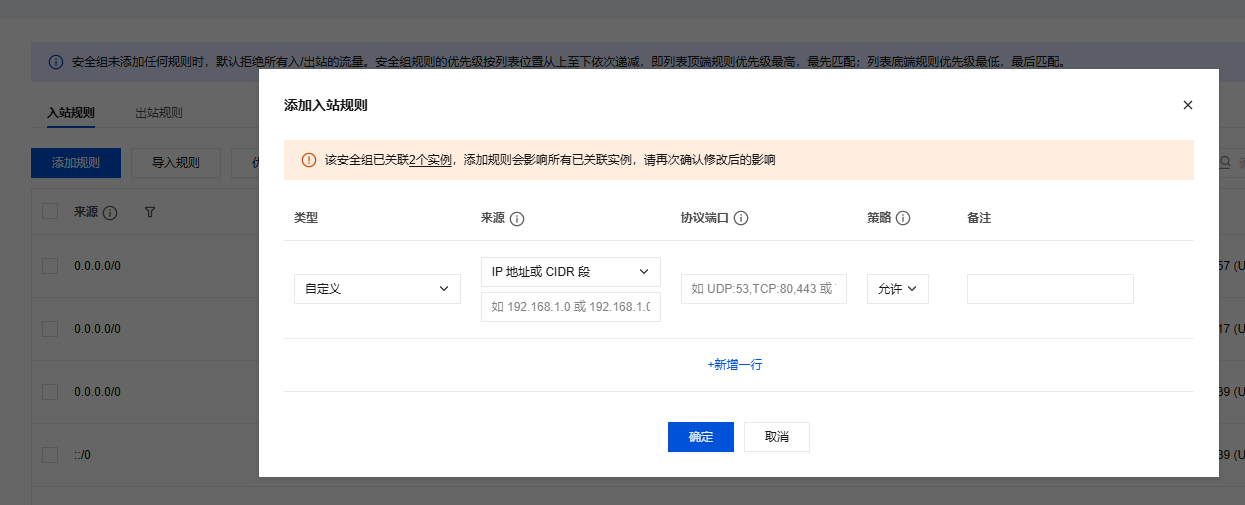

宽口配置-编辑规则-添加规则-来源0.0.0.0/0 协议端口TCP:8188-确定

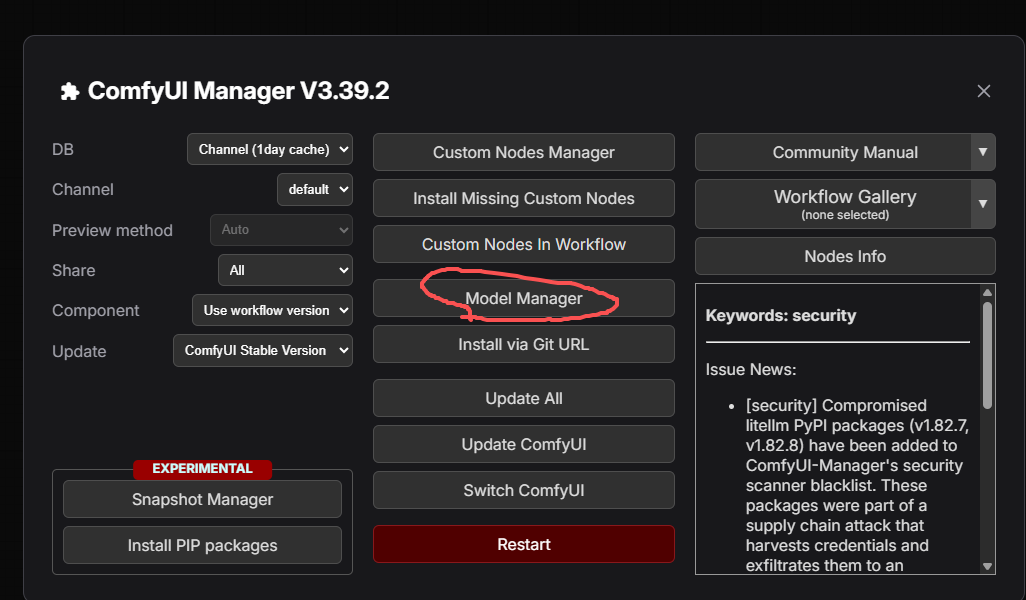

4、安装ComfyUI Manage,因为这个工具会让我们可以在线安装模型。代码一行一行的执行。

在 JupyterLab 终端中执行:

CTRL+C //这个是为了停止运行COMFYUI的,先停止再安装manager

cd /root/ComfyUI/custom_nodes

git clone https://github.com/ltdrdata/ComfyUI-Manager.git

cd ComfyUI-Manager

pip install -r requirements.txt

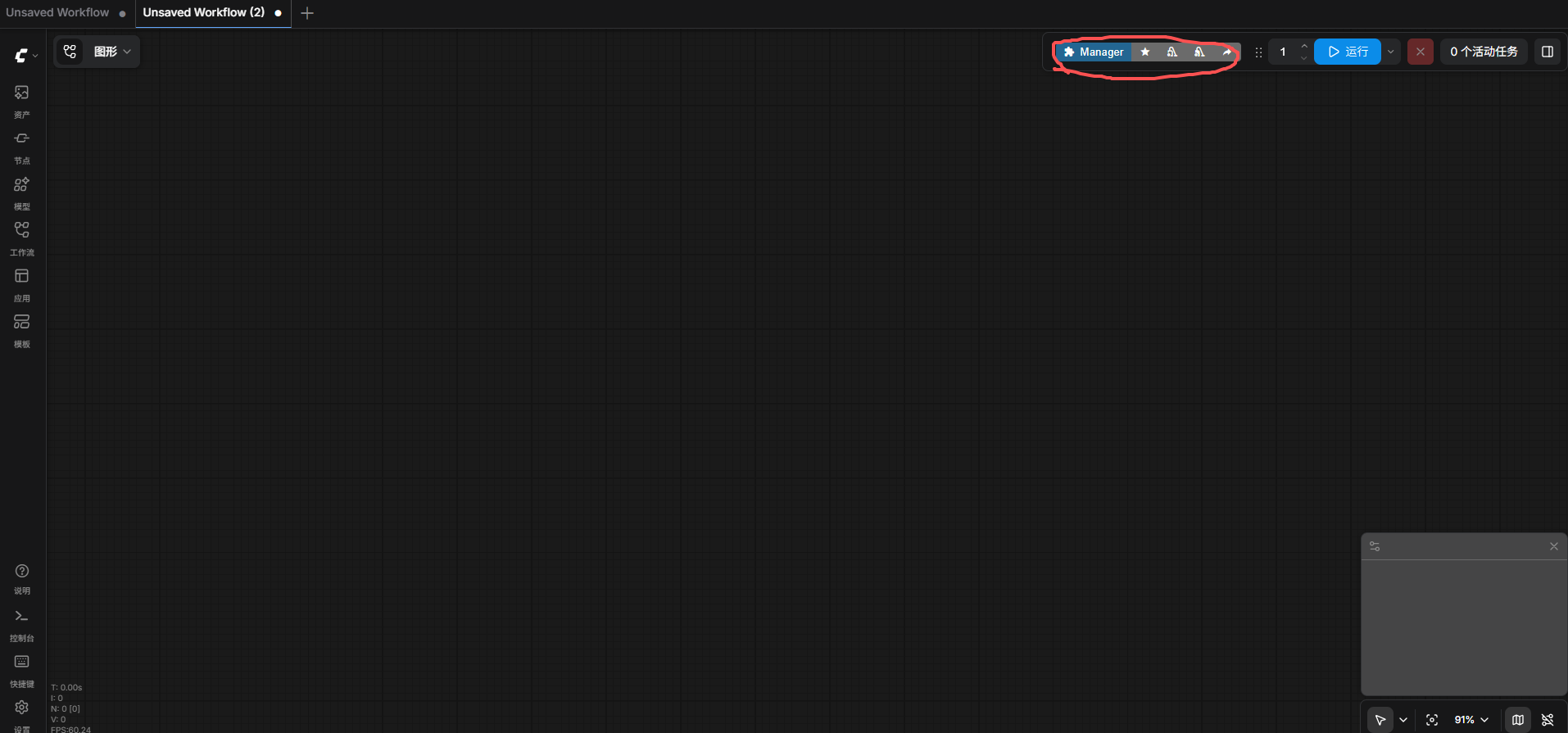

安装后重启 ComfyUI,界面右上角会出现 Manager 按钮

重启代码,一行一行的去执行。

cd /root/ComfyUI

python main.py --listen 0.0.0.0 --port 8188

最后浏览器访问自己的COMFYUI网址,就能看到界面了。网址是,外网IP:8188

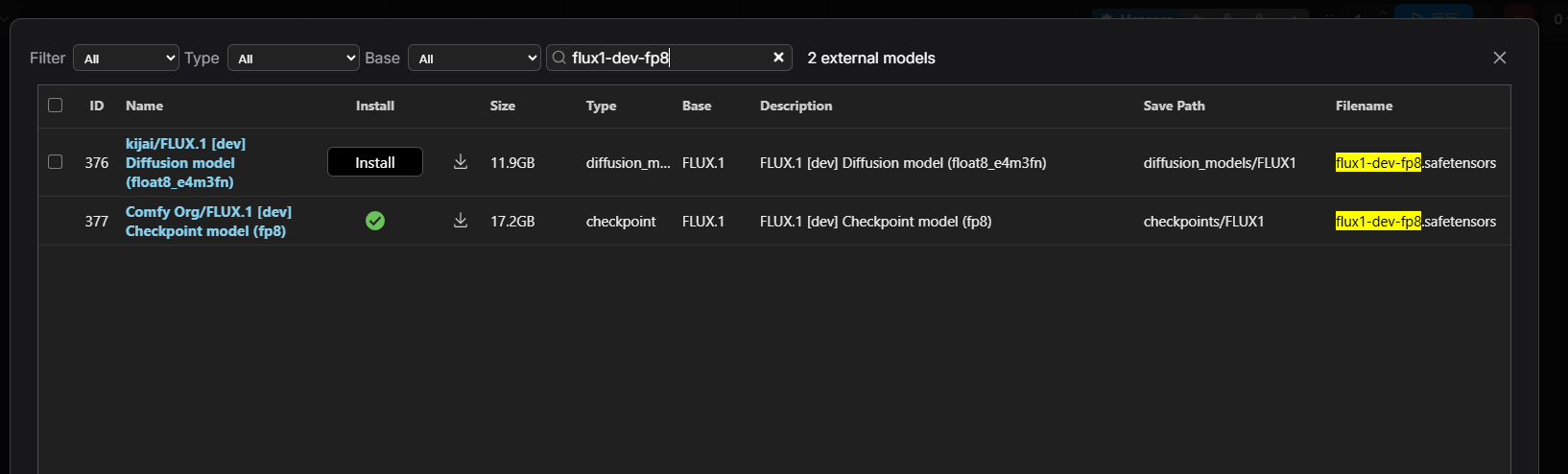

5、安装模型,点击manager,model manager ,搜索你想要的模型,我这里安装的是flux1-dev-fp8

你会看到我安装的是第二个,大小是17.2G,网速很重要,点install,安装完成后需要点RESTAR才行,这样才算安装好

我自己安装的是CHECKPOINT版本,它自带了自己的CLIP和VAE模型,如果你安装的是其他模型,必须去安装模型所需要的,提示词clip模型,和编码VAE模型,每个模型都需要有自己匹配的CLIP模型和VAE模型,不能用其他模型的CLIP和VAE,交叉使用效果会不好,甚至会产生很花的完全不能看的图片。

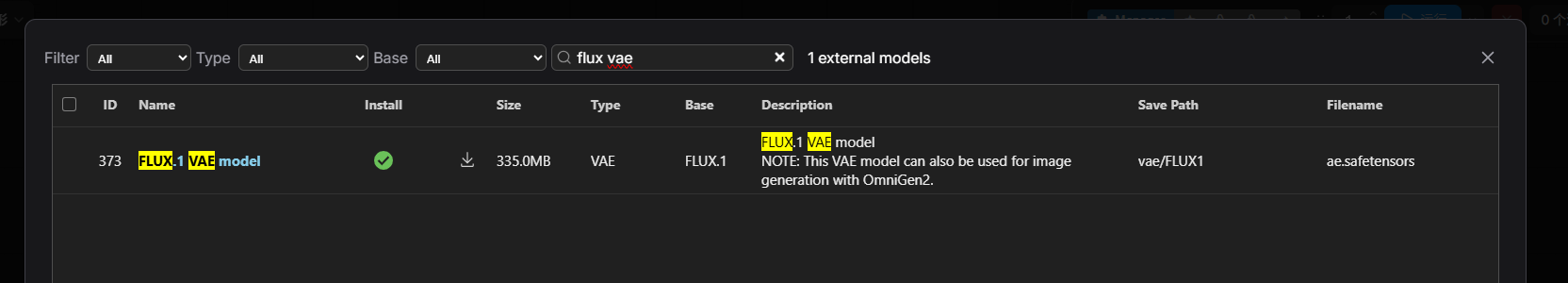

我们自己安装的是FLUX模型,我给大家演示一下,搜索自己的CLIP和VAE,搜索flux vae 安装后REFRESH,才算安装完成。

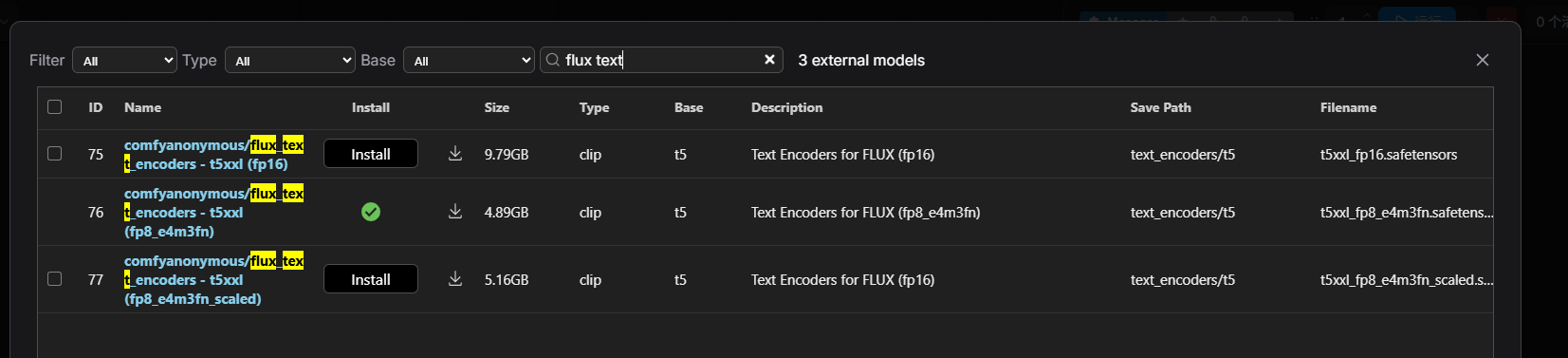

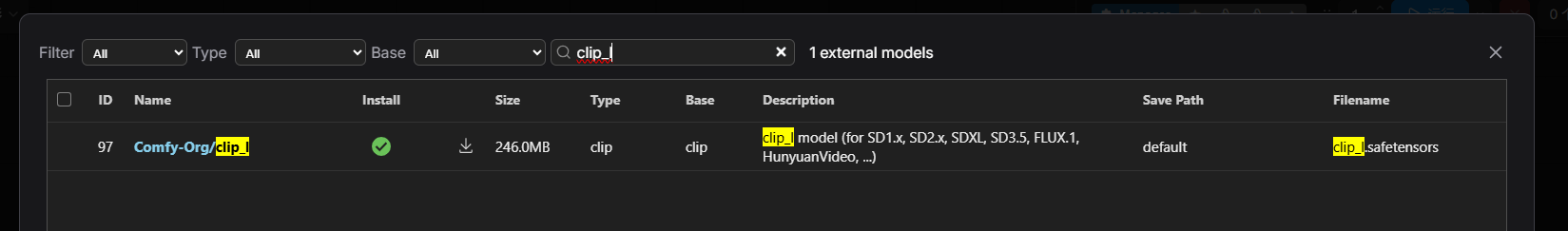

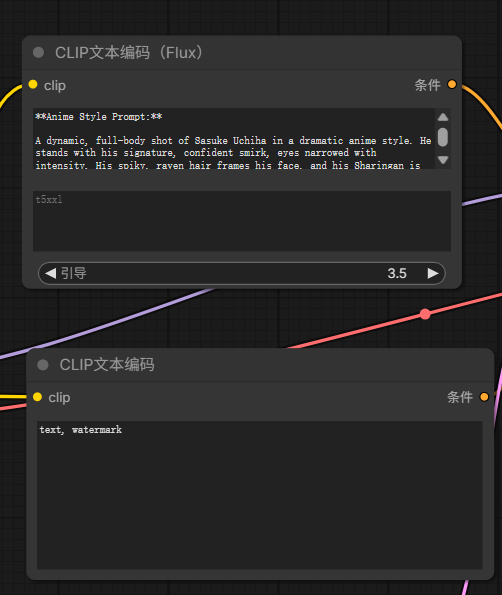

FLUX的提示词模型,搜flux text 安装后REFRESH,才算安装完成。之后再安装一个COMFYUI的提示词模型,因为我的FLUX会调用这2个提示词来完成一整个提示词,搜clip_l 安装后REFRESH ,可以看下面的图,可以看到FLUX提示词模型与普通提示词模型的区别。

看上下2个提示词框,上面是FLUX下面是一般的

6、安装VAE插曲,我在manager安装flux vae失败,提示无法抓取模型,谷歌后是因为模型官网进行了调整,需要有密钥才能抓取,所以这一步我是通过Terminal安装的,进入Hugging Face注册并获取密钥。

1. 获取 Access Token密钥

登录 Hugging Face。

确保你已经访问了 FLUX.1-schnell 页面 并点击了 "Agree and access repository" 接受条款。

点击个人设置 -> Settings -> Access Tokens -> Create new token(选 "Read" 权限即可),复制生成的 hf_... 字符串。

2. 正确的下载命令

CTRL+C停止COMFYUI

在 wget 命令中加入 Token Header,或者直接将 Token 拼入 URL 中。

Bash

wget --header="Authorization: Bearer 你的_HF_TOKEN" \

https://hf-mirror.com/black-forest-labs/FLUX.1-schnell/resolve/main/ae.safetensors

(请将 你的_HF_TOKEN 替换为上面复制的 hf_... 开头的字符串)

安装成功,重启COMFYUI。

cd /root/ComfyUI

python main.py --listen 0.0.0.0 --port 8188

到这里就完成了,模型及模型CLIP,VAE的安装。之后就可以去建设工作流了。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读