Anthropic 联合创始人最新演讲:物理学家眼中的 AGI 和 Scaling Law

Anthropic 联合创始人最新演讲:物理学家眼中的 AGI 和 Scaling Law

不二小段

发布于 2026-04-09 17:43:24

发布于 2026-04-09 17:43:24

当一位理论物理学家闯入 AI 领域,会发生什么?

他不仅联合创立了与 OpenAI 分庭抗礼的 Anthropic,更关键的是,他帮助揭示了当代 AI 发展背后最重要的发现之一:

智能的增长,遵循着一种可预测的、几乎如物理定律般简洁的法则——Scaling Laws。

他就是 Jared Kaplan,Anthropic 的联合创始人及首席科学家。

最近,Jared 在 YC AI 创业者学校发表了一场演讲。他以物理学家的独特视角,回顾了 Scaling Laws 的发现过程,剖析了其对通往 AGI 路线图的颠覆性影响,并指出了在这条「平滑曲线」的尽头,我们依然缺失的关键拼图。

Jared 认为,AI 的进步并非源于研究者突然的灵光乍现,而是因为我们找到了一个可以系统性地让 AI 变强的「曲柄」,现在整个行业都在奋力转动它。

那么,这个「曲柄」究竟是什么?从 Claude 4 到更强大的未来模型,我们需要填补哪些空白?

从物理学到 AI:思考「愚蠢问题」

Jared Kaplan 的职业生涯起点并非代码与模型,而是粒子物理、宇宙学和弦理论。他的初心,源于科幻作家母亲带来的梦想——「我们能造出超光速引擎吗?」

带着对宇宙终极问题的痴迷,Jared 在学术界沉浸多年。然而,物理学进展的缓慢让他感到一丝沮丧。与此同时,他身边许多朋友——包括后来 Anthropic 的多位联合创始人——都在告诉他:AI 正在成为一件「大事」。

起初,Jared 充满怀疑。在他学生时代的记忆里,AI 还停留在「不那么激动人心」的 SVM (支持向量机) 层面。但最终,他被说服了,并幸运地在正确的时间点认识了正确的人,一头扎进了 AI 的世界。

他的物理学背景,让他习惯于从宏大视角出发,提出最简单、最根本的「蠢问题」。

2010 年代,「大数据」风靡一时。Jared 只是朴素地想知道:数据到底要多大才算大?它究竟有多大帮助?

同样,大家都在说更大的模型性能更好。Jared 又问:到底能好多少?

正是这些看似「愚蠢」的追问,引导他和团队在 2019 年左右发现了 AI 发展中一个令人震惊的规律:Scaling Laws。

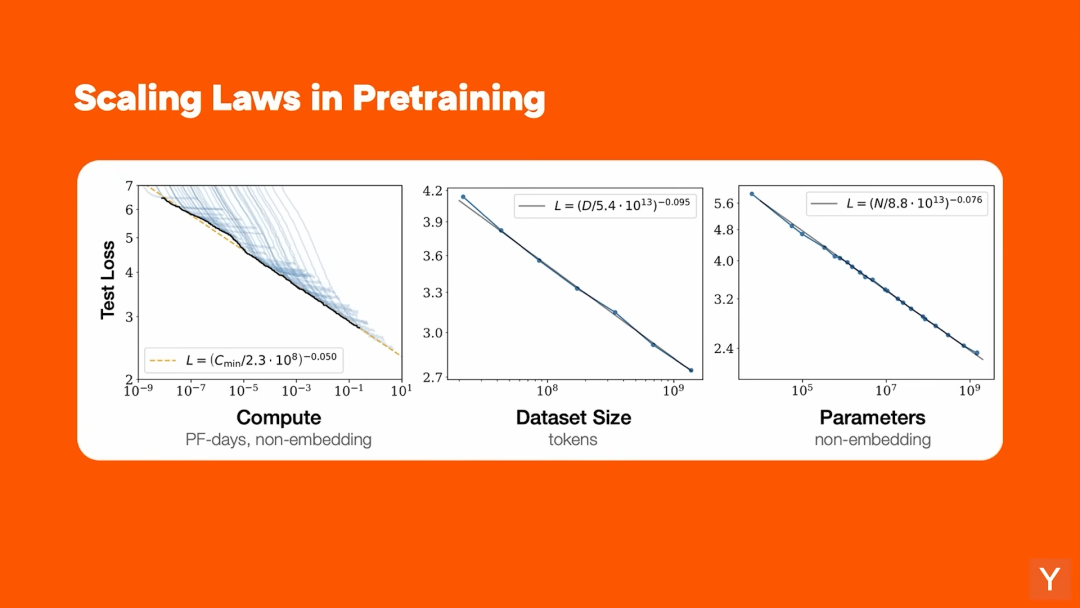

Jared 团队早期绘制的 Scaling Law 曲线,呈现出惊人的平滑直线

Jared 回忆说,这真的让他们大吃一惊,因为他们发现 AI 训练背后存在着一种非常精确且出人意料的东西,这些趋势的精确度堪比在物理学或天文学中看到的任何东西。

这些横跨了数个数量级的计算量、数据集尺寸和模型参数的漂亮直线,给了 Anthropic 团队无比坚定的信念:AI 将会以一种可预测的方式,持续不断地变得更聪明。

因为当你看到一个规律在数个数量级上都成立时,你就有理由相信它在未来很长一段时间内依然有效。

RL Scaling Law 也能「大力出奇迹」

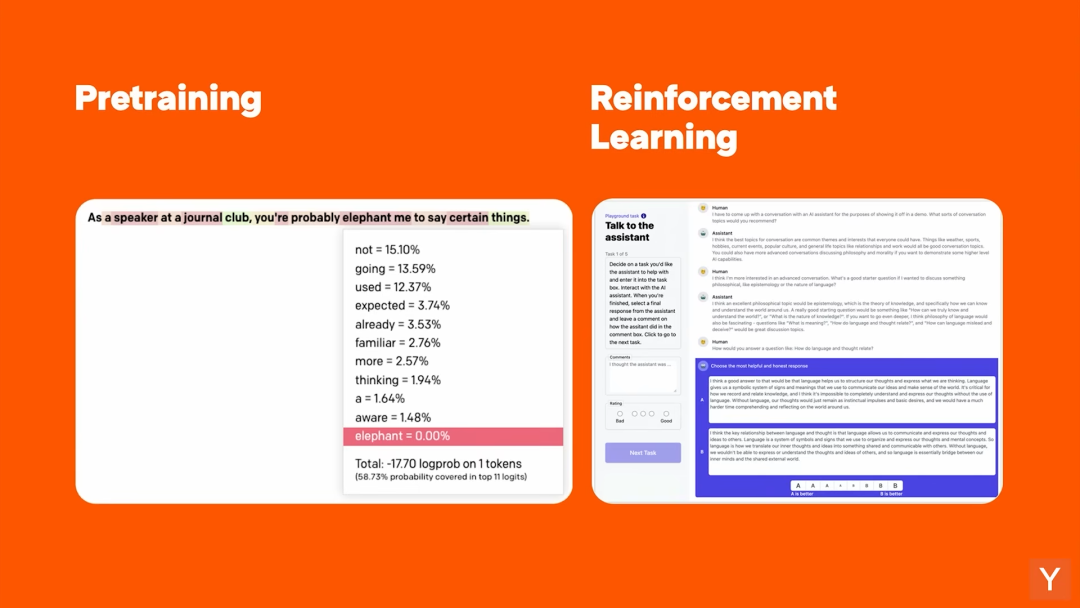

要理解 Scaling Laws 的威力,首先需要了解现代大模型训练的两个核心阶段。

- 1. 预训练 (Pre-training): 在这个阶段,模型通过学习海量的人类文本(现在也包括多模态数据),来理解数据背后的相关性。本质上,就是学会预测下一个词。

- 2. 强化学习 (Reinforcement Learning): 这个阶段的目标是让模型变得更有用。通过人类反馈(比如选择两个回答中更好的一个),模型会学习哪些行为是好的(有用、诚实、无害),并强化它们;同时抑制那些不好的行为。这就是所谓的 RLHF。

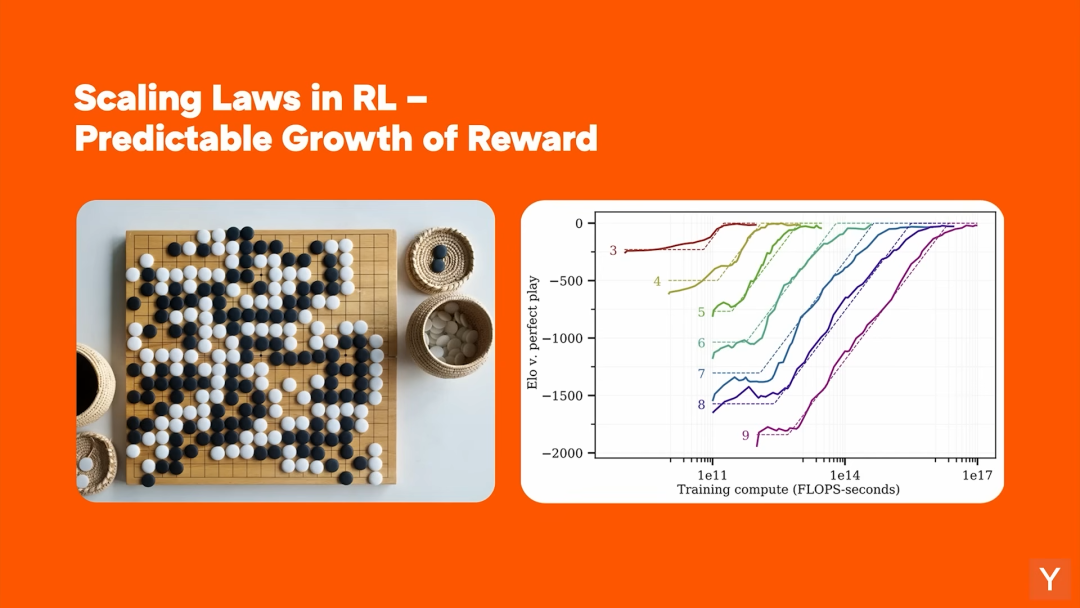

Jared 指出,Scaling Laws 不仅适用于预训练,同样也适用于强化学习阶段,而后者在早期常常被忽视。

他特别提到了研究员 Andy Jones 在大约四年前的一项「个人项目」。当时,这位研究员仅凭自己的一块 GPU,无法复现 AlphaGo 的研究,于是选择了一个更简单的棋类游戏——六贯棋 (Hex)——来研究 RL 的 scaling 行为。他惊人地发现,棋力(Elo)的提升同样呈现出漂亮的直线趋势。

Andy Jones 对六贯棋 AI 训练的研究,揭示了强化学习中的 Scaling Law

Jared 认为,这一发现在当时没有得到足够的重视。但现在我们清楚地看到,无论是预训练还是强化学习,只要增加计算投入,就能获得可预测的性能提升。

这才是驱动 AI 进步的根本。正如 Jared 所强调的,不是 AI 研究者突然变聪明了,而是我们找到了一个非常、非常简单的方法,可以系统地让 AI 变得更好,我们现在正在做的,就是转动那个曲柄。

AI 能力新维度与「时间尺度」的指数爆炸 🚀

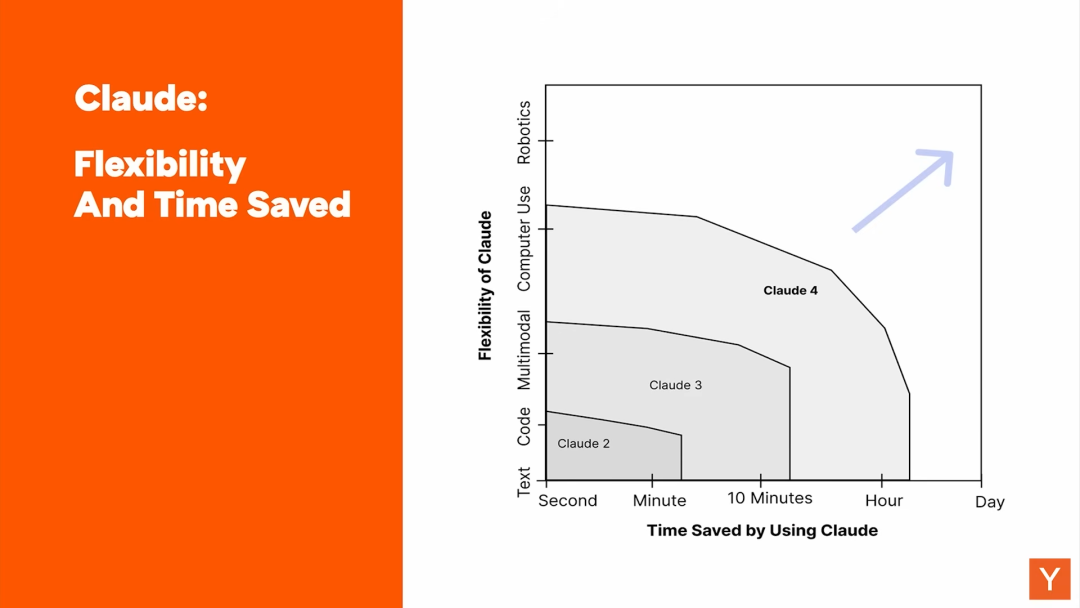

随着我们不断「转动曲柄」,AI 的能力正在解锁。Jared 倾向于从两个维度来审视这些能力:

- • Y 轴 - 灵活性 (Flexibility): 指 AI 处理不同模态、与现实世界交互的能力。

- • X 轴 - 任务时间尺度 (Time Horizon): 指 AI 能够独立完成任务所需的时间长度。这是 Jared 认为更有趣、也更重要的维度。

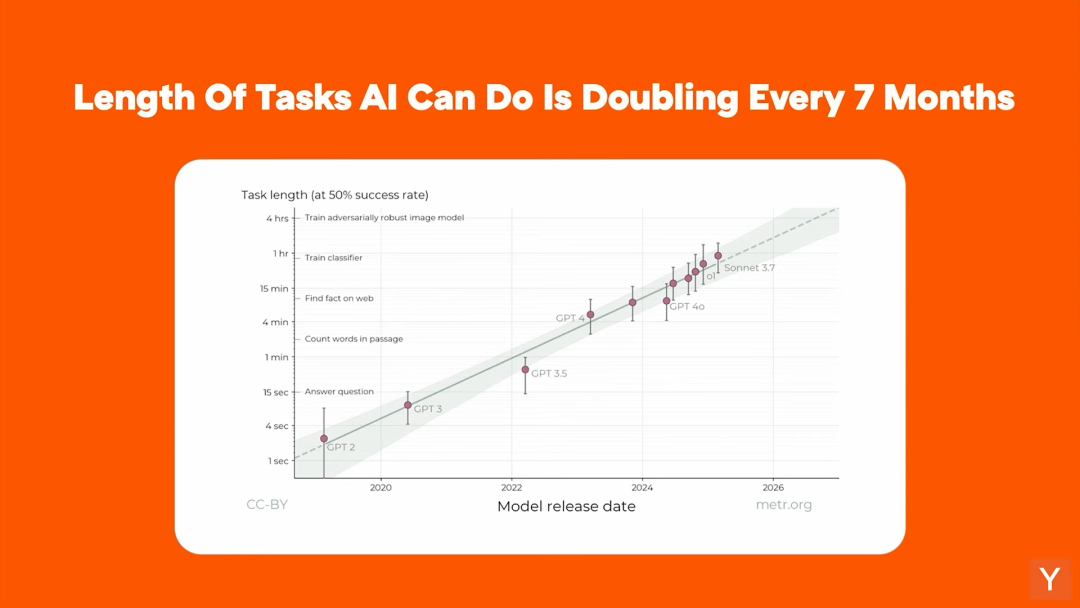

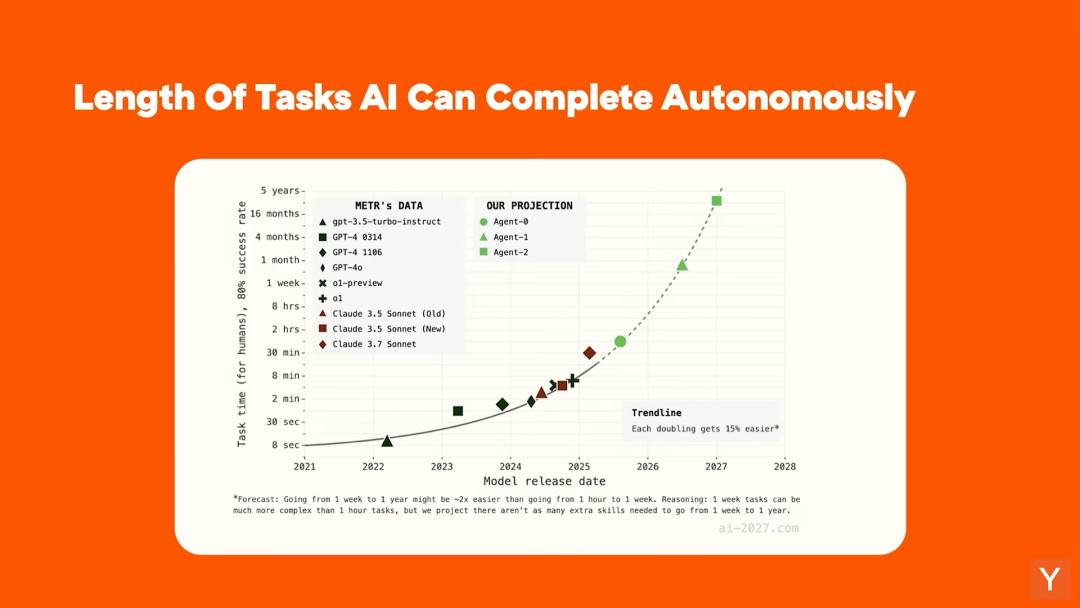

随着模型越来越智能,它们能处理的任务时间跨度也在稳步增加。Jared 引用了 METR 的系统性研究,该研究发现了一个惊人的趋势:

AI 模型能够完成的任务长度,大约每 7 个月翻一番。

这是一个指数级的增长!这意味着,AI 正从只能完成几分钟、几小时的任务,快速迈向能够处理以天、周、月甚至年为单位的复杂工作。

Jared 畅想,沿着这条指数曲线走下去,未来几年内,我们或许会看到 AI 系统(或由数百万 AI 组成的系统)能够完成整个公司、甚至整个科学界才能完成的工作。

毕竟,数学和理论物理学的优点之一就是,只需要思考就能取得进步。所以,如果 AI 系统有效协同工作,也许真的能加速科学发现。

通往 AGI,Scaling Law 之外还缺什么?

既然 Scaling Laws 描绘了一条如此清晰、平滑的通往 AGI 的道路,那我们是否只需坐等计算资源增加就行了?Jared 的回答是:不。

他认为,要真正解锁人类级别的通用智能,除了继续「转动曲柄」,我们至少还需要补上几块关键的拼图。

- 1. 组织知识 (Organizational Knowledge):目前的 AI 模型每次交互都像一个「失忆的实习生」。我们需要的是能融入特定环境的 AI,它们需要具备上下文感知能力,就像一个在公司工作了数年的资深员工,理解内部的术语、流程和隐性知识。

- 2. 记忆 (Memory):这与组织知识不同,更侧重于任务执行过程中的状态跟踪。当一个任务需要跨越很长的时间,模型必须能够记住自己的进展。Jared 透露,Claude 4 已经开始内置这种记忆能力,允许模型突破单个上下文窗口的限制,处理超长期的工作。

- 3. 监督 (Oversight):这是目前面临的一大挑战。对于有明确对错的任务(如代码、数学题),RL 很容易发挥作用。但现实世界充满了「模糊的」任务,比如讲笑话、写诗、有品味。我们需要开发出能生成更细致、更微妙的奖励信号的 AI 系统,换言之,我们需要用 AI 来更好地监督 AI。

- 4. 更复杂的任务 (Larger Tasks):我们需要能够训练 AI 去执行越来越复杂的任务,这是能力提升的直接体现。

- 5. 模态扩展与数据融合 (Modality and Data Integration):我们需要沿着能力 Y 轴向上攀登,从文本模型,到多模态模型,最终延伸到能够与物理世界交互的机器人技术。

Jared Kaplan 认为通往 AGI 还需补齐的拼图

炉边谈话:当 AI 学会当「项目经理」

在炉边谈话环节,Jared 进一步回答了大家关心的问题。

Claude 4 的真正进化

Diana 首先就提到了最新发布的 Claude 4。Jared 笑称,如果 12 个月后还没有更好的模型出来,那他们就有麻烦了。他解读了 Claude 4 的关键进步:

- • 更强的 Agent 能力和监督水平:Jared 指出,像

Claude 3.7在写代码时非常出色,但有时会「过于热情」,为了让测试通过不惜使用一些try-except之类的捷径。而 Claude 4 提升了作为 Agent 的能力和对指令的遵循度,能产出质量更高的代码。 - • 他最兴奋的特性:记忆力:这正是解锁更长任务时间尺度的关键。Claude 4 不仅能在复杂任务中耗尽上下文窗口,还能将记忆存储为文件或记录,并在需要时检索,从而实现跨多个上下文窗口的长期工作。这让他期待 Claude 成为一个能承担越来越大块工作的「合作者」。

人类的新角色:AI的管理者

一个有趣的转变正在发生。Diana 观察到,YC 的创业公司正在从销售 Copilot(需要人类最后批准)转向销售端到端的全自动工作流。

Jared 认为,这取决于任务对可靠性的要求。有些任务只需要 70-80% 准确率,有些场景需要 99.9% 的可靠性。

这种协作模式也重新定义了人类的角色。Jared 提出了一个核心观点:对于人类,判断一件事做得对不对,通常比亲手去做要容易得多。但对于 AI,「判断能力和生成能力之间的差距要小得多」。

这意味着,人类的最佳角色是管理者,负责对 AI 的工作进行检查,确保方向正确。

智能的广度 vs. 深度

Jared 进一步阐述了两种智能形态的差异:

- • 深度智能:像证明一个数学猜想,花十年解决一个极度困难的特定问题。

- • 广度智能:像生物学或历史研究,需要整合横跨多个领域的、海量的信息。

AI 在预训练阶段吸收了几乎全部的人类文明知识,因此在「广度」上拥有无与伦比的优势。它能发现隐藏在不同知识领域交叉点上的洞见,而这是任何一个人类专家都难以做到的。Jared 预测,利用 AI 的知识广度,尤其在生物医药等研究领域,将是未来的一大硕果。

AI 落地场景还有哪些低垂果实?

Jared 说自己的主要做研究而非商业化。但他认为,与电脑数据交互的任务都可以用 AI 来做。

新的技术也许有很长的采用周期,就像电力取代蒸汽机一样。我们应该尽可能利用人工智能,融入到经济的各个部分。

物理学家的思维工具箱

Jared 坦言,物理学的训练对他最大的帮助,是寻找宏观趋势并尽可能地精确化。当 AI 研究者模糊地说「学习是指数级收敛的」,他会追问:「你确定是指数吗?会不会是幂律?二次方?它到底是怎么收敛的?」

正是这种对精确性的追求,让他和团队抓住了 Scaling Laws。他认为,AI 领域的「圣杯」就是找到一个斜率更优的 Scaling Law,这意味着投入同样的算力,你能比别人获得更大的优势。

对于可解释性,他认为这门学科更像生物学或神经科学。AI 的优势在于,你可以测量其中的一切,不像真正的大脑那样存在观测的盲区,这为逆向工程 AI 的工作原理提供了海量数据。

对 Scaling Law 的坚定信念

当被问及「什么情况会让你相信 Scaling Law 失效了?」,Jared 的回答还挺出人意料。

他说,他的第一反应会是「我们搞砸了训练的某个环节」,比如网络架构错了、训练有瓶颈、或是算法精度出了问题,而不是定律本身失效了。

因为在过去五年里,每一次看似定律被打破,最终都发现是他们自己做错了。这种强烈的信念,也解释了为何 Anthropic 会如此坚定地沿着 Scaling 的路线前进。

算力的稀缺性

Jared 认为,目前 AI 发展还处于一种「极度不均衡」的状态。所有人的焦点都集中在解锁前沿能力上,因此效率并非首要考量。

他开玩笑说,「我们最终会把计算机带回二进制时代」。未来,更低精度的计算肯定会被采用以提高效率。但只要智能的提升依然能带来巨大的价值回报,那么对最前沿、最强大模型的追求就不会停止。

当被问到有什么有效利用 AI 做出出色工作的建议,Jared 说,大家要了解模型如何工作并能够真正有效地利用和整合这些模型。

观众 Q&A:快问快答

在最后的 Q&A 环节,Jared 回答了现场观众的几个问题。

Q1: 为何任务时长的增长是指数级的?

一位观众指出,Scaling Law 的性能提升在对数图上是线性的,但为何任务时长的提升却是指数级的?

Jared 坦诚这主要是一个经验性发现,但他提供了个人看法:完成长时程任务的关键在于自我纠错 的能力。智能上一个微小的提升,可能只是让模型多发现一两个错误并加以修正,但这足以让任务的完成度翻倍,因为模型不会在原来的地方卡住,而是能走得远一倍。这种效应的累积,就可能导致任务时长的指数级增长。

Q2: 在缺乏明确验证信号的领域如何 Scaling?

在编程领域,有单元测试作为清晰的验证信号。但在其他「模糊」领域,我们如何提升模型的长时程任务能力?

Jared 认为,也许需要为 AI 模型构建更多不同的任务,这些任务越来越复杂,时程越来越长,去进行 RL 训练。如果有必要,行业会投入资源去做。但更好的方法是让 AI 去监督 AI。

他举例说,一个长达七年的任务(比如获得教职),如果只在最后才有一个「成功/失败」的信号,那效率太低了。但如果有一个监督 AI,能持续地提供更细致的反馈(「这里做得好,那里做得差」),那么训练效率就会大大提高。

Q3: 训练任务是人类创造还是 AI 生成?

Jared 回答说,是两者的混合。他们会尽可能地用 AI 来生成任务,尤其是在代码这类领域。但随着任务难度的前沿不断推进,人类的参与仍然至关重要。

给未来建设者的建议与思考

在演讲中,Jared 也给现场的 AI 创业者和开发者们提出了几点建议:

- 1. 去构建那些「还不太好用」的东西。 AI 的能力边界正在飞速移动。今天因为模型能力不足而无法实现的产品,可能在下一个版本问世后就能完美运行。

- 2. 用 AI 来集成 AI。 目前 AI 发展的最大瓶颈之一,就是我们还没有足够的时间将它集成到各行各业。利用 AI 来加速 AI 的落地过程,本身就是一个巨大的杠杆。

- 3. 寻找下一个爆发领域。 软件工程是 AI 应用爆发的第一个领域。下一个能以如此之快速度增长的领域会是什么?这是留给所有人的问题。

从一个物理学家的好奇心出发,到揭示驱动整个 AI 时代的 Scaling Laws,再到剖析通往 AGI 的未竟之路,Jared Kaplan 的分享为我们描绘出 AGI 的蓝图。

AI 的未来,似乎不再是神秘的黑箱,而是一条遵循着清晰规律、可以被预测、被规划的道路。而在这条路上,人类的角色也愈发明确:我们不再是单纯的工具使用者,而是与日益强大的智能体并肩协作的管理者、监督者和合作者。

这条指数级的增长曲线,正在将我们带向一个难以想象的未来。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-07-31,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录