【AI安全漏洞】Ollama未授权访问漏洞到白嫖在线AI模型

【AI安全漏洞】Ollama未授权访问漏洞到白嫖在线AI模型

Al1ex

发布于 2026-04-13 11:13:24

发布于 2026-04-13 11:13:24

影响范围

Ollama *

漏洞描述

在本地大模型部署工具快速普及的背景下,许多开发者和企业开始使用Ollama来运行和管理本地大语言模型,Ollama默认会在本地启动一个HTTP API服务用于接收模型推理请求,这个服务通常监听在http://localhost:11434,但在某些情况下(例如:修改配置、Docker部署或云服务器部署),Ollama可能会监听0.0.0.0:11434,此时任何能够访问该端口的用户都可以直接调用Ollama API,而无需身份认证,攻击者一旦能够访问该接口就可以远程调用模型推理、下载或删除模型,甚至将目标服务器当作免费的AI推理节点使用,从而造成算力资源滥用、系统资源消耗以及潜在的数据泄露风险。在一些接入知识库(RAG)或AI Agent系统的场景中该漏洞还可能进一步扩大影响范围,导致内部信息被间接获取

漏洞复现

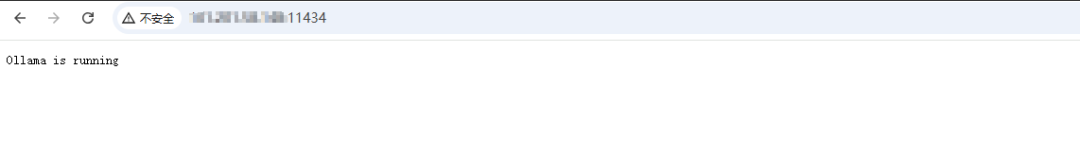

在这里我们通过资产测绘检索选择任意一个目标作为测试,可以看到直接访问时默认会返回"ollama is running"

Ollama提供了一组基于HTTP的REST API接口,开发者可以通过curl、Python、JavaScript等方式调用这些接口,实现模型推理、聊天、模型管理等功能:

接口路径 | 请求方法 | 功能说明 | 典型用途 |

|---|---|---|---|

/api/generate | POST | 文本生成接口 | 根据 Prompt 生成文本 |

/api/chat | POST | 聊天对话接口 | 实现多轮对话 |

/api/embeddings | POST | 向量生成接口 | 生成文本向量,用于 RAG |

/api/tags | GET | 查看本地模型列表 | 查询已安装模型 |

/api/show | POST | 查看模型信息 | 查看模型配置 |

/api/pull | POST | 下载模型 | 从远程仓库拉取模型 |

/api/push | POST | 上传模型 | 将模型上传到仓库 |

/api/create | POST | 创建模型 | 基于 Modelfile 构建模型 |

/api/copy | POST | 复制模型 | 复制已有模型 |

/api/delete | DELETE | 删除模型 | 删除本地模型 |

/api/ps | GET | 查看运行模型 | 查看当前运行的模型实例 |

/api/version | GET | 查看版本信息 | 获取 Ollama 版本 |

我们可以通过以下方式进行一个简单测试:

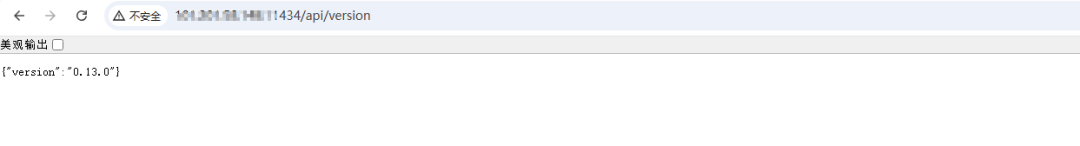

#版本信息

/api/version

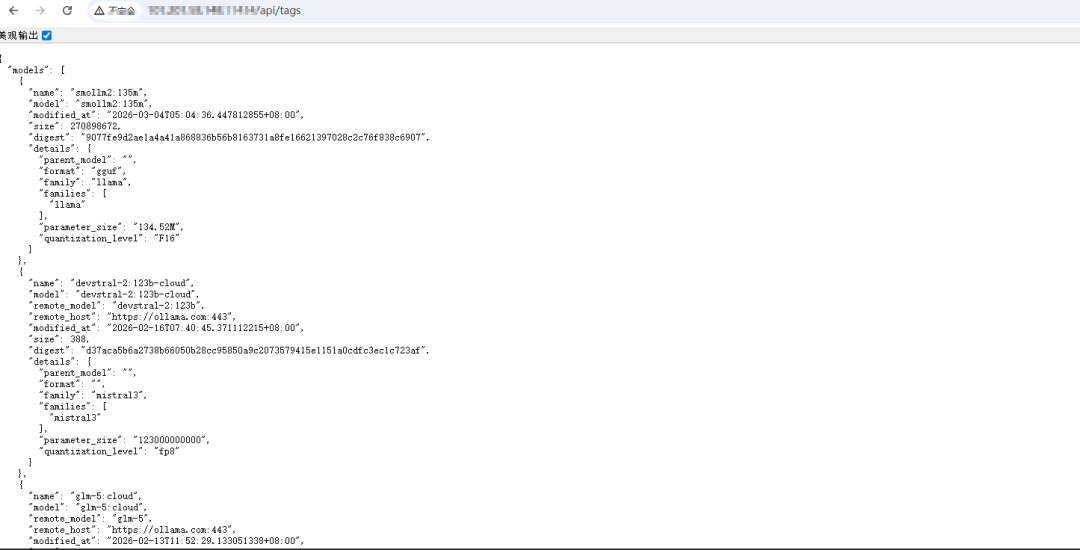

#模型列表

/api/tags

漏洞利用

免费模型

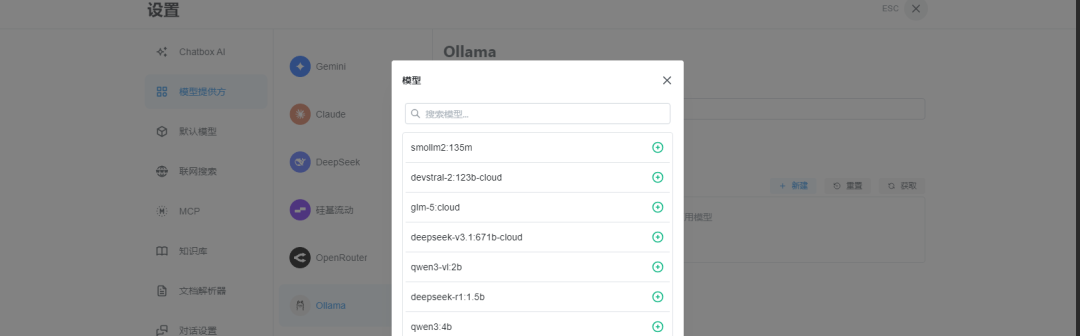

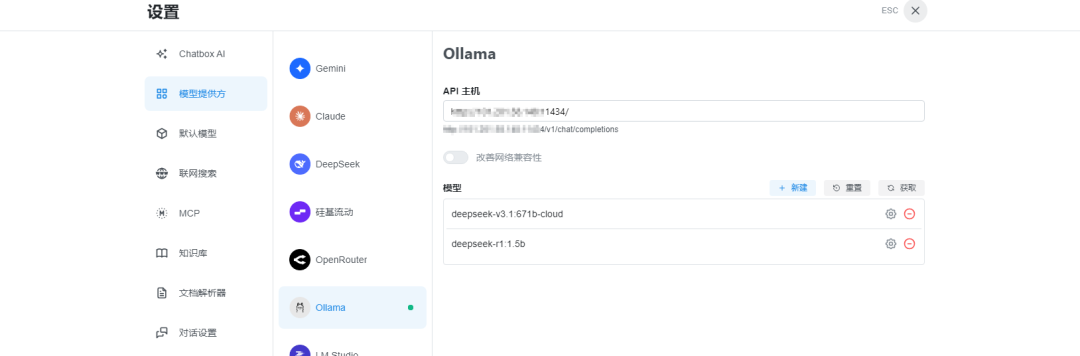

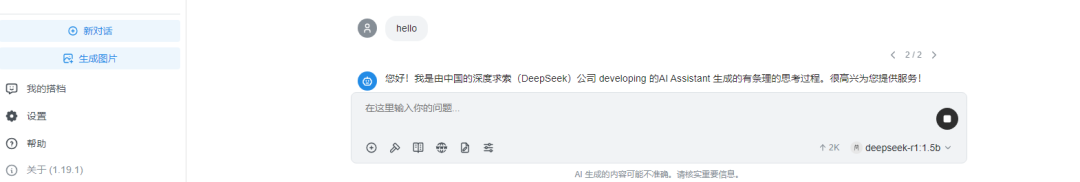

我们可以通过"ChatBox+未授权的Ollama"来使用对应的模型,而不需要自己独立去部署对应的模型,例如:

随后我们在使用的时候直接使用

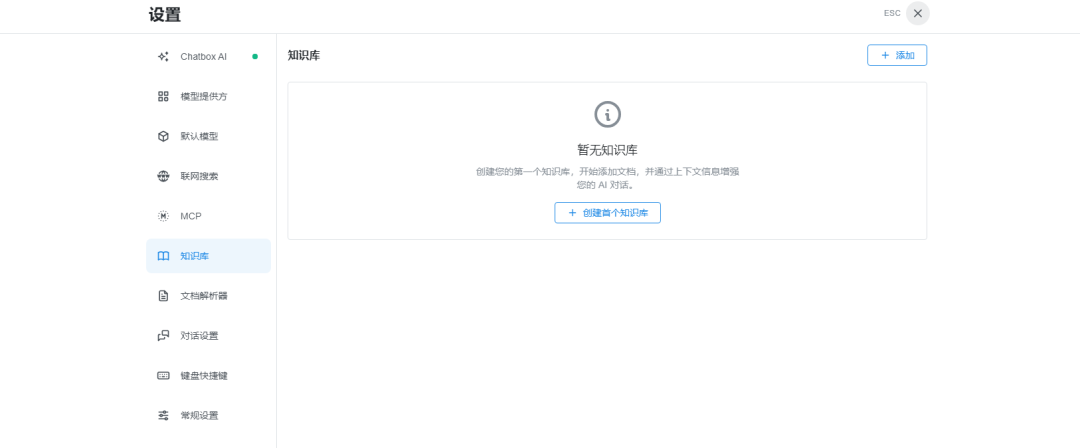

目前Ollama也支持构建知识库,如果本地部署的模型用于构建了私有知识库,则会导致一系列的信息泄露问题

模型删除

Ollama提供了对模型的管理功能,我们可以通过"/api/delete"来删除本地模型

curl http://localhost:11434/api/delete -d '{

"name": "llama3"

}'修复建议

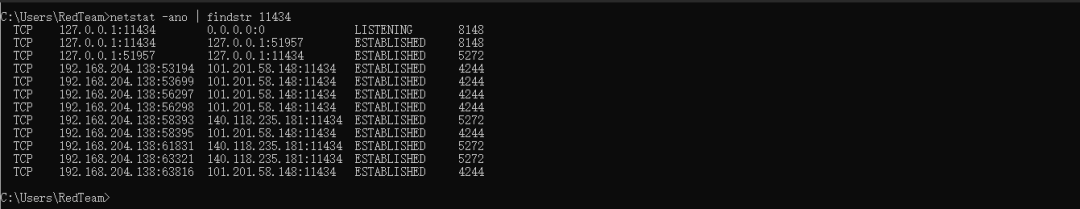

1、修改监听地址

#Windows

setx OLLAMA_HOST 127.0.0.1

#Linux/MacCos

export OLLAMA_HOST=127.0.0.1

ollama serve修改之后执行以下命令进行验证:

netstat -ano | findstr 11434

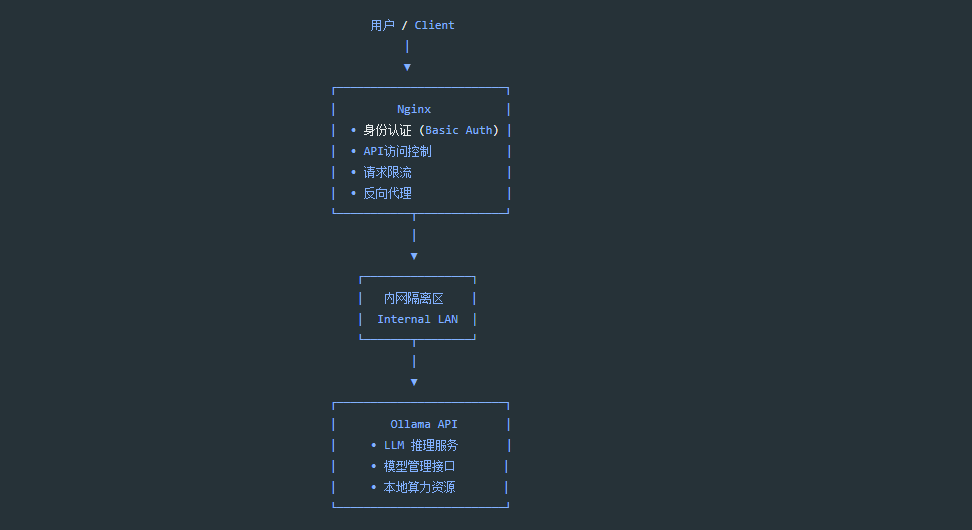

2、Nginx反向代理 + 身份认证

我们可以通过反向代理实现对Ollama身份认证

Step 1:安装Nginx

sudo apt install nginxStep 2:反向代理配置

server {

listen 8080;

location / {

proxy_pass http://127.0.0.1:11434;

auth_basic "Restricted Access";

auth_basic_user_file /etc/nginx/.htpasswd;

}

}Step 3:设置密码

htpasswd -c /etc/nginx/.htpasswd admin推 荐 阅 读

图片

图片

图片

图片

图片

横向移动之RDP&Desktop Session Hija

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-04-12,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录