英伟达亮出 L4 自动驾驶终极方案,全栈技术打通从研发到量产最后一公里

英伟达亮出 L4 自动驾驶终极方案,全栈技术打通从研发到量产最后一公里

GPUS Lady

发布于 2026-04-13 12:43:37

发布于 2026-04-13 12:43:37

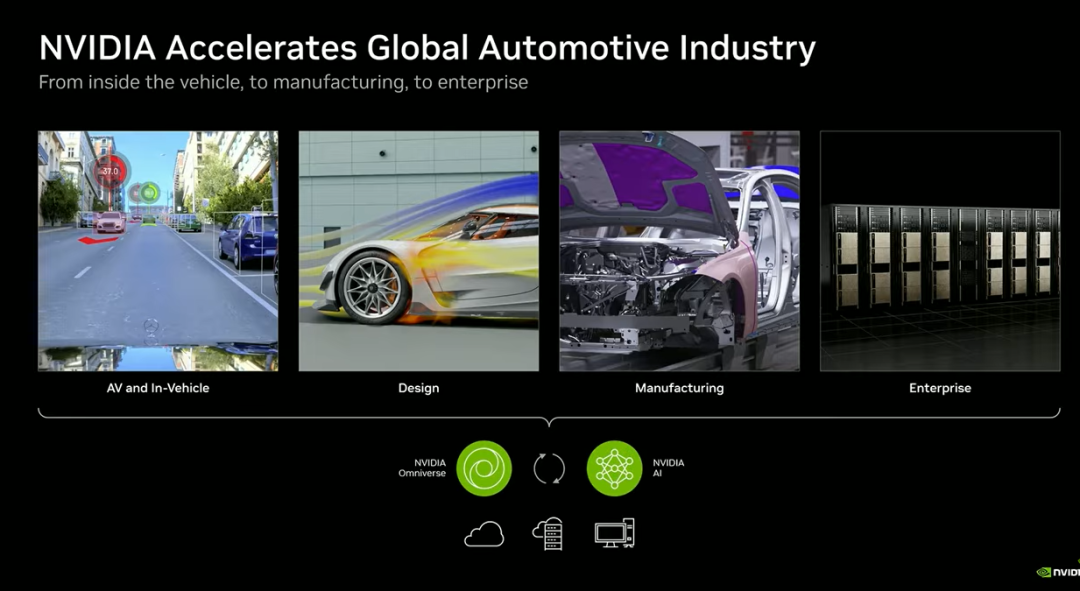

本文基于英伟达 GTC 大会自动驾驶专场演讲内容,完整呈现L4 级自动驾驶产业发展路径、英伟达 DRIVE Hyperion 架构、云端 - 仿真 - 车端一体化平台,以及智能体 AI 如何端到端变革自动驾驶开发、验证与车载体验,助力车企与自动驾驶开发者打造可扩展、通过安全认证的自动驾驶方案。

一、行业拐点:2025 成为自动驾驶 “ChatGPT 时刻”,L4 路径全面清晰

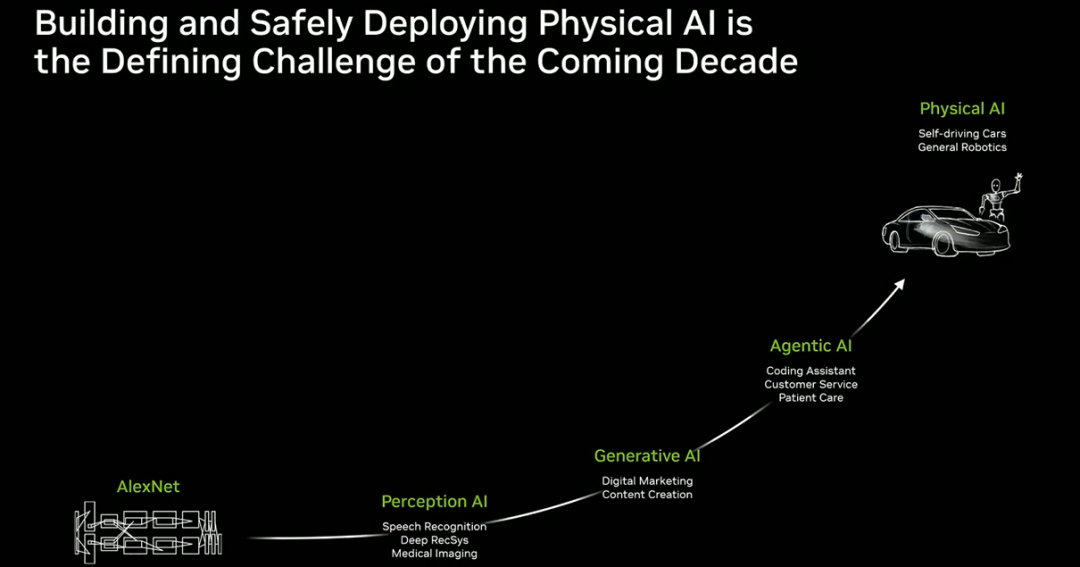

当前自动驾驶行业正处在历史性转折点,AI 技术的爆发式进步,彻底改变了自动驾驶系统的开发方式。

三大 AI 模型重构开发范式

视觉 - 语言 - 动作模型(Vision Language Action Models)、世界基础模型(World Model Foundation Models)、推理模型(Reasoning Models)的成熟,让自动驾驶从传统感知决策,走向具备理解、推理、自适应能力的新阶段。

L4 自动驾驶的确定性显著提升

技术变革没有减慢行业进度,反而让整个产业更快冲向完全自动驾驶,L4 级全自动驾驶的实现路径从未如此清晰,让所有移动工具实现自主运行的目标更加可落地。

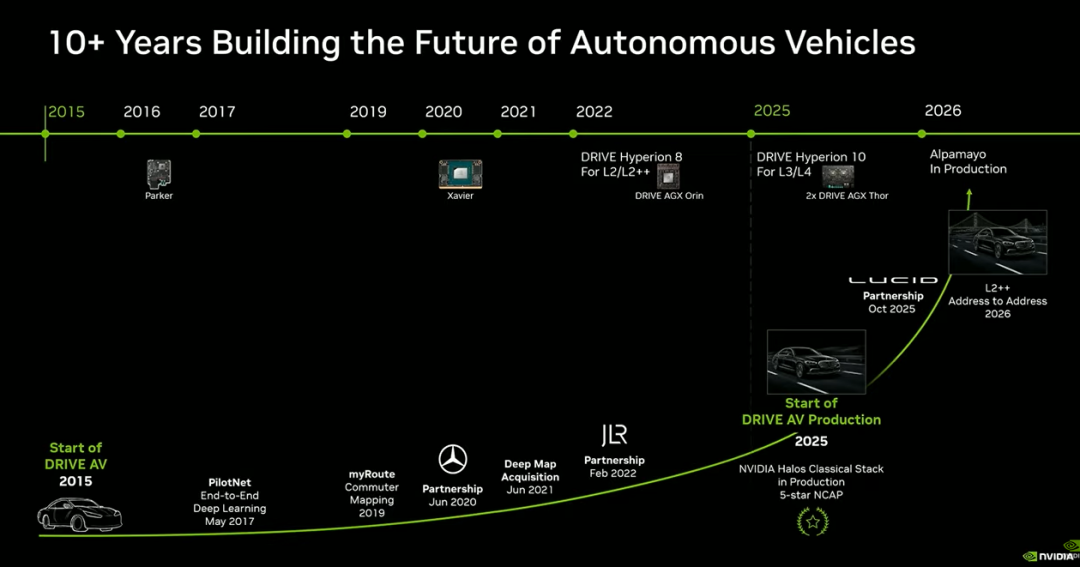

英伟达十年自动驾驶布局

英伟达深耕自动驾驶超过 10 年,2015 年前后推出首款 ADAS 芯片Parker,支撑了第一代自动驾驶辅助系统落地;十年后,行业再次来到关键转折点,英伟达与生态伙伴共同推进可规模化、高安全的自动驾驶方案。

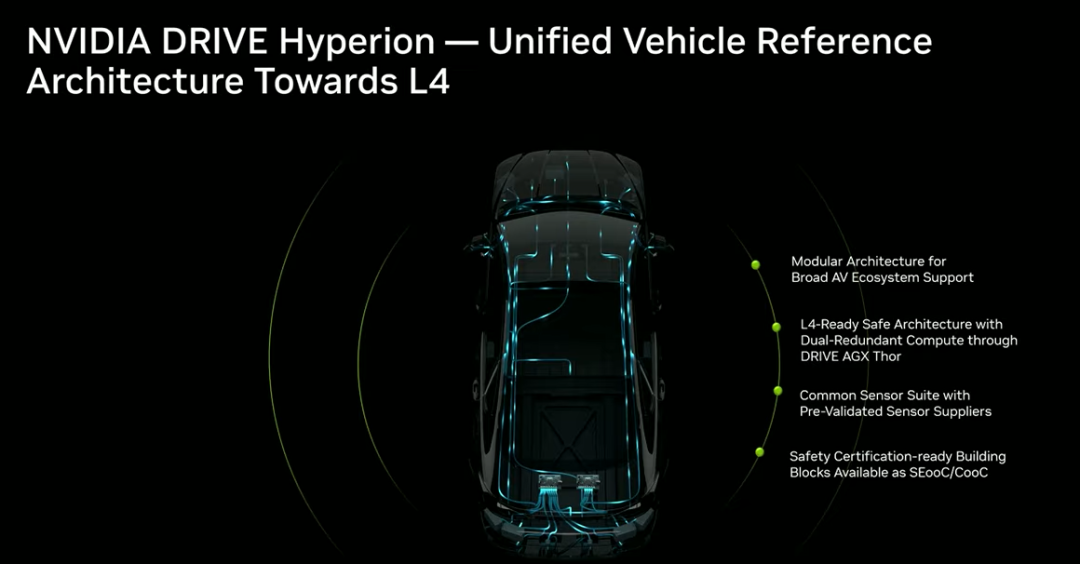

二、核心架构:DRIVE Hyperion—— 支撑 L4 的统一车端参考平台

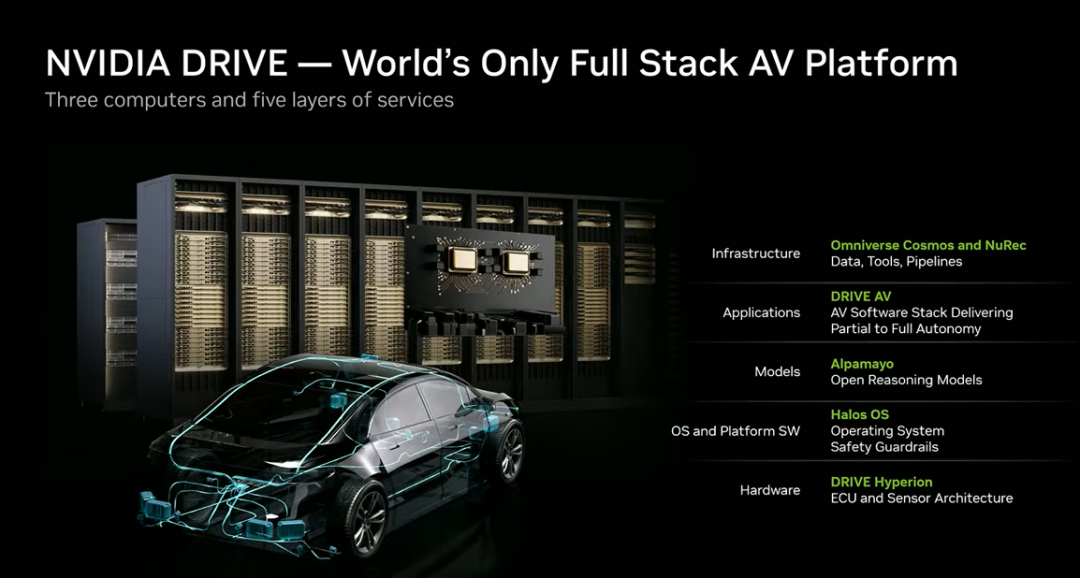

英伟达明确提出:物理 AI 的实现是 “三台计算机” 问题,分别是云端训练计算机、云端仿真计算机、车端推理计算机。DRIVE Hyperion 就是支撑这三大计算机的 L4 统一车辆参考架构,为 OEM 与开发者提供标准化、可共享、可扩展的硬件底座。

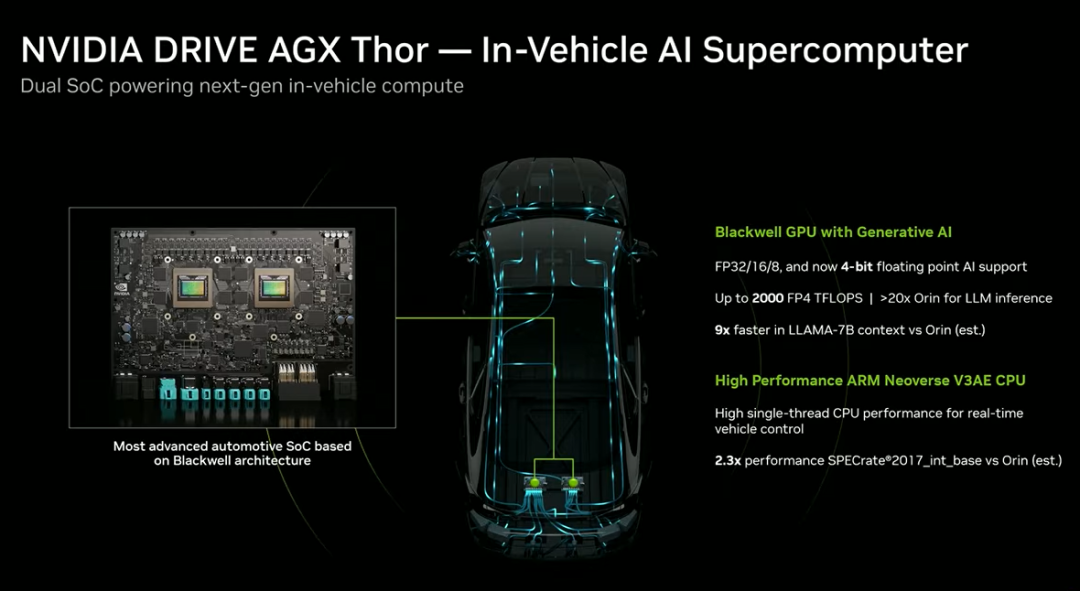

1. 核心计算平台:AGX Thor 车载 AI 超算

基于Blackwell 架构打造,与云端大模型训练同架构,车端能力与云端无缝对齐。

支持FP4 四位浮点计算,在有限车端内存带宽下,有效提升算力效率,性能较上一代 Orin 提升20 倍。

是面向 L4 设计的车规级 AI 超算,满足高等级自动驾驶的实时推理需求。

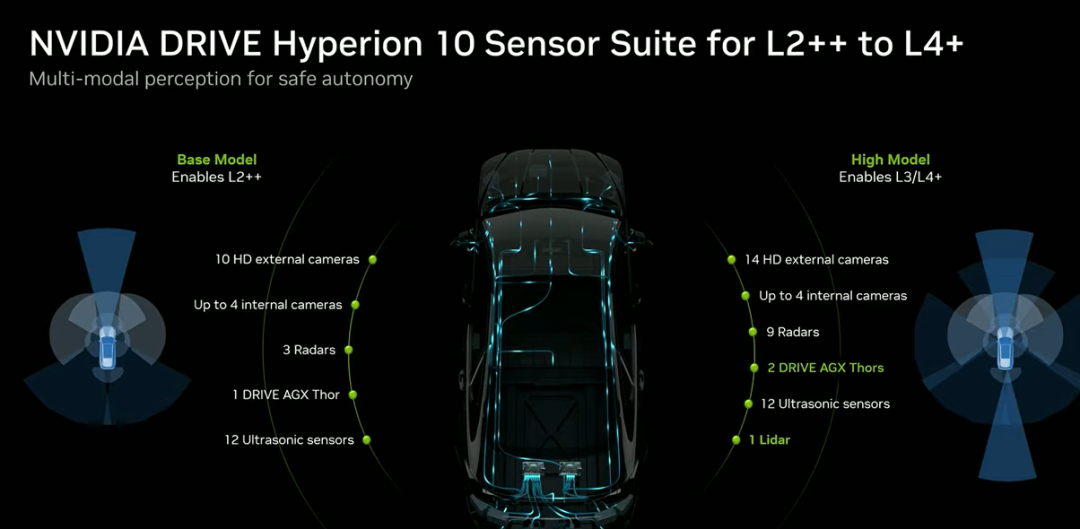

2. 双版本传感器套件,兼顾安全冗余与成本

Hyperion 提供高低两套传感器方案,实现统一架构、数据互通,降低跨平台适配成本:

高配方案(面向 L3/L4 全场景)

14 颗高清摄像头 + 4 颗舱内摄像头 + 9 颗雷达 + 1 颗激光雷达,全传感器冗余设计,单点故障不影响系统安全运行,覆盖高速与城市复杂路况 L4 需求。

基础方案(面向高性价比 L2++)

10 颗摄像头 + 3 颗雷达,在控制 BOM 成本前提下,实现高速、城市点对点脱手自动驾驶与代客泊车能力。

3. 生态扩张与数据共建

与Uber合作打造 Hyperion 10 车队,大规模采集真实道路数据,为行业提供数据起点。

比亚迪、日产、现代等全球 TOP10 车企加入 Hyperion 生态,统一传感器与计算平台,实现数据共享、技术复用。

计划2028 年在全球 28 座城市落地 L4 自动驾驶。

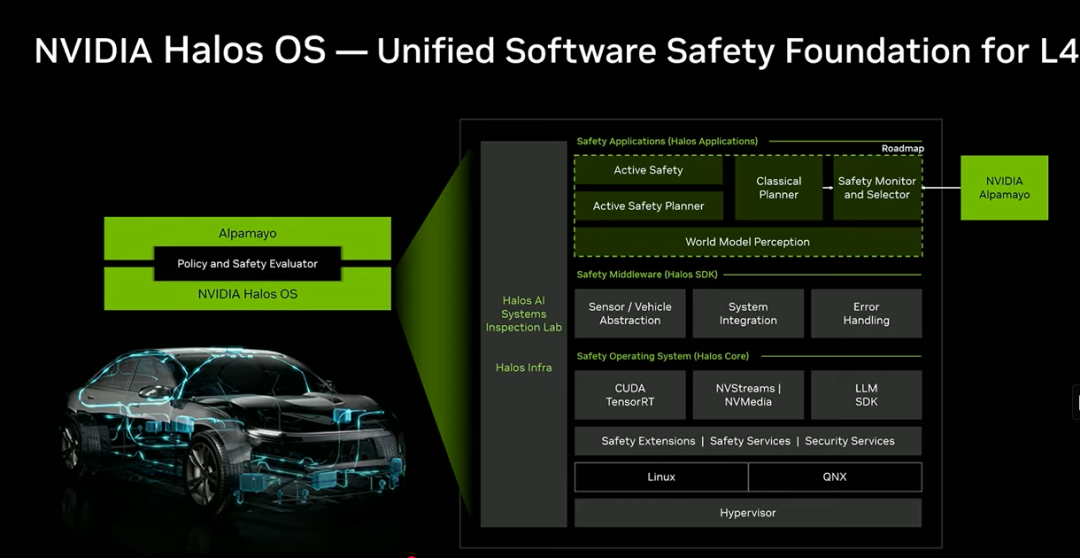

三、安全底座:Halos——L4 级统一软件安全与中间件平台

Halos 是英伟达为 L4 自动驾驶打造的统一软件安全基石,从底层操作系统到上层安全护栏,全面支撑端到端模型安全部署。

最高等级功能安全认证

底层操作系统通过ASIL D(最高车规安全等级)认证,继承 Drive OS 成熟能力,集成 CUDA、TensorRT、LLM SDK,高效支持大模型与生成式 AI 在车端部署,兼容 Linux 与 QNX。

简化 OEM 开发负担

传统模式下,OEM 需要数百名工程师开发传感器与车辆抽象层;Halos 将这部分通用能力标准化,大幅降低车企工程投入,让开发者更聚焦应用与模型。

安全护栏(Safety Guard Rail)

未来将整合五星 E-NCAP/C-NCAP 主动安全软件与传统算法栈,作为端到端大模型的安全兜底,任何开发者都可在 Hyperion 上部署自己的端到端模型,依托 Halos 保障安全。

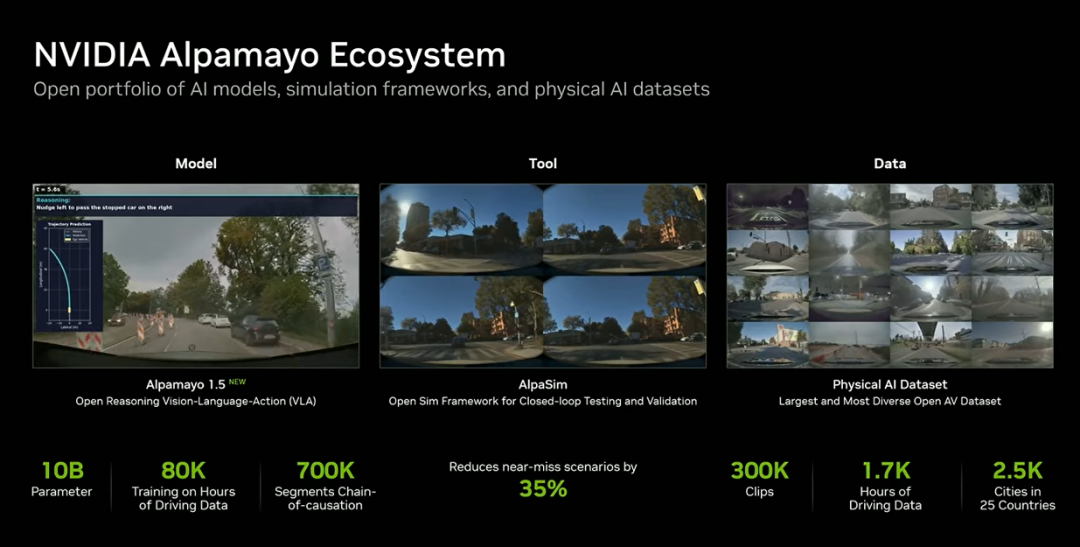

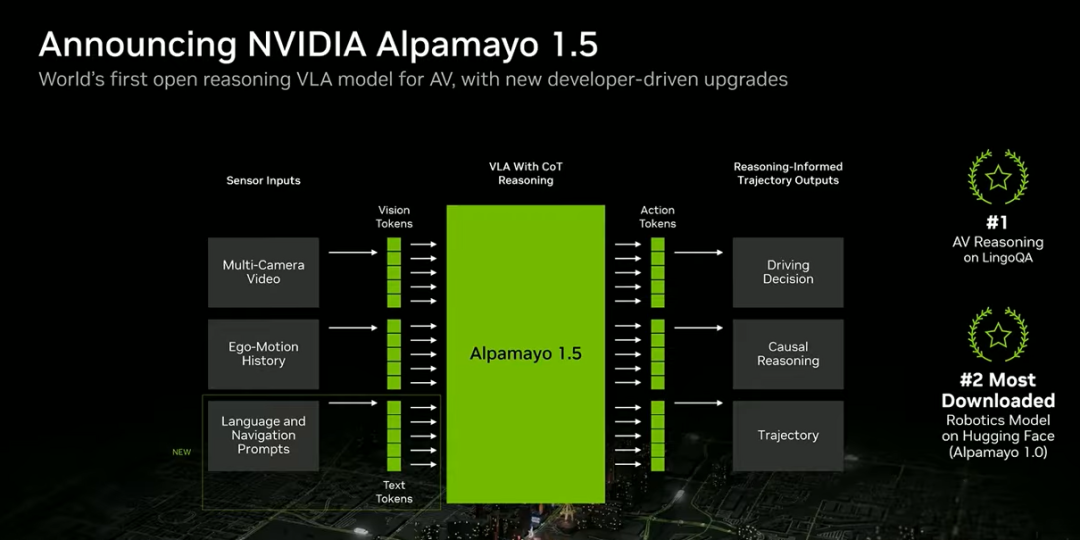

四、智能大脑:Alpamayo 1.5—— 自动驾驶专用推理模型重磅升级

英伟达正式发布Alpamayo 1.5,在 100 亿参数规模上实现能力全面增强,是自动驾驶领域首个量产级推理模型。

1. Alpamayo 1.5 核心升级

路径引导能力

支持路点、导航软件指令、矢量格式等多种路径输入,模型可精准遵循规划路线行驶。

文本提示与语音交互

支持乘客语音提问、指令控制,车辆可实时 “说出” 感知与决策逻辑,实现人车透明交互。

多摄像头灵活配置

支持 1/2/4 颗摄像头灵活组合,适配不同车型 FOV 与安装位置,通用性更强。

行业权威榜单第一

在公开数据集Lingao QA上排名第一,场景理解与推理能力领先业界。

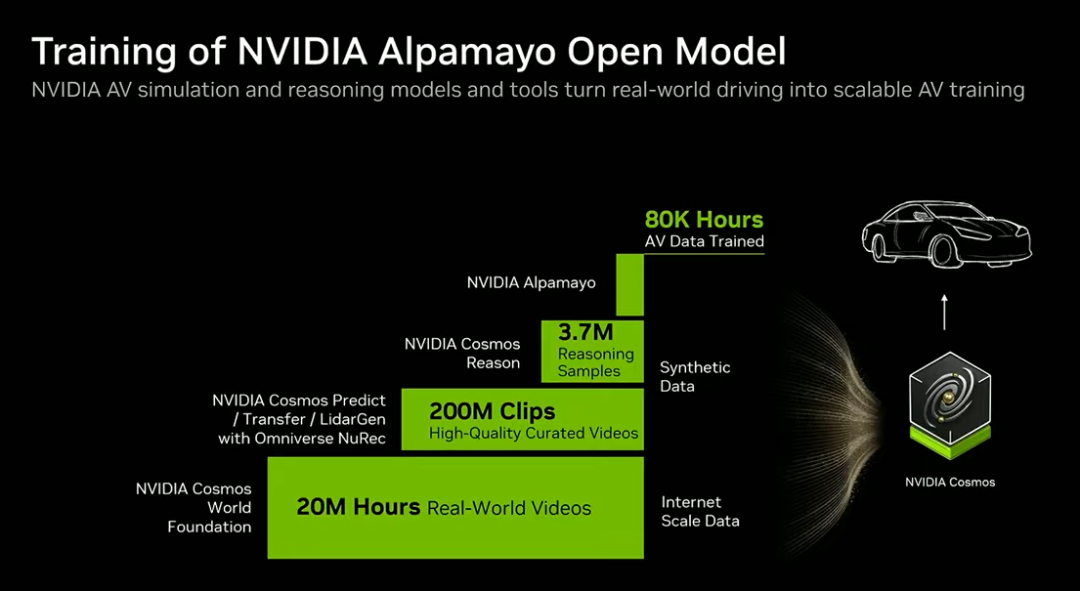

2. 模型训练与开源生态

以Cosmos基础模型为骨干,继承 2000 万小时真实世界数据训练的泛化能力,再用 8 万小时自动驾驶数据精调。

开源7000 小时高质量自动驾驶数据集,覆盖 25 个国家,是目前行业最大规模开源自动驾驶数据。

Alpamayo 1.0 上线两个月下载量超16 万次,位居 Hugging Face 机器人领域下载量第二。

3. 实车演示:旧金山北湾复杂路况全验证

搭载 Alpamayo 的奔驰原型车,在城市道路完成全程演示:

实时感知行人、违停车辆、交叉车流并安全避让

语音控制变道、加速、下匝道、靠边停车

车辆实时播报决策逻辑,展现强推理与应急处理能力

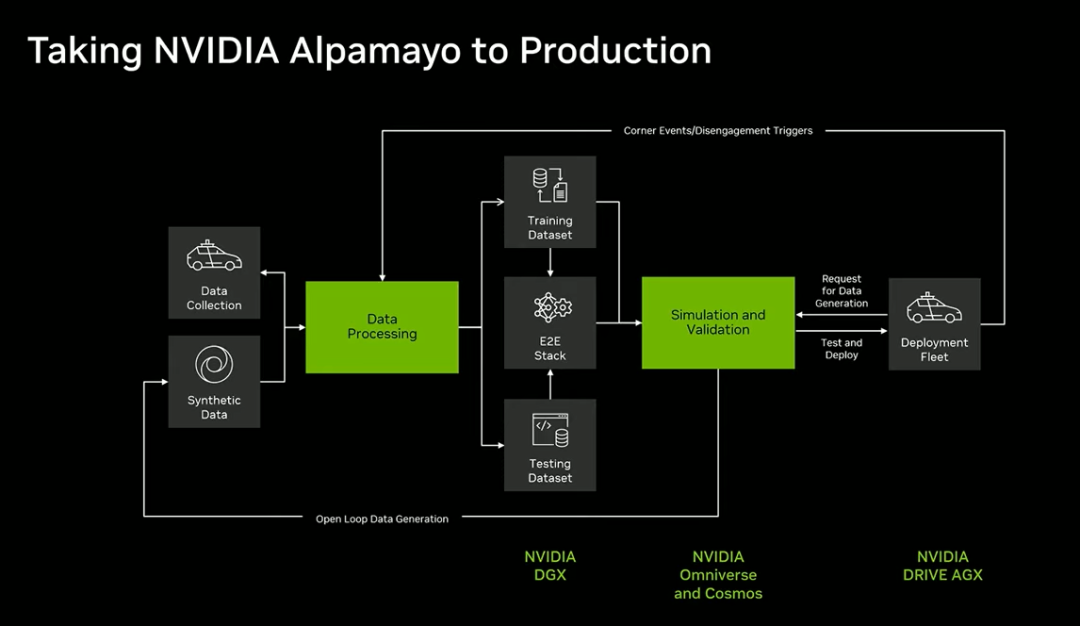

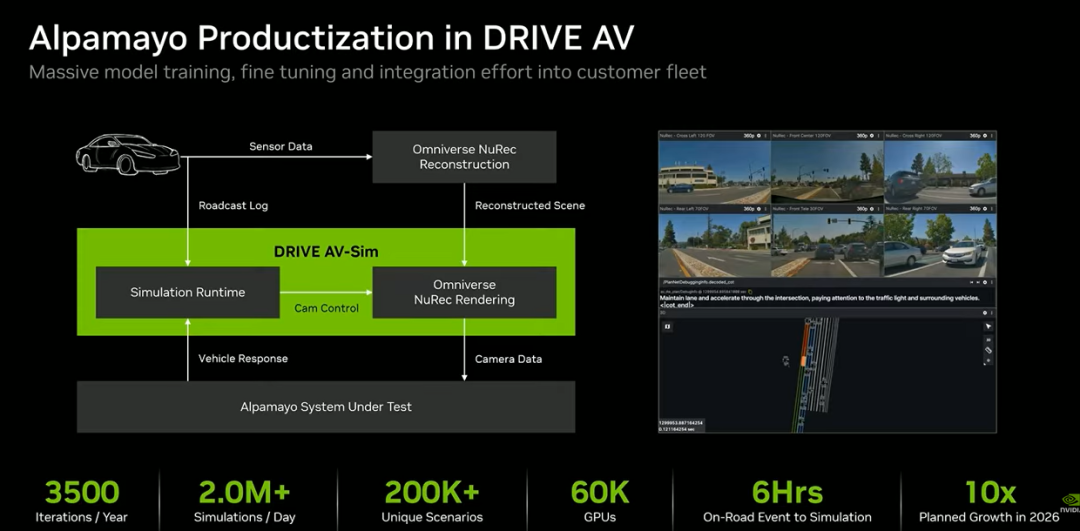

五、生成式 AI 基建:仿真与数据工具,加速模型迭代

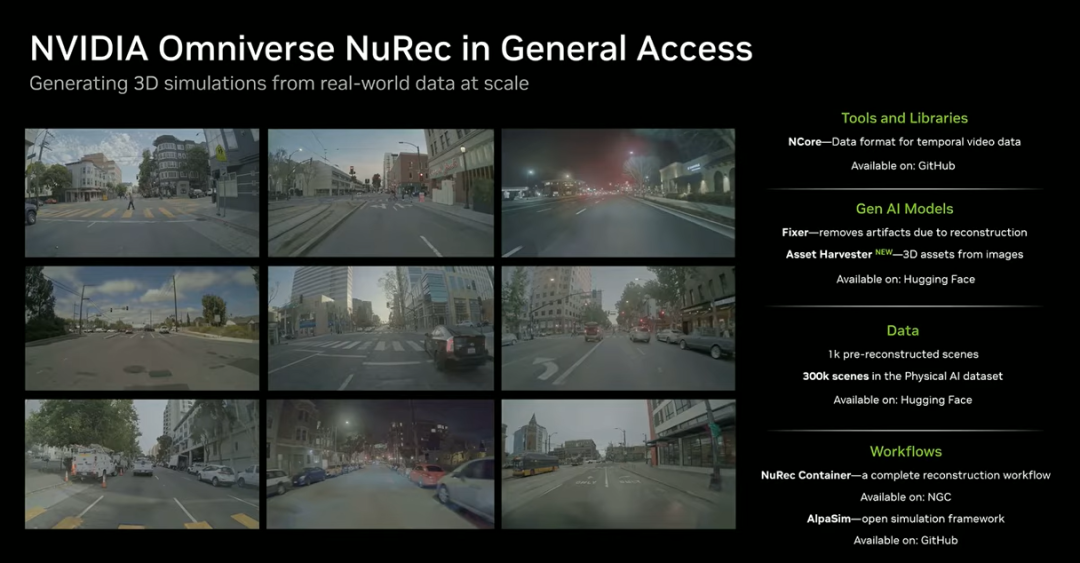

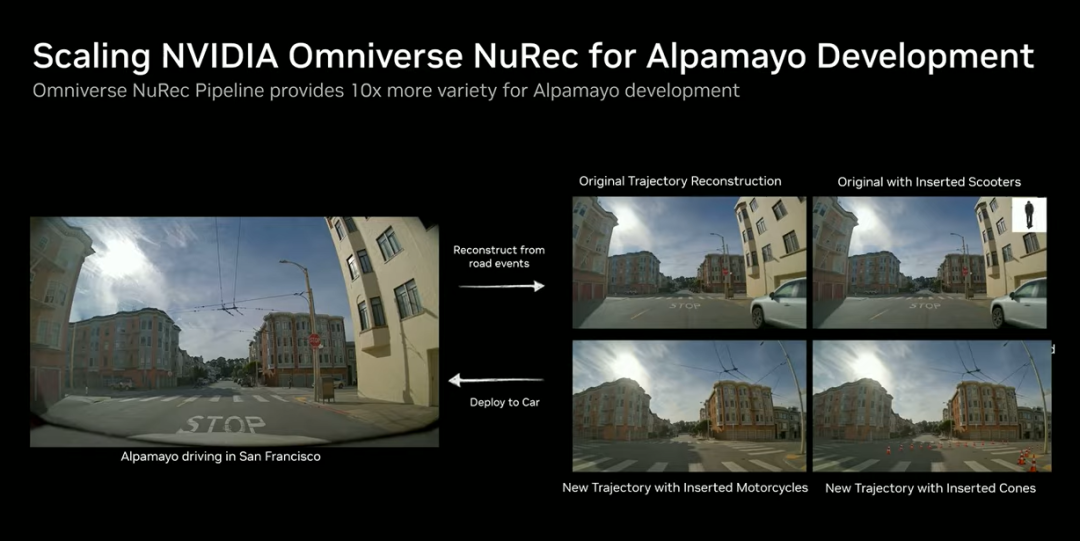

自动驾驶的长尾场景依赖海量数据与仿真验证,英伟达推出两大生成式 AI 工具,解决数据稀缺、验证低效问题。

1. NuRec(神经重建工具)

可重建车辆不同姿态下的像素画面,支持端到端模型闭环验证。

英伟达内部日均运行200 万次仿真测试,支撑 Drive AV 快速迭代。

即将向社区开源,大幅降低行业验证门槛。

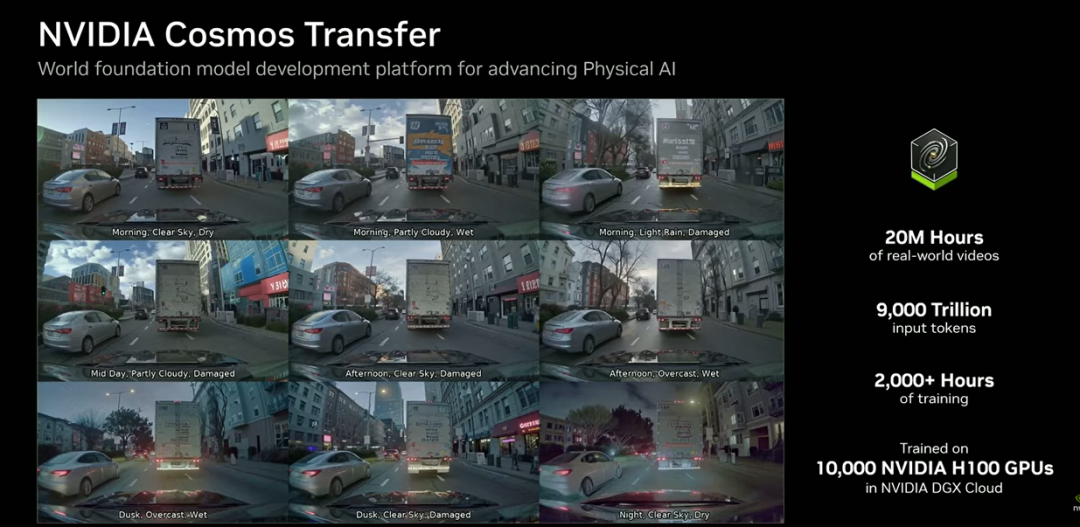

2. Harvester + Fixer + Cosmos Transfer

Harvester:从真实场景中提取任意目标,可插入到其他视频中,扩充场景多样性。

Fixer:修正与生成场景细节,提升数据质量。

Cosmos Transfer:将同一段路测视频,渲染为不同天气、光照、城市、地形,低成本扩充数据维度。

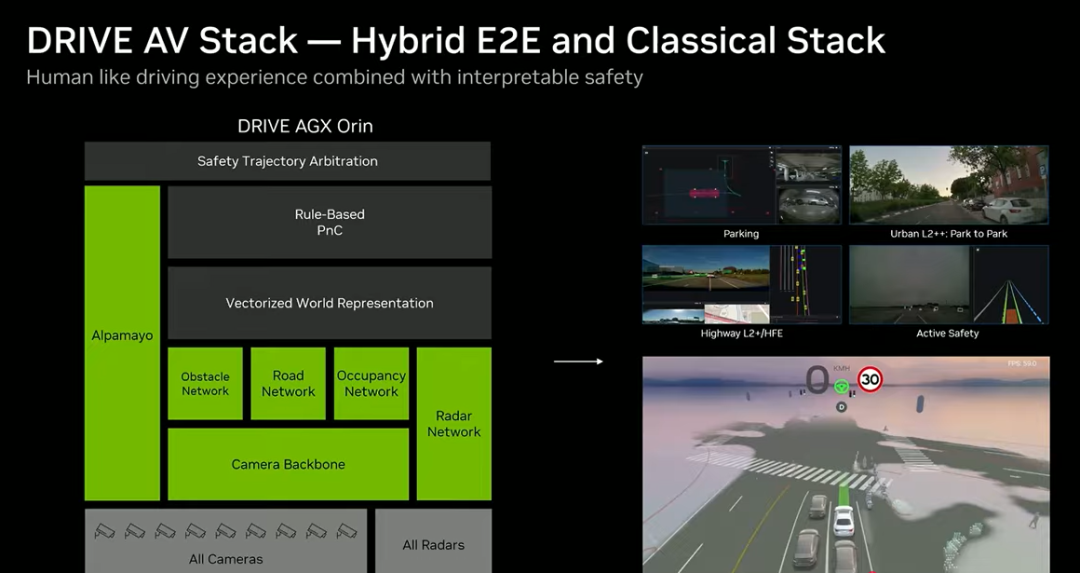

六、量产应用:Drive AV 混合栈,从 L2++ 平滑升级到 L4

英伟达 Drive AV 团队历经十年研发,采用端到端大模型 + 传统算法混合架构,兼顾拟人驾驶体验与功能安全可解释性,满足车规安全要求。

1. 混合栈架构设计

端到端支路:运行量产版 Alpamayo,提供类人驾驶流畅性与复杂场景处理能力。

传统算法支路:提供可解释、符合 ISO 26262 标准的安全决策。

安全仲裁器:实时评估两条支路轨迹,不安全时无缝切换至传统栈,零延迟保障安全。

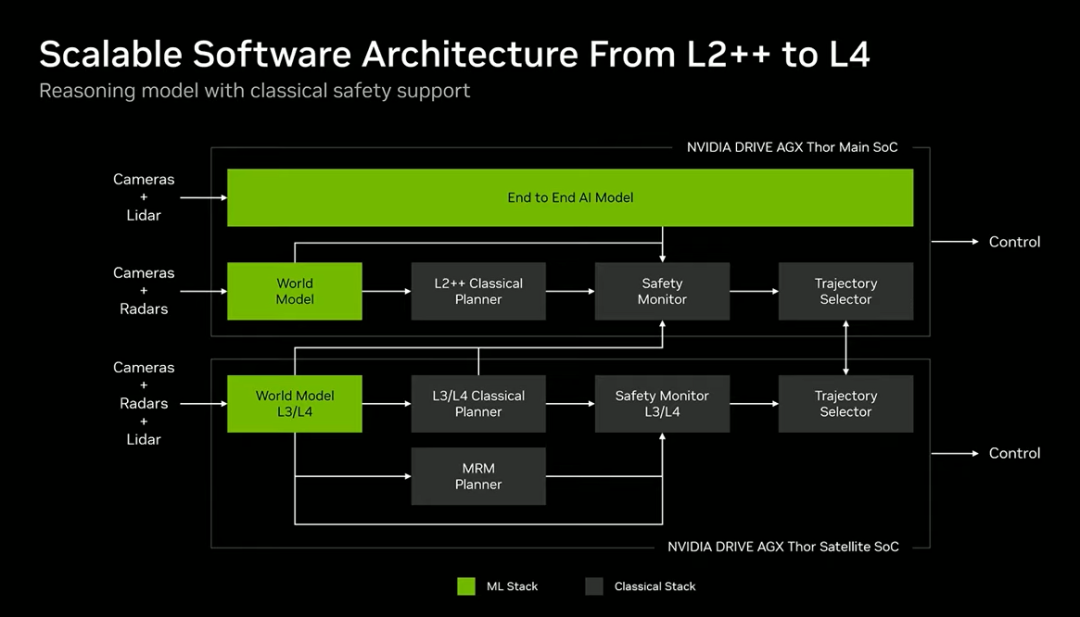

2. 硬件架构:主 ECU + 卫星 ECU 冗余设计

主 ECU:运行现有 L2++ 栈,融合卫星 ECU 传感器数据,提升感知覆盖。

卫星 ECU:安全冗余单元,以传统算法为主,支持最小风险机动(MRM),单点故障时确保车辆安全。

同一代码库同时支持 L2++ 与 L4,降低开发与维护成本。

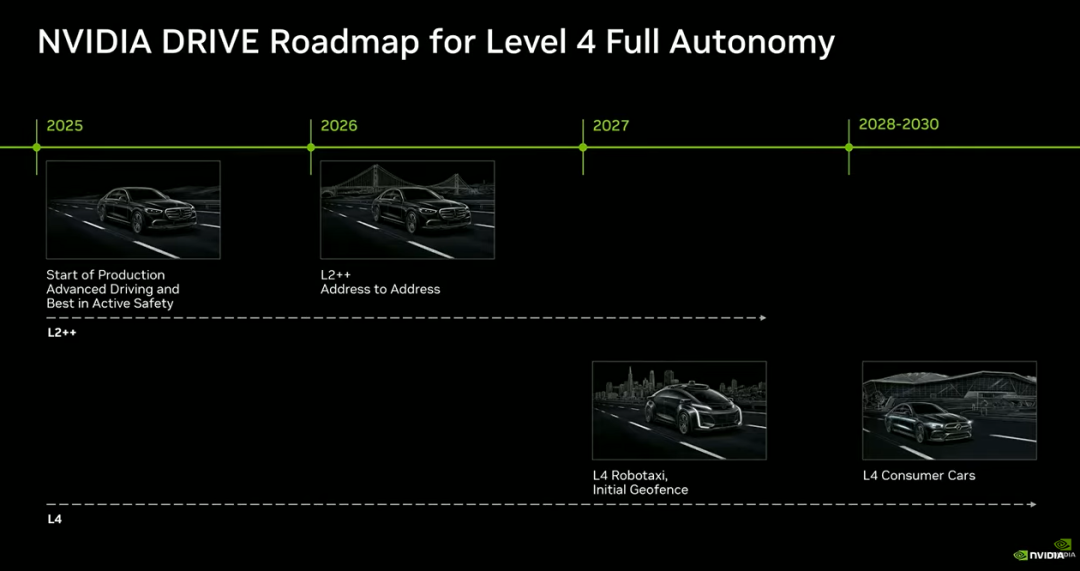

3. 量产落地路线

2025 年:技术已搭载奔驰全球车型(除中国区)。

2026 年:规模落地L2++ 城市点对点脱手驾驶,覆盖美国及欧洲主要城市。

2028 年:在乘用车上规模化部署L4 级全自动驾驶。

七、智能体 AI:端到端重塑自动驾驶全流程

智能体 AI(Agentic AI)是自动驾驶的下一轮变革核心,将全面打通数据、开发、验证、车载体验:

自动化数据开发与验证

用大模型自动完成数据采集、清洗、标注、仿真、迭代,把传统数月的开发周期压缩到小时级。

更智能、自适应的车载体验

车辆可理解自然语言、主动解释决策、自适应路况与乘客习惯,从 “执行工具” 变为 “智能伙伴”。

物理 AI 率先在汽车量产落地

汽车是行走在道路上的机器人,自动驾驶将成为首个大规模量产的物理 AI 应用,也是未来十年最重要的技术挑战。

八、行业使命:从 0.006% 到全面自主化

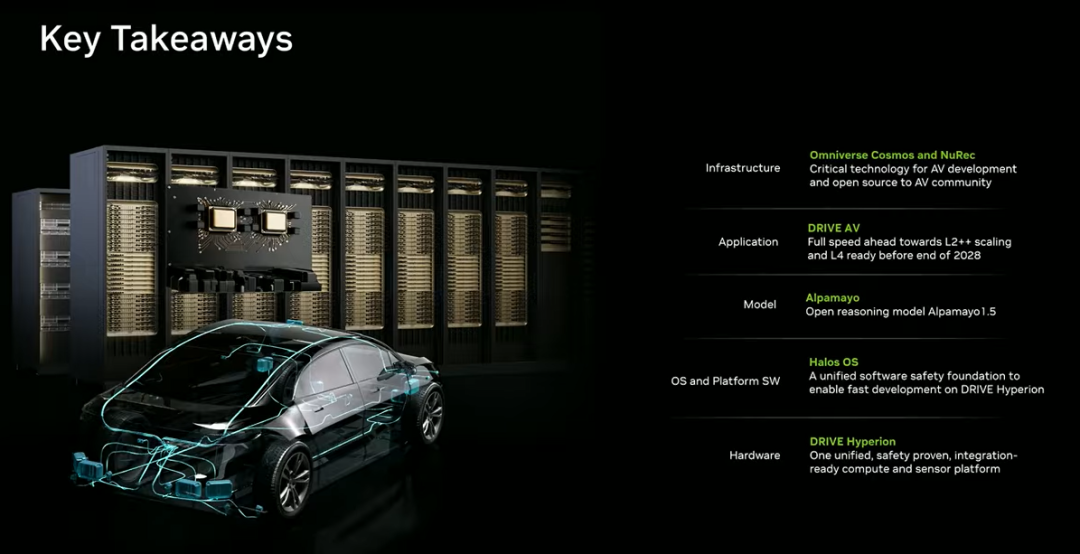

全球每年各类车辆、配送工具总行驶里程约13 万亿英里,但自动驾驶里程仅占0.006%,巨大缺口意味着万亿级市场机遇。英伟达以三台计算机 + 五层服务构建完整体系:

底层:Hyperion 硬件架构

系统层:Halos 安全软件平台

模型层:Alpamayo 系列推理模型

应用层:Drive AV 量产栈

基础设施层:云端大模型、仿真与数据工具全面支撑 OEM、一级供应商、自动驾驶开发者,共同把自动驾驶渗透率从 0.006% 推向 90% 以上。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-04-06,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录