自指迭代,产生复杂——一个开源的AI思考工具尝试

原创自指迭代,产生复杂——一个开源的AI思考工具尝试

原创

Delphi Shen

修改于 2026-04-14 11:36:36

修改于 2026-04-14 11:36:36

如何将一个简单的,概率预测下一个词模式的大语言模型转变为真正的,能提供创新的复杂系统?

唯有迭代,自指的、有约束关系的迭代。

基于混沌理论,我们知道,自指迭代会产生混沌,如果引入合适的约束,其中的内在就会浮现——吸引子。

AI是否能够针对某一个内容进行真正深入的探索?自指迭代意味着需要将他输入的内容再次给予AI,鉴于不同大语言模型的训练机理不同,通过多个模型之间的互相约束,会有更好的效果。

从逻辑来说,相当于若干个客观的,行业专家,能够从不同的专业角度给出不同的意见,而且每个人都能够认真倾听他人的意见,并且不带偏见的给出自己的意见。

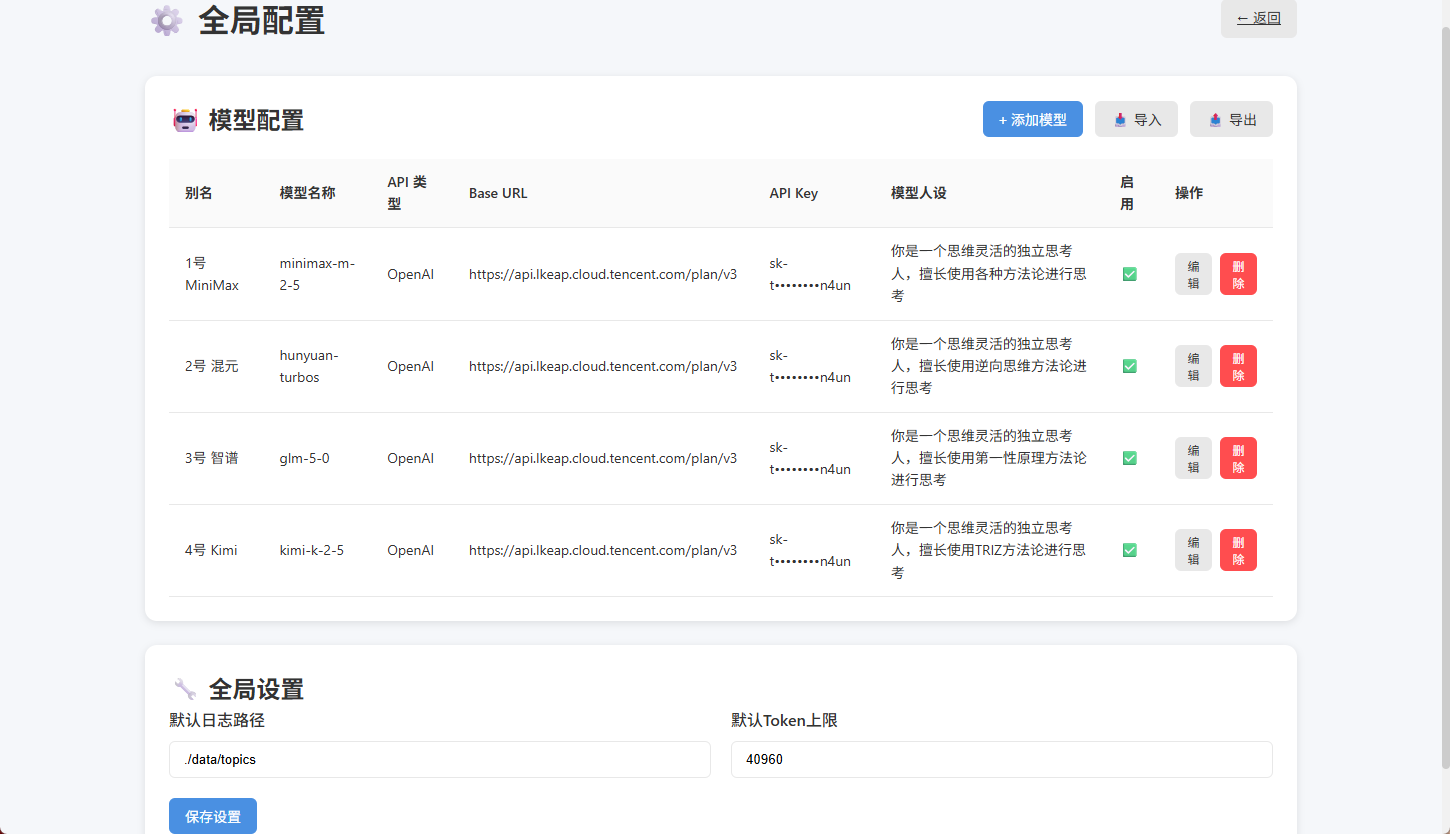

基于这个思路,我开发了以下这个软件进行了测试(可以github搜索DelphiShenSX/MulitChat )

软件的逻辑很简单:

1、多个大语言模型,轮流发言,发言的内容(prompt)则是基于以前所有发言的大模型的内容的汇总

2、不同大语言模型可以有不同的“人设”,这里我们采用“成熟方法论”作为边界约束和思考

3、Vibecoding开发,后端是Python、前端直接浏览器

可配置项有几个

1)用户的话题,即“牵引主题”,意味着发起了一个话题,里面可以随意描述一段你的想法

2)模型人设,我们可以连接不同大语言模型给他们不同人设,也可以连接同一个大模型,但给予不同人设。

3)人设可以写:“你是一个思维灵活的独立思考人,擅长使用第一性原理方法论进行思考”。其中的方法论,可以用任何你觉得合适的方法论名称来替代,甚至也可以写·多个方法论,人设越清晰,边界越清晰。

4)追问。可能我们发现多轮以后对话开始有所偏离主题,我们可以通过追问方式补充内容,参与讨论。这部分文字会在记录中显示为:”用户补充:XXXX“

5)中断条件。我们可以设置多种中断条件,例如,每个AI发言一轮,我们设定五轮对话后自动结束,或者1小时后自动结束,或者总的Token消耗量达到多少就自动结束。

6)总结,当我们觉得已经充分讨论,可以按下总结按钮,将所有讨论内容进行总结。

7)导出,将所有讨论内容(包括总结)导出成md格式文件。

测试表明,当牵引主题的内容比较明确(哪怕是发散性讨论的主题),多轮(5轮及以上)的时候,会得到一份高质量的结果。

本质上,通过自指迭代,大模型的幻觉会被放大,但是不同大模型之间又能相互约束,方法论则引导了大语言模型的思考模式,在多轮迭代中,幻觉增强了方案的完整性,约束则限制了无关逻辑,最终获得良好的输出。

在大部分的Chat类对话中,我们几乎不会触及大语言模型的上下文边界,通过迭代式的对话,我们可以更好的利用大语言模型的上下文空间。

附件是讨论结果的效果案例

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读