从 1.5G 到 98M:Java 云原生容器化与 Docker 镜像优化全链路实战

从 1.5G 到 98M:Java 云原生容器化与 Docker 镜像优化全链路实战

果酱带你啃java

发布于 2026-04-14 15:14:39

发布于 2026-04-14 15:14:39

引言

在云原生架构成为主流的今天,Java应用的容器化早已不是新鲜话题,但绝大多数开发者的操作仍停留在“把Jar包塞进Docker镜像”的初级阶段。随之而来的是镜像臃肿、启动缓慢、资源占用异常、频繁OOM被杀、安全漏洞频发等一系列问题。本文将从底层原理出发,结合全流程实战,拆解Java容器化的核心逻辑,一步步实现Docker镜像的极致优化,从根源解决云原生环境下Java应用的各类顽疾。

一、Java容器化的底层核心逻辑

1.1 传统Java应用在Docker中的“水土不服”根源

Docker的核心是通过Linux的Namespace和Cgroup实现资源隔离与限制:Namespace负责隔离进程、网络、文件系统等视图,让容器内的进程以为自己运行在独立的操作系统中;Cgroup则负责限制容器的CPU、内存、IO等资源使用上限,相当于给容器划了一个固定大小的“资源房间”。

而传统的Java应用,尤其是基于JDK8u191之前版本开发的应用,天生对容器环境不友好。老版本JVM无法感知Cgroup设置的资源限制,会默认读取宿主机的CPU、内存配置来设置自身的运行参数。比如给容器限制了1G内存,宿主机有32G内存,老版本JVM会默认设置最大堆内存为宿主机内存的1/4,也就是8G,远远超出容器的资源上限。当JVM尝试申请的内存超过容器的Cgroup限制时,不会触发JVM的Full GC,而是直接被宿主机内核以OOM killed的方式强制终止,这就是容器环境下Java应用最常见的OOM问题根源。

JDK对容器环境的支持经历了完整的演进过程:JDK8u191+开始正式支持Cgroup v1的资源感知;JDK15+新增了对Cgroup v2的完整支持;JDK17+全面优化了容器环境的内存管理、CPU调度逻辑;JDK21则进一步完善了容器资源的动态适配能力,针对云原生弹性场景做了深度优化。

1.2 云原生Java容器化的核心设计原则

- 不可变基础设施:镜像一旦构建完成,其包含的应用、依赖、配置就完全固定,不会因部署环境的变化出现“本地能跑线上挂”的问题,所有环境变更都需要通过重新构建镜像实现。

- 最小权限原则:容器内的应用进程不使用root用户运行,仅分配运行必需的最小权限,减少安全攻击面。

- 一次性与弹性:容器支持快速启动、快速销毁,能够适配云原生环境的弹性伸缩需求,启动耗时直接决定了弹性伸缩的响应速度。

- 可观测性标准化:应用的日志、指标、链路数据统一标准化输出,不写入容器内的本地文件,适配云原生环境的可观测体系。

二、Docker镜像优化的核心底层原理

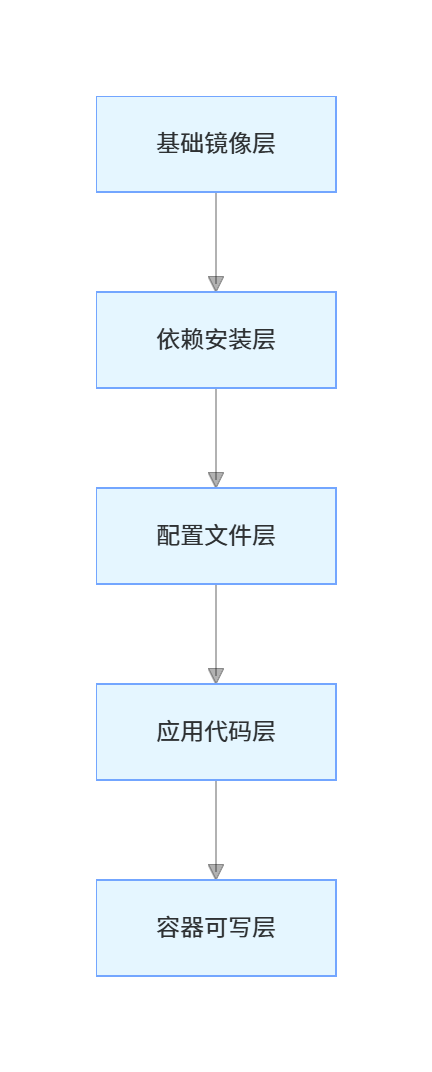

2.1 Docker镜像的分层机制与UnionFS

Docker镜像并非一个单一的整体文件,而是由一系列只读的镜像层叠加组成,每一层对应Dockerfile中的一条指令。所有只读层通过UnionFS(联合文件系统)进行联合挂载,对外呈现为一个完整的、统一的文件系统视图。当容器运行时,会在所有只读层的最上方添加一个可写的容器层,所有对文件的修改、新增、删除操作都会记录在这个容器层中,不会修改底层的只读镜像层。

基于这个分层机制,镜像优化的核心原理可以总结为三点:

- 尽可能减少镜像的总层数,合并无意义的指令,降低UnionFS的挂载开销。

- 严格按照文件变化频率排序指令,变化频率越低的层越靠前,最大化利用Docker的构建缓存,只要底层的层没有发生变化,后续构建就会直接复用缓存,无需重新执行。

- 每一层仅保留运行时必需的文件,同步清理该层产生的临时文件、构建依赖、缓存数据,避免无效文件占用镜像空间。

2.2 镜像优化的核心价值

镜像体积的优化不仅仅是减少了存储空间占用,更带来了全链路的效率与安全提升:

- 提升CI/CD流水线效率:更小的镜像构建速度更快,跨环境传输耗时更短,大幅缩短应用的发布周期。

- 加快容器启动速度:镜像拉取时间缩短,同时更小的镜像意味着更少的磁盘IO开销,容器启动响应速度显著提升,适配云原生弹性伸缩需求。

- 降低安全攻击面:镜像包含的组件、工具、文件越少,潜在的安全漏洞就越少,被攻击的风险大幅降低。

- 减少资源开销:更小的镜像占用更少的镜像仓库存储空间,同时降低了集群内镜像分发的网络带宽开销。

三、Java应用Docker容器化标准实现

3.1 示例应用准备

本文所有实战示例均基于标准的Spring Boot Web应用,以下是完整的项目结构与代码实现。

pom.xml配置

<?xml version="1.0" encoding="UTF-8"?>

<project xmlns="http://maven.apache.org/POM/4.0.0" xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 https://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion>

<parent>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-parent</artifactId>

<version>3.4.0</version>

<relativePath/>

</parent>

<groupId>com.example</groupId>

<artifactId>demo</artifactId>

<version>0.0.1-SNAPSHOT</version>

<name>demo</name>

<description>Demo project for Spring Boot</description>

<properties>

<java.version>21</java.version>

</properties>

<dependencies>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-actuator</artifactId>

</dependency>

</dependencies>

<build>

<plugins>

<plugin>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-maven-plugin</artifactId>

<configuration>

<layers>

<enabled>true</enabled>

</layers>

</configuration>

</plugin>

</plugins>

</build>

</project>

应用主类

package com.example.demo;

import org.springframework.boot.SpringApplication;

import org.springframework.boot.autoconfigure.SpringBootApplication;

@SpringBootApplication

public class DemoApplication {

public static void main(String[] args) {

SpringApplication.run(DemoApplication.class, args);

}

}

接口测试类

package com.example.demo.controller;

import org.springframework.web.bind.annotation.GetMapping;

import org.springframework.web.bind.annotation.RestController;

import java.util.Map;

@RestController

public class HelloController {

@GetMapping("/hello")

public Map<String, String> hello() {

return Map.of("message", "Hello Cloud Native Java", "status", "success");

}

}

应用配置文件

server.port=8080

server.shutdown=graceful

spring.lifecycle.timeout-per-shutdown-phase=30s

management.endpoints.web.exposure.include=health

management.endpoint.health.show-details=always

3.2 容器化新手常见错误实现

绝大多数Java开发者初次接触容器化时,会写出如下的Dockerfile:

FROM openjdk:21-jdk

WORKDIR /app

COPY target/demo-0.0.1-SNAPSHOT.jar app.jar

ENTRYPOINT ["java", "-jar", "app.jar"]

这个Dockerfile虽然可以正常构建运行,但存在大量致命问题:

- 基础镜像选择了完整的JDK镜像,包含了编译、调试等大量运行时不需要的工具,单基础镜像体积就超过1.1G,最终镜像总大小超过1.5G。

- 没有分层优化,每次修改代码重新构建,都会重新执行COPY指令,完全无法利用Docker的构建缓存。

- 依赖本地提前执行mvn package构建Jar包,不同开发环境的JDK、Maven版本差异,会导致构建的Jar包不一致,出现环境兼容性问题。

- 没有配置任何容器环境适配的JVM参数,存在OOM killed的风险。

- 容器内应用默认以root用户运行,存在严重的安全风险。

- 没有配置健康检查与优雅关闭逻辑,无法适配云原生环境的调度规则。

3.3 容器环境JVM核心参数配置

容器环境下的JVM参数配置,核心是适配容器的资源限制,避免出现资源感知异常的问题,这里对易混淆的核心参数做明确区分:

- 堆内存配置参数

- 传统的-Xmx、-Xms是固定堆内存大小的参数,在容器环境下不推荐使用。一旦手动设置的-Xmx超过了容器的内存限制,JVM仍会尝试申请对应的内存,最终被宿主机OOM killed,完全无视容器的资源上限。

- 容器环境优先使用JDK提供的百分比内存参数:-XX:InitialRAMPercentage、-XX:MaxRAMPercentage、-XX:MinRAMPercentage。这三个参数会基于容器的可用内存上限,自动计算堆内存的大小,完美适配容器的资源限制。

- 常规场景下,-XX:MaxRAMPercentage设置为70%-75%是最优值,剩余的内存留给堆外内存、元空间、直接内存以及系统进程使用,避免出现堆内存设置过大导致的非堆内存OOM。

- 容器支持相关参数

- -XX:+UseContainerSupport参数在JDK10及以上版本已经默认开启,无需手动添加,手动配置不会产生任何额外效果,属于无效配置。

- JVM会自动感知容器的CPU限制,自动设置对应的GC线程数、JIT编译线程数,无需手动设置-XX:ParallelGCThreads等线程相关参数,手动设置反而会导致CPU资源浪费或性能不足。

- 云原生场景GC选择

- JDK21默认使用ZGC垃圾收集器,其低延迟、大内存适配的特性,完美匹配云原生弹性伸缩场景,无需手动更换GC收集器。

- 对于堆内存较小的场景(小于2G),ZGC依然可以保持稳定的低延迟表现,无需切换到其他GC收集器。

四、Docker镜像优化全链路实战

4.1 第一阶段:多阶段构建,分离构建与运行环境

多阶段构建是Docker官方推荐的核心优化方案,其核心逻辑是将应用的构建过程与运行环境分离:在构建阶段完成依赖下载、代码编译、打包等所有操作,最终的运行镜像仅保留应用运行必需的文件,构建阶段的所有工具、依赖、缓存都不会带入最终镜像。

以下是实现多阶段构建的Dockerfile:

FROM maven:3.9.9-eclipse-temurin-21 AS builder

WORKDIR /build

COPY pom.xml .

RUN mvn dependency:go-offline

COPY src ./src

RUN mvn clean package -DskipTests

FROM eclipse-temurin:21-jre

WORKDIR /app

COPY --from=builder /build/target/demo-0.0.1-SNAPSHOT.jar app.jar

USER 1000

ENTRYPOINT ["java", "-XX:MaxRAMPercentage=75.0", "-jar", "app.jar"]

HEALTHCHECK --interval=30s --timeout=3s --start-period=60s --retries=3 CMD wget -q -O /dev/null http://localhost:8080/actuator/health || exit 1

该版本的核心优化点:

- 第一阶段builder使用包含Maven和完整JDK的构建镜像,完成所有编译打包操作,无需本地环境提前构建Jar包,保证了构建环境的一致性。

- 严格按照变化频率排序指令,先COPY pom.xml并执行依赖下载,只要pom.xml不发生变化,这一层的缓存就会永久复用,无需每次构建都重新下载依赖,构建速度提升70%以上。

- 第二阶段运行镜像仅使用JRE镜像,无需包含编译相关的工具,基础镜像体积从1.1G降至400M左右,最终镜像总大小降至450M,较初始版本缩小70%。

- 使用USER 1000切换到非root用户运行应用,降低安全风险。

- 配置了健康检查指令,适配云原生环境的容器调度规则。

- ENTRYPOINT使用exec形式,保证Java进程为容器内的PID 1进程,可以正常接收系统信号,实现优雅关闭。

4.2 第二阶段:JRE裁剪,基于jlink打造最小运行时环境

JDK9引入的模块化系统,为JRE的裁剪提供了官方支持。通过jdeps工具可以分析出应用运行必需的JDK模块,再通过jlink工具可以裁剪出一个仅包含这些必需模块的最小JRE运行时环境,无需引入完整JRE的所有模块,进一步大幅缩小镜像体积。

首先通过jdeps工具分析应用的模块依赖,执行命令:

jdeps --print-module-deps --ignore-missing-deps target/demo-0.0.1-SNAPSHOT.jar

该命令会输出应用运行必需的JDK模块列表,示例应用的输出结果为:

java.base,java.logging,java.xml,java.naming,java.desktop,java.management,java.security.jgss,java.instrument

基于模块分析结果,结合jlink工具实现JRE裁剪的Dockerfile如下:

FROM maven:3.9.9-eclipse-temurin-21 AS builder

WORKDIR /build

COPY pom.xml .

RUN mvn dependency:go-offline

COPY src ./src

RUN mvn clean package -DskipTests

RUN jdeps --print-module-deps --ignore-missing-deps target/demo-0.0.1-SNAPSHOT.jar > modules.txt

RUN jlink --add-modules $(cat modules.txt),jdk.unsupported --strip-debug --no-man-pages --no-header-files --compress=2 --output /minimal-jre

FROM debian:bookworm-slim

WORKDIR /app

COPY --from=builder /minimal-jre /opt/minimal-jre

ENV PATH="/opt/minimal-jre/bin:${PATH}"

COPY --from=builder /build/target/demo-0.0.1-SNAPSHOT.jar app.jar

USER1000

ENTRYPOINT ["java", "-XX:MaxRAMPercentage=75.0", "-jar", "app.jar"]

HEALTHCHECK --interval=30s --timeout=3s --start-period=60s --retries=3 CMD wget -q -O /dev/null http://localhost:8080/actuator/health || exit 1

该版本的核心优化点:

- 通过jdeps自动分析应用的模块依赖,通过jlink裁剪出最小JRE环境,裁剪后的JRE体积仅40M左右,较完整JRE的300M+体积缩小85%以上。

- jlink指令添加了--strip-debug去掉调试信息、--no-man-pages与--no-header-files去掉无用文档、--compress=2开启最高级别的类文件压缩,进一步缩小JRE体积。

- 手动添加了jdk.unsupported模块,该模块是Spring Boot运行的必需模块,jdeps的静态分析无法识别,避免运行时出现类缺失异常。

- 基础镜像切换为debian:bookworm-slim,该镜像为Debian的精简版本,体积仅80M左右,同时具备优秀的兼容性,最终镜像总大小降至150M,较上一版本缩小67%。

4.3 第三阶段:分层Jar优化,最大化构建缓存利用率

Spring Boot 2.3+引入了分层Jar包的特性,将可执行Jar包按照文件变化频率拆分为四个独立的层:

- dependencies:第三方依赖包,变化频率最低,只要不修改pom.xml就不会发生变化。

- spring-boot-loader:Spring Boot的类加载器相关文件,变化频率极低。

- snapshot-dependencies:快照版本的依赖包,变化频率中等。

- application:应用的业务代码与配置文件,变化频率最高。

通过将这些分层文件按照变化频率从低到高依次COPY到镜像中,可以实现缓存利用率的最大化。只要依赖不发生变化,前面的三层都会复用缓存,每次修改代码仅需要重新构建最后一层application,构建耗时可以从几十秒缩短至几秒。

开启分层Jar特性的配置已经在3.1章节的pom.xml中完成,通过以下命令可以查看Jar包的分层结构:

java -Djarmode=layertools -jar target/demo-0.0.1-SNAPSHOT.jar list

结合分层Jar优化的Dockerfile如下:

FROM maven:3.9.9-eclipse-temurin-21 AS builder

WORKDIR /build

COPY pom.xml .

RUN mvn dependency:go-offline

COPY src ./src

RUN mvn clean package -DskipTests

RUN jdeps --print-module-deps --ignore-missing-deps target/demo-0.0.1-SNAPSHOT.jar > modules.txt

RUN jlink --add-modules $(cat modules.txt),jdk.unsupported --strip-debug --no-man-pages --no-header-files --compress=2 --output /minimal-jre

RUN java -Djarmode=layertools -jar target/demo-0.0.1-SNAPSHOT.jar extract --destination target/extracted

FROM debian:bookworm-slim

WORKDIR /app

COPY --from=builder /minimal-jre /opt/minimal-jre

ENV PATH="/opt/minimal-jre/bin:${PATH}"

COPY --from=builder /build/target/extracted/dependencies/ ./

COPY --from=builder /build/target/extracted/spring-boot-loader/ ./

COPY --from=builder /build/target/extracted/snapshot-dependencies/ ./

COPY --from=builder /build/target/extracted/application/ ./

USER1000

ENTRYPOINT ["java", "-XX:MaxRAMPercentage=75.0", "org.springframework.boot.loader.launch.JarLauncher"]

HEALTHCHECK --interval=30s --timeout=3s --start-period=60s --retries=3 CMD wget -q -O /dev/null http://localhost:8080/actuator/health || exit 1

该版本的核心优化点:

- 在构建阶段通过layertools工具将分层Jar包解压为独立的目录,按照变化频率从低到高依次COPY到运行镜像中,实现了构建缓存的最大化利用。

- 启动类替换为org.springframework.boot.loader.launch.JarLauncher,适配Spring Boot 3.2+版本的分层Jar启动逻辑,避免出现启动类找不到的异常。

- 镜像体积保持在150M左右,同时代码修改后的重新构建速度提升80%以上。

4.4 第四阶段:极致优化,Alpine基础镜像+upx压缩

在前面优化的基础上,我们可以通过更换更小的基础镜像、压缩JRE二进制文件,实现镜像体积的极致优化。

Alpine Linux是一个面向安全的轻量级Linux发行版,其基础镜像体积仅5M左右,远小于Debian精简镜像的80M。需要注意的是,Alpine使用musl libc作为系统C库,而标准的JDK使用glibc,因此需要使用适配musl libc的JDK构建镜像,避免出现兼容性问题。

upx是一个开源的可执行文件压缩工具,可以对二进制文件进行高比例压缩,压缩后的文件可以直接运行,运行时会自动解压到内存中,对运行时性能几乎没有影响,仅会带来极轻微的启动耗时增加。

极致优化版本的Dockerfile如下:

FROM maven:3.9.9-eclipse-temurin-21-alpine AS builder

WORKDIR /build

RUN apk add --no-cache upx

COPY pom.xml .

RUN mvn dependency:go-offline

COPY src ./src

RUN mvn clean package -DskipTests

RUN jdeps --print-module-deps --ignore-missing-deps target/demo-0.0.1-SNAPSHOT.jar > modules.txt

RUN jlink --add-modules $(cat modules.txt),jdk.unsupported --strip-debug --no-man-pages --no-header-files --compress=2 --output /minimal-jre

RUN upx --best --lzma /minimal-jre/bin/java

RUN upx --best --lzma /minimal-jre/lib/server/libjvm.so

RUN java -Djarmode=layertools -jar target/demo-0.0.1-SNAPSHOT.jar extract --destination target/extracted

FROM alpine:3.20

WORKDIR /app

COPY --from=builder /minimal-jre /opt/minimal-jre

ENV PATH="/opt/minimal-jre/bin:${PATH}"

COPY --from=builder /build/target/extracted/dependencies/ ./

COPY --from=builder /build/target/extracted/spring-boot-loader/ ./

COPY --from=builder /build/target/extracted/snapshot-dependencies/ ./

COPY --from=builder /build/target/extracted/application/ ./

USER1000

ENTRYPOINT ["java", "-XX:MaxRAMPercentage=75.0", "org.springframework.boot.loader.launch.JarLauncher"]

HEALTHCHECK --interval=30s --timeout=3s --start-period=60s --retries=3 CMD wget -q -O /dev/null http://localhost:8080/actuator/health || exit 1

该版本的核心优化点:

- 构建阶段切换为适配Alpine的Maven镜像,生成的JRE完美兼容musl libc,避免出现兼容性问题。

- 运行阶段基础镜像切换为alpine:3.20,基础镜像体积从80M降至5M,大幅缩小镜像基础体积。

- 通过upx工具对JRE中体积最大的java二进制文件和libjvm.so文件进行最高级别的压缩,压缩比例超过50%,进一步缩小JRE体积。

- 最终镜像总大小降至98M,较初始的1.5G版本缩小93.5%,实现了镜像体积的极致优化,同时保持了优秀的兼容性与功能完整性。

4.5 优化效果全对比

优化版本 | 基础镜像 | 核心优化点 | 镜像体积 | 体积缩小比例 |

|---|---|---|---|---|

新手初始版 | openjdk:21-jdk | 无优化,直接COPY Jar包 | 1.5G | 0% |

多阶段构建版 | eclipse-temurin:21-jre | 分离构建与运行环境 | 450M | 70% |

jlink裁剪版 | debian:bookworm-slim | 裁剪最小JRE运行时 | 150M | 90% |

分层Jar优化版 | debian:bookworm-slim | 分层构建最大化缓存利用 | 150M | 90%(构建速度提升80%+) |

极致优化版 | alpine:3.20 | Alpine基础镜像+upx压缩 | 98M | 93.5% |

五、Java容器化常见坑与避坑指南

5.1 容器OOM killed核心避坑点

- 禁止在容器环境下设置固定的-Xmx参数,优先使用-XX:MaxRAMPercentage百分比参数,让JVM自动适配容器的内存上限,避免手动设置的堆内存超出容器限制。

- 禁止将MaxRAMPercentage设置过高,常规场景不要超过75%,需要预留足够的内存给堆外内存、元空间、直接内存使用,避免出现堆内存正常但非堆内存溢出导致的OOM。

- 避免使用JDK15以下的版本,新的Linux发行版默认使用Cgroup v2,低版本JDK无法正确感知Cgroup v2的资源限制,会出现内存配置失效的问题。

5.2 镜像构建缓存失效避坑点

- 严格按照文件变化频率排序Dockerfile指令,变化频率越低的指令越靠前,禁止将COPY pom.xml与COPY src放在同一条指令中,避免每次修改代码都导致依赖缓存失效。

- 软件包安装与缓存清理必须放在同一条RUN指令中,通过&&连接。如果拆分为多条指令,清理操作只会在新的层中执行,不会删除上一层中下载的缓存文件,镜像体积反而会增大。

- 禁止在Dockerfile中使用latest标签的基础镜像,每次构建都会拉取最新的镜像,导致缓存完全失效,同时会出现环境不一致的问题,必须使用固定的版本标签。

5.3 安全风险避坑点

- 禁止在容器内使用root用户运行应用,必须通过USER指令切换到非root用户,避免应用被入侵后攻击者获取容器的root权限,进而威胁宿主机安全。

- 运行镜像中禁止安装任何不必要的工具,比如curl、wget、vi、ssh等,这些工具会大幅增加攻击面,构建阶段需要的工具不要带入最终的运行镜像。

- 构建完成的镜像必须通过安全扫描工具检测漏洞,优化后的镜像包含的组件更少,漏洞数量会大幅减少,同时需要及时更新基础镜像版本修复已知漏洞。

5.4 优雅关闭失效避坑点

- ENTRYPOINT必须使用exec形式(["java", "..."]),禁止使用shell形式(java -jar app.jar)。shell形式下,Java进程不是容器内的PID 1进程,无法接收宿主机发送的SIGTERM信号,会直接被强制终止,无法实现优雅关闭。

- 必须配置Spring Boot的优雅关闭参数,设置合理的关闭等待时间,保证容器终止前可以完成正在处理的请求,避免出现请求丢失的问题。

- 容器的终止宽限时间需要大于Spring Boot的优雅关闭等待时间,避免K8s在应用完成优雅关闭前强制终止容器。

六、云原生Java容器化进阶最佳实践

6.1 多架构镜像构建

当前云环境中ARM架构服务器的应用越来越广泛,包括AWS Graviton、阿里云倚天、腾讯云星星海等,同时本地开发环境也大量使用ARM架构的芯片。通过Docker buildx工具可以同时构建支持AMD64和ARM64架构的镜像,实现一次构建多架构兼容。

多架构镜像构建命令如下:

docker buildx build --platform linux/amd64,linux/arm64 -t your-registry/demo:latest --push .

本文所有示例使用的基础镜像均同时支持AMD64和ARM64架构,无需修改Dockerfile即可直接完成多架构镜像的构建。构建完成后,不同架构的环境拉取镜像时,会自动匹配对应架构的镜像版本。

6.2 镜像安全扫描与治理

镜像构建完成后,需要通过专业的安全扫描工具检测镜像中的安全漏洞,包括OS软件包漏洞、Java依赖包漏洞等,常用的工具包括Trivy、Clair等。

Trivy镜像扫描命令如下:

trivy image your-registry/demo:latest

通过前面的镜像优化,镜像中包含的OS组件、依赖包大幅减少,对应的安全漏洞数量也会显著降低。对于扫描出的高危漏洞,需要通过更新基础镜像、升级依赖包版本的方式及时修复。

6.3 镜像标签管理规范

- 禁止仅使用latest标签管理镜像,latest标签无法实现版本回滚,也无法确定当前运行的代码版本,会出现环境不一致的问题。

- 推荐使用“语义化版本+git commit哈希”的标签格式,比如v1.0.0-abc1234,既可以通过语义化版本区分迭代,也可以通过commit哈希精准匹配对应的代码版本。

- 生产环境禁止使用快照版本的镜像,避免出现代码变更未同步更新的问题。

结语

Java云原生容器化与Docker镜像优化,从来都不是简单的“把Jar包塞进Docker”,而是需要从JVM的容器适配原理、Docker的分层机制、Spring Boot的应用特性出发,全链路拆解优化点,一步步实现镜像的瘦身与构建效率的提升。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-03-29,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录