GLM-5.1悄悄上线了,国内断档领先!

前言

大家好,我是苏三。

3月27日,智谱在用户社群里直接丢下一颗“深夜炸弹”:Coding Plan 全体用户即刻升级到最新旗舰 GLM-5.1。

没有推文,没有长篇 benchmark,也没有营销预热,直接让你用。

重点不是“发了个新版本”。

重点是这波动作很干脆:没有长篇跑分海报,没有 benchmark 对比图,直接上线给所有人用。

一句话概括:GLM-5.1已经全量可用,且这次是拿真实体验说话。

一、这波“直接上线”说明了什么?

很多人会把它当成一次普通版本升级,但我觉得不是。

如果一家公司对模型效果没有把握,通常会先做很多外围包装:参数解释、榜单截图、分数强调。

而这次智谱的做法是:不铺垫,直接放给用户跑真实任务。

这个动作像谁?

很像当初 DeepSeek 的节奏:不搞过度营销,直接让工程师上手,用结果说话。

这背后其实是一个信号:

- 不希望你被“宣传材料”说服

- 希望你被“实际交付能力”说服

说明智谱对GLM-5.1这个版本非常自信。

二、我测试了一下

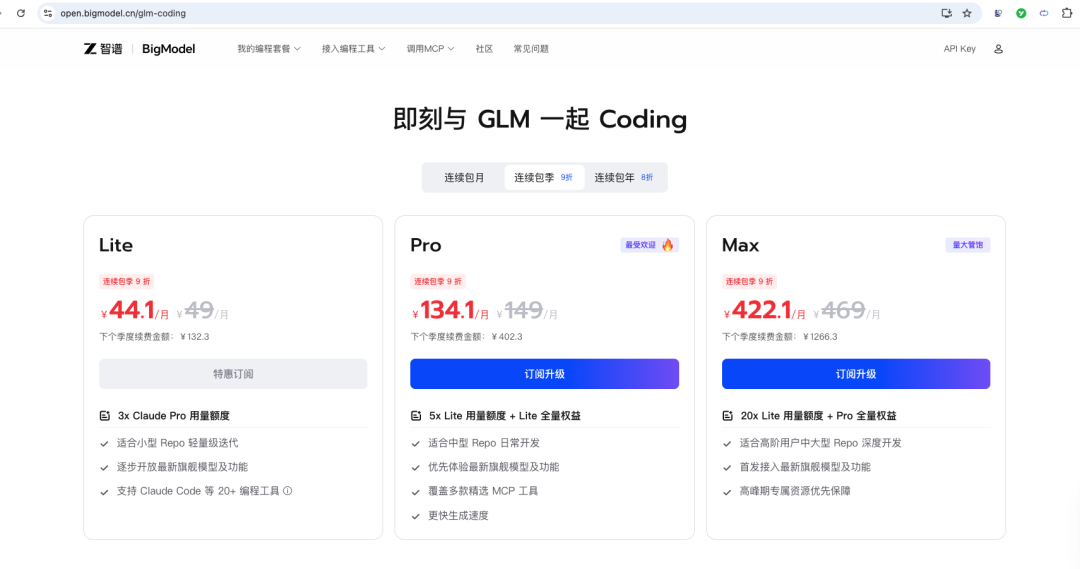

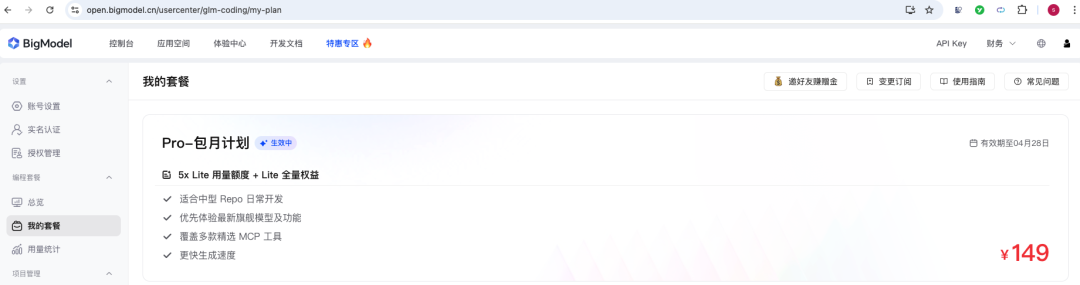

这两天,我到智谱的官网:https://bigmodel.cn/glm-coding

订阅了一个月的Coding Plan。

为了避免“短问题看不出差异”,我专门选了两类高消耗任务:

- 长链路:步骤多、依赖多、上下文长,最容易中途跑偏

- 重交付:不是回答一个点,而是要最终产出能跑的结果

2.1 如何使用GLM-5.1?

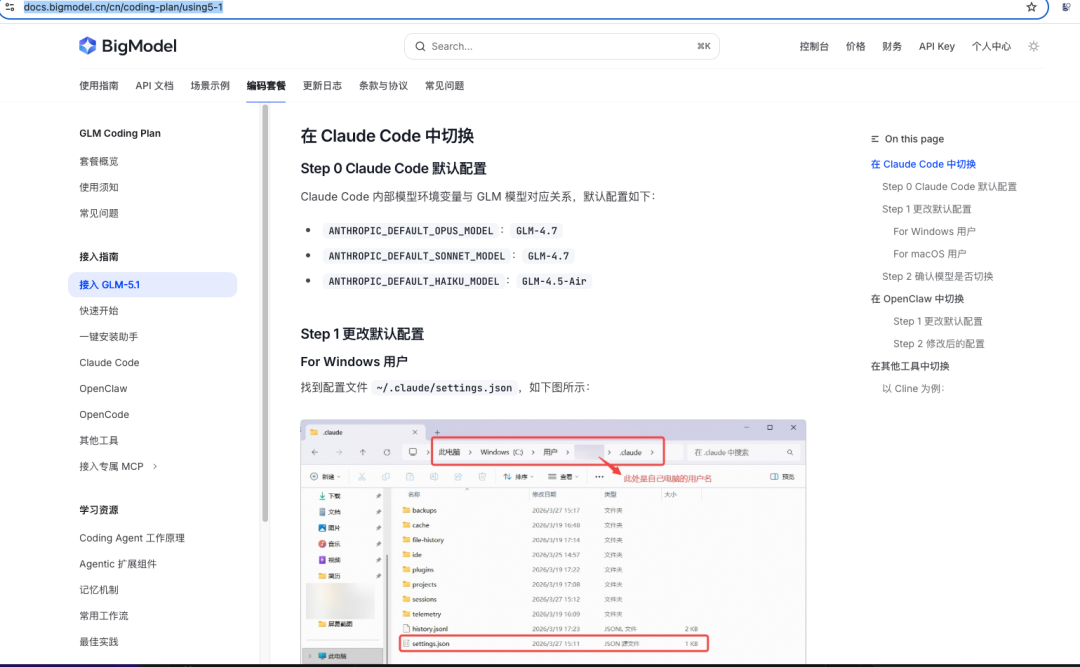

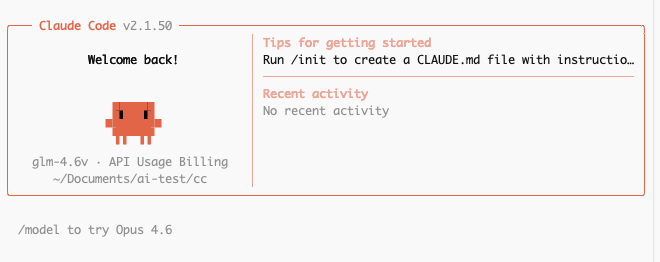

订阅了智谱的Coding Plan之后,访问官方文档:https://docs.bigmodel.cn/cn/coding-plan/using5-1

可以看到接入GLM-5.1的文档:

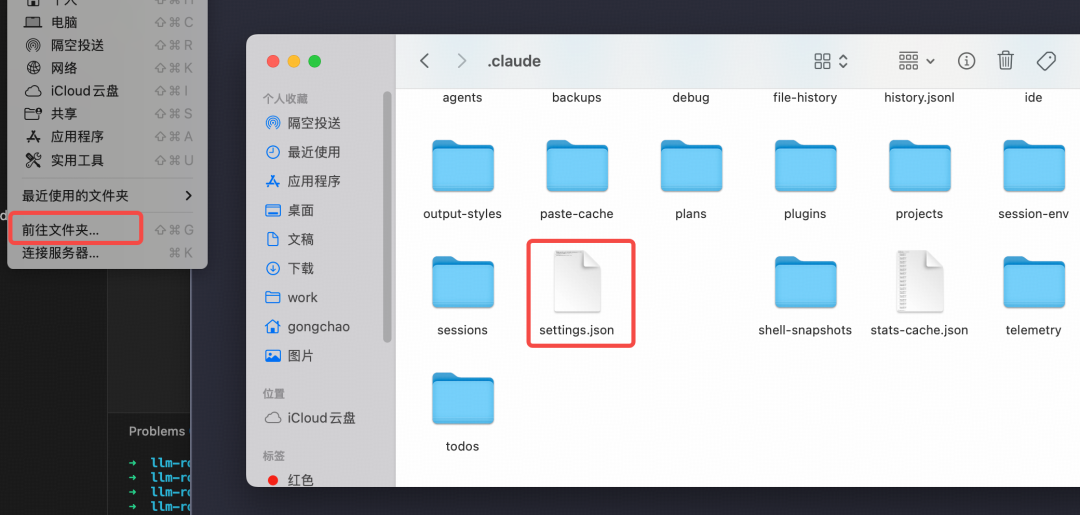

打开~/.claude/settings.json文件:

使用 GLM-5.1,需要在配置文件 settings.json 中,添加或替换如下环境变量参数:

{

"env": {

"ANTHROPIC_DEFAULT_HAIKU_MODEL": "GLM-4.5-air",

"ANTHROPIC_DEFAULT_SONNET_MODEL": "GLM-5.1",

"ANTHROPIC_DEFAULT_OPUS_MODEL": "GLM-5.1"

}

}

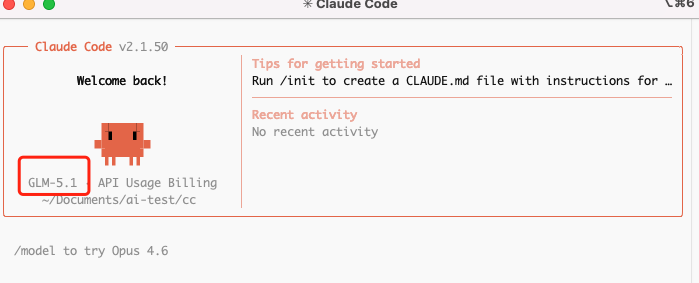

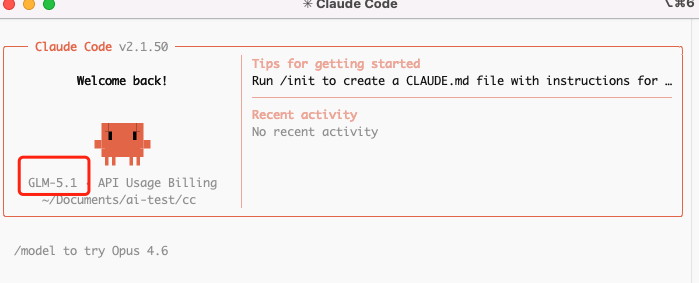

启动一个命令行窗口,运行 claude 启动 Claude Code,可以看到GLM-5.1模型:

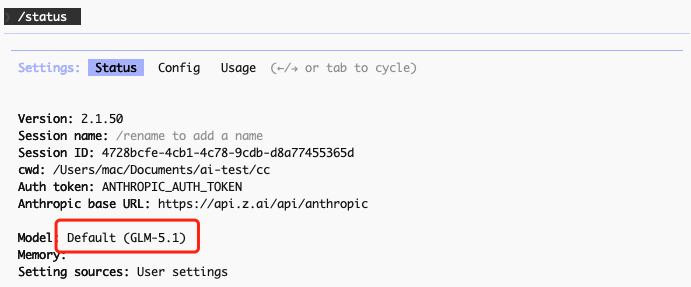

在 Claude Code 中输入 /status 命令,也可以确认模型状态:

2.2 开发一个订单管理系统

任务目标:

- 做一个“专业的订单管理系统(MVP)”,功能包含:用户注册登录、订单创建、订单列表筛选、订单导出 CSV。

- 技术栈约束:后端 Spring Boot 3 + PostgreSQL + Redis;前端 React + Vite + TypeScript。

- 工程约束:Controller 统一返回

ApiResponse<T>;SQL 必须参数化;接口错误码统一;输出可本地运行。

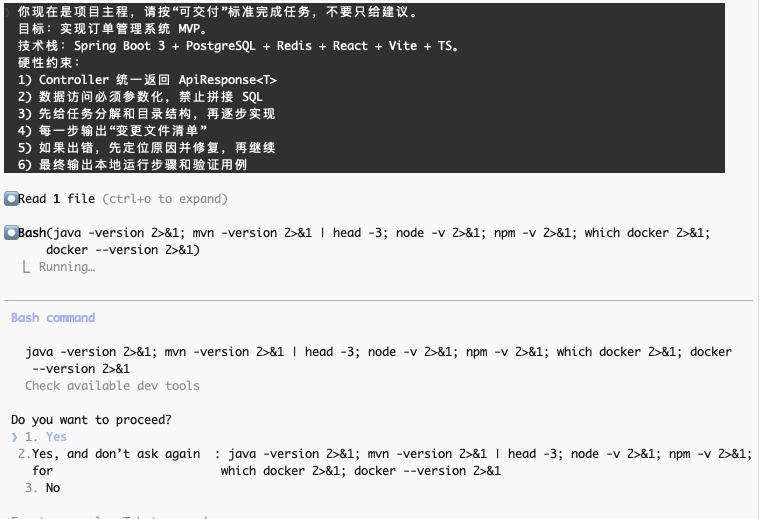

我给模型的原始指令(可直接复用):

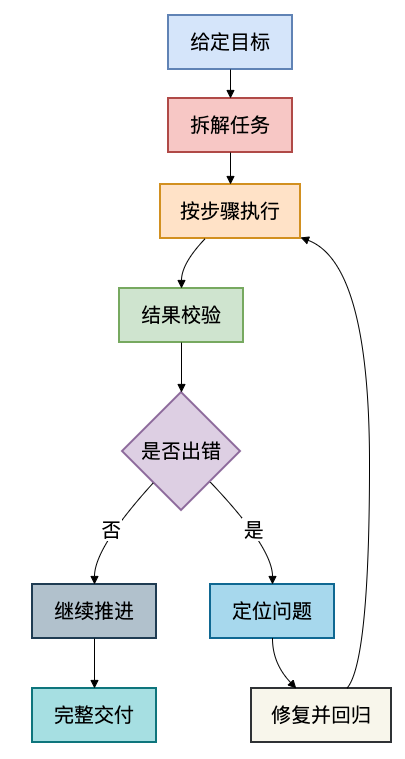

你现在是项目主程,请按“可交付”标准完成任务,不要只给建议。

目标:实现专业的订单管理系统 MVP。

技术栈:Spring Boot 3 + PostgreSQL + Redis + React + Vite + TS。

硬性约束:

1) Controller 统一返回 ApiResponse<T>

2) 数据访问必须参数化,禁止拼接 SQL

3) 先给任务分解和目录结构,再逐步实现

4) 每一步输出“变更文件清单”

5) 如果出错,先定位原因并修复,再继续

6) 最终输出本地运行步骤和验证用例

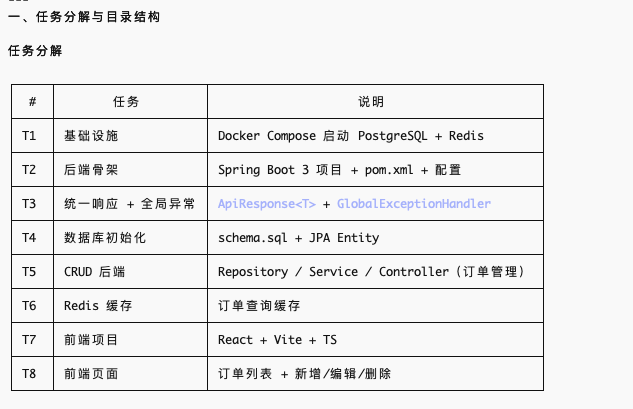

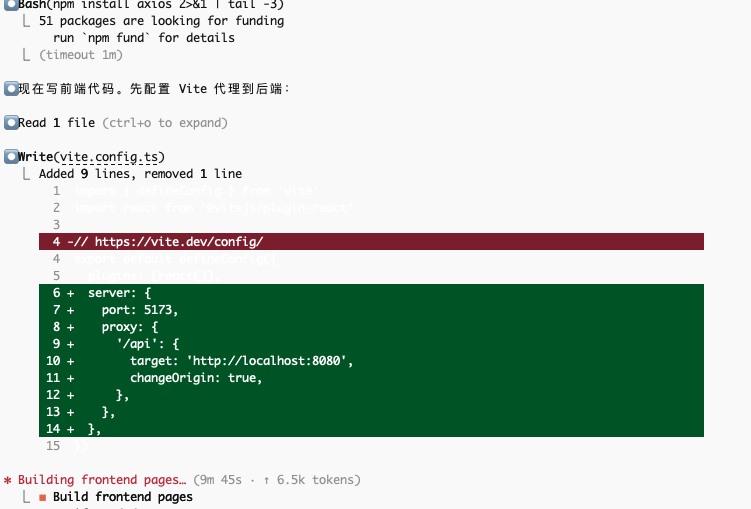

我实际观察到的完整步骤:

- 步骤 1:GLM-5.1会询问我们一些项目用到的技术的版本,我们选择2.yes,and don't ask again,这一项,不然的话,需要多次确认,比较麻烦。

- 步骤 2:给出系统拆分目录结构。

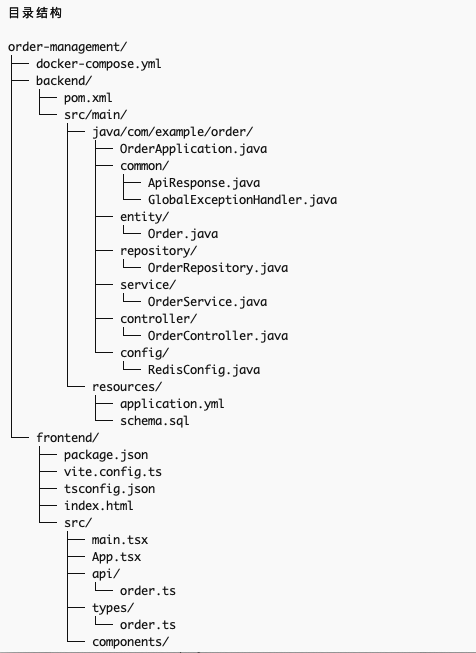

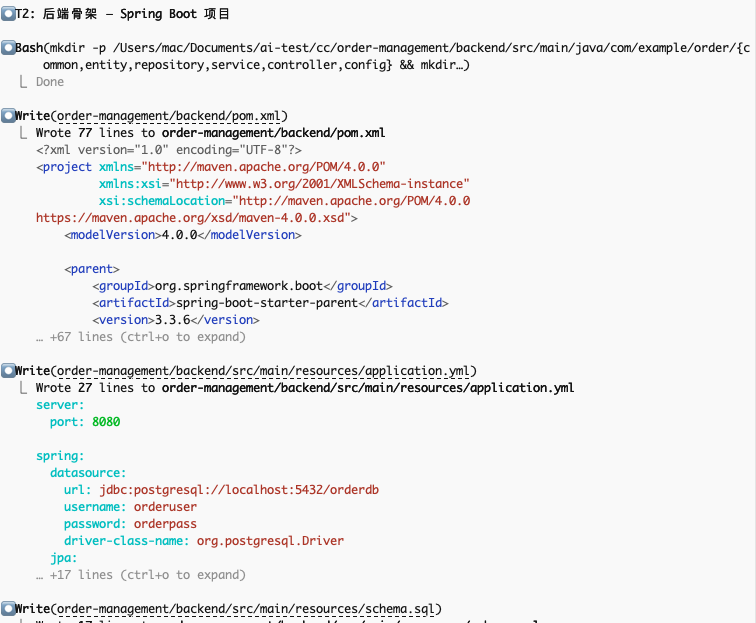

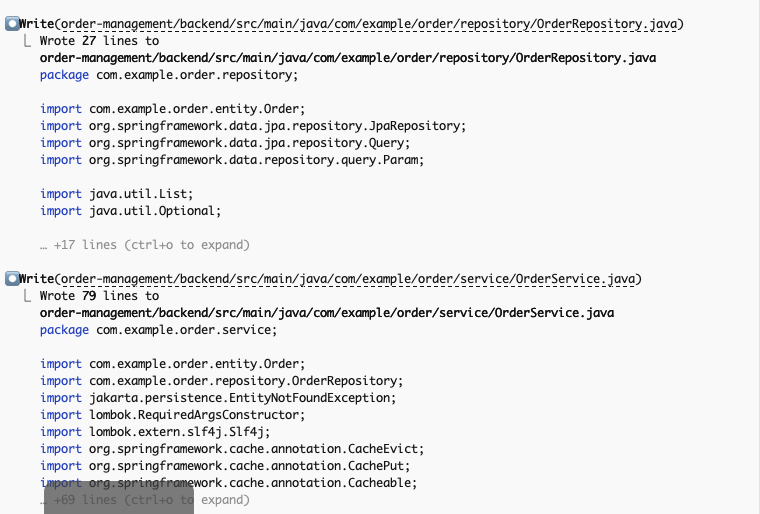

- 步骤 3:生成后端项目骨架和表

后面会有一些确认,选第1项或者第2项就行。

- 步骤 4:生成前端页面

- 步骤 5:启动项目

最后会生成一个项目的完整本地运行部署,我们按照这个部署可以启动项目。

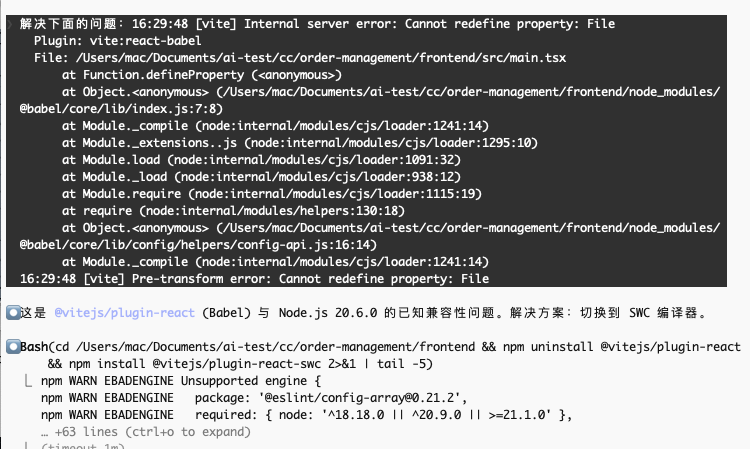

- 步骤 6:解决报错

如果在启动项目时,遇到了一些报错,可以直接让GLM-5.1帮我们解决:

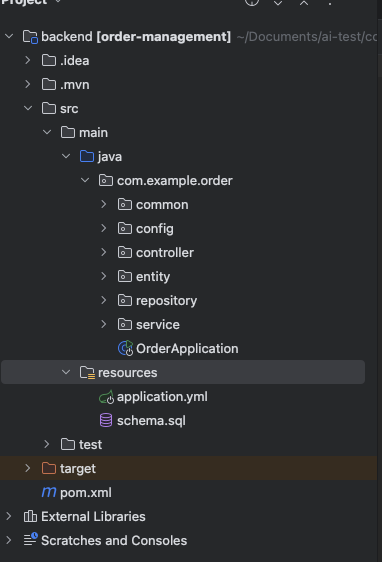

后端项目代码结构:

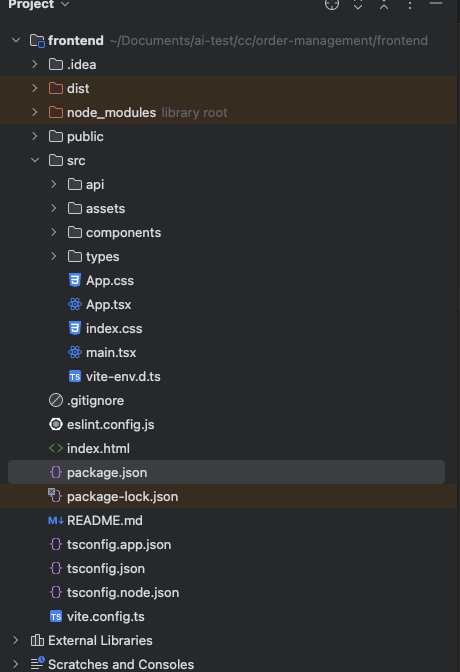

前端项目代码结构:

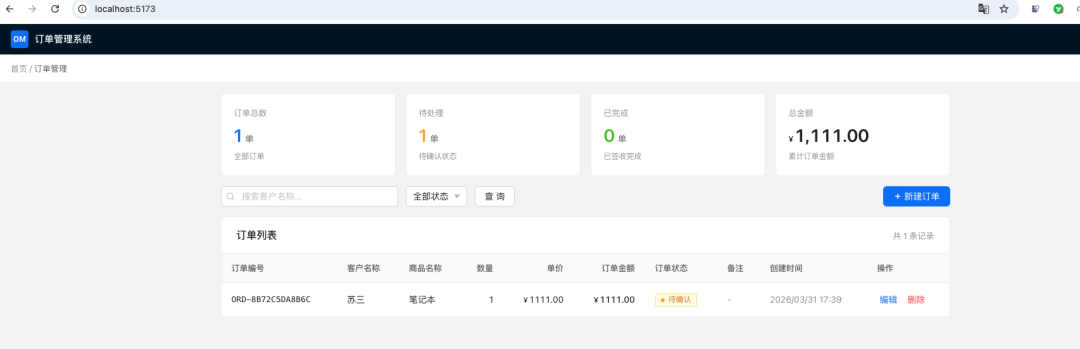

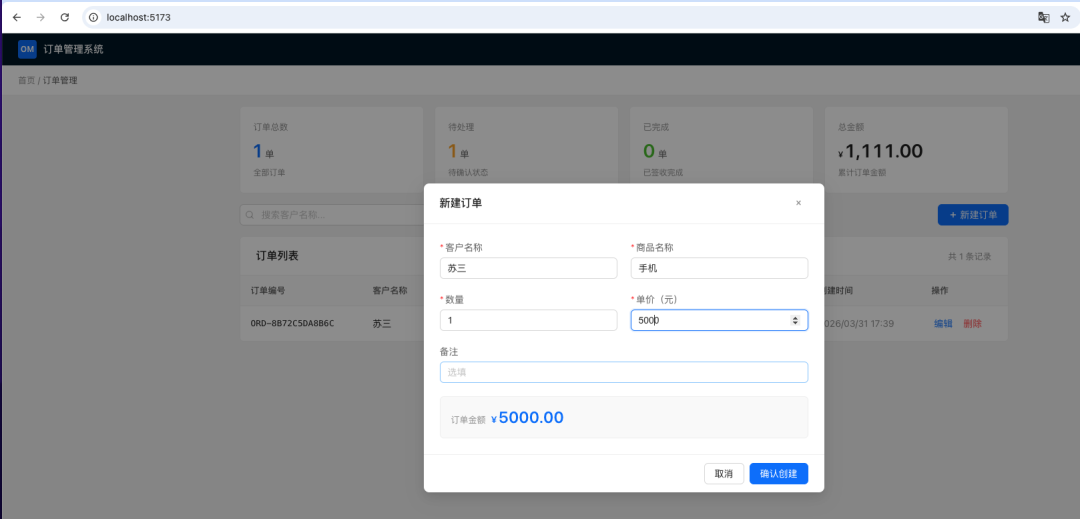

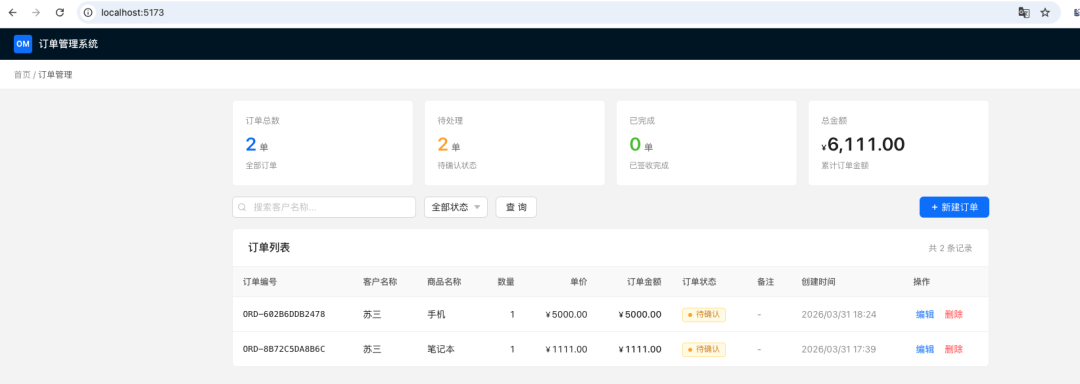

运行效果如下:

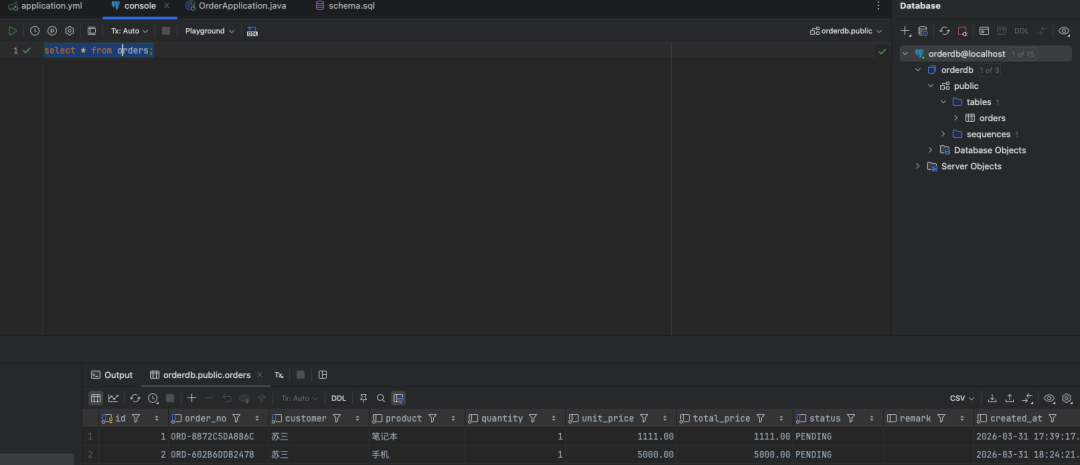

查询数据库,能够查到这两条数据:

视频效果如下:

说明从0~1开始,一个完整的前端和后端的订单功能已经开发好了。

一句话结论:在复杂任务的持续执行和完整交付上,GLM-5.1体感已经和上一代拉开明显差距。

三、为什么会有这种差距?

不是更会“答题”,而是更会“做事”。

真正拉开差距的点,不是“单次回答更漂亮”,而是下面这三项:

- 长程记忆:前面说过的约束不会在后半段突然失忆。

- 过程控制:知道当前进度,能持续推进而不是来回打转。

- 错误闭环:能发现问题、解释原因、给出修复并继续前进。

这三个能力叠在一起,才会出现“断档领先”的体感。

四、和 Opus 4.6 的关系

很多人问:是不是能平替 Opus 4.6?

我的看法很直接:在“长任务持续执行 + 中途自修 + 最终完整交付”这三个核心维度上,GLM-5.1已经出现了明显的同档体验。

当然,不同任务类型会有波动,这很正常。

但如果你看的是“真实工程效率”和“月度成本”,这波升级已经足够值得你马上去试。

五、对普通开发者的影响

如果你是智谱的 Coding Plan 用户,我建议你不要先看别人评价。

直接做这 5 步:

- 第一步:拿你手头一个真实任务,不要用玩具样例。

- 第二步:一次性把关键约束讲清楚(架构、接口规范、数据库规则)。

- 第三步:要求它先给执行计划,再按计划推进。

- 第四步:遇错不接手,先看它是否能自查自修。

- 第五步:用“能不能最终交付”作为唯一标准。

你会很快知道它到底值不值“开源第一”这四个字。

现在最值得警惕的不是“AI会不会替代你”,而是你还在把AI当搜索框在用。

当模型已经能像资深工程师一样做长程任务时,你的核心价值会越来越集中在这些能力上:

- 定义问题

- 设计约束

- 做工程决策

- 保障交付质量

换句话说,未来不是“会不会写代码”的竞争,而是“谁更会用AI完成复杂交付”的竞争。

建议大家可以自己亲自体验一下GLM-5.1,越早加入,越容易拿到这波效率红利。

最后

智谱这次GLM-5.1的更新,最让我有感的一点是:智谱没有用“解释”证明自己,而是用“可用”证明自己。

如果你这周只做一件和 AI 相关的事,我建议就是: 打开 Coding Plan,给 GLM-5.1一个真正的长任务,让它从目标跑到交付。

你会更直观地理解,为什么大家都在说:开源第一模型,真的换人了。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-03-31,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录