124:API网关与流量管理:高可用API设计

124:API网关与流量管理:高可用API设计

安全风信子

发布于 2026-04-15 08:10:12

发布于 2026-04-15 08:10:12

作者: HOS(安全风信子) 日期: 2026-03-26 主要来源平台: GitHub 摘要: 本文深入探讨API网关与流量管理的核心技术,通过详细案例展示如何设计高可用的API系统。我们将分析API网关的架构、流量管理策略、安全防护以及性能优化,为AI工程师提供一套完整的API网关设计指南。

目录- 1. 核心技术价值

- 2. API网关概述

- 2.1 API网关的定义与作用

- 2.2 API网关与传统架构的对比

- 2.3 API网关在Agentic系统中的应用

- 3. API网关架构设计

- 3.1 核心组件

- 3.1.1 路由模块

- 3.1.2 认证模块

- 3.1.3 限流模块

- 3.2 架构模式

- 3.2.1 集中式API网关

- 3.2.2 分布式API网关

- 3.2.3 服务网格

- 4. 流量管理策略

- 4.1 流量控制

- 4.1.1 限流策略

- 4.1.2 熔断策略

- 4.2 负载均衡

- 4.2.1 负载均衡算法

- 4.2.2 健康检查

- 4.3 流量路由

- 4.3.1 基于路径的路由

- 4.3.2 基于Header的路由

- 4.3.3 基于权重的路由

- 5. 安全防护

- 5.1 认证与授权

- 5.1.1 JWT认证

- 5.1.2 OAuth 2.0

- 5.2 攻击防护

- 5.2.1 DDoS防护

- 5.2.2 SQL注入防护

- 5.2.3 XSS防护

- 5.3 数据加密

- 5.3.1 传输加密

- 5.3.2 数据脱敏

- 6. 性能优化

- 6.1 缓存策略

- 6.1.1 响应缓存

- 6.1.2 边缘缓存

- 6.2 连接优化

- 6.2.1 连接池

- 6.2.2 HTTP/2

- 6.3 异步处理

- 6.3.1 异步IO

- 6.3.2 消息队列

- 7. 监控与分析

- 7.1 监控指标

- 7.1.1 系统指标

- 7.1.2 业务指标

- 7.2 监控工具

- 7.2.1 Prometheus + Grafana

- 7.2.2 ELK Stack

- 7.3 告警机制

- 7.3.1 阈值告警

- 7.3.2 趋势告警

- 8. 实战案例

- 8.1 案例一:电商平台API网关

- 8.2 案例二:金融API网关

- 8.3 案例三:AI服务API网关

- 9. 最佳实践

- 9.1 设计最佳实践

- 9.2 部署最佳实践

- 9.3 安全最佳实践

- 10. 未来发展趋势

- 10.1 API网关的演进

- 10.2 流量管理的发展

- 10.3 安全防护的创新

- API网关部署检查清单

- 性能测试指标

- 2.1 API网关的定义与作用

- 2.2 API网关与传统架构的对比

- 2.3 API网关在Agentic系统中的应用

- 3.1 核心组件

- 3.1.1 路由模块

- 3.1.2 认证模块

- 3.1.3 限流模块

- 3.2 架构模式

- 3.2.1 集中式API网关

- 3.2.2 分布式API网关

- 3.2.3 服务网格

- 4.1 流量控制

- 4.1.1 限流策略

- 4.1.2 熔断策略

- 4.2 负载均衡

- 4.2.1 负载均衡算法

- 4.2.2 健康检查

- 4.3 流量路由

- 4.3.1 基于路径的路由

- 4.3.2 基于Header的路由

- 4.3.3 基于权重的路由

- 5.1 认证与授权

- 5.1.1 JWT认证

- 5.1.2 OAuth 2.0

- 5.2 攻击防护

- 5.2.1 DDoS防护

- 5.2.2 SQL注入防护

- 5.2.3 XSS防护

- 5.3 数据加密

- 5.3.1 传输加密

- 5.3.2 数据脱敏

- 6.1 缓存策略

- 6.1.1 响应缓存

- 6.1.2 边缘缓存

- 6.2 连接优化

- 6.2.1 连接池

- 6.2.2 HTTP/2

- 6.3 异步处理

- 6.3.1 异步IO

- 6.3.2 消息队列

- 7.1 监控指标

- 7.1.1 系统指标

- 7.1.2 业务指标

- 7.2 监控工具

- 7.2.1 Prometheus + Grafana

- 7.2.2 ELK Stack

- 7.3 告警机制

- 7.3.1 阈值告警

- 7.3.2 趋势告警

- 8.1 案例一:电商平台API网关

- 8.2 案例二:金融API网关

- 8.3 案例三:AI服务API网关

- 9.1 设计最佳实践

- 9.2 部署最佳实践

- 9.3 安全最佳实践

- 10.1 API网关的演进

- 10.2 流量管理的发展

- 10.3 安全防护的创新

- API网关部署检查清单

- 性能测试指标

1. 核心技术价值

本节为你提供的核心技术价值:掌握API网关与流量管理的设计技巧,实现高可用、高性能、安全的API系统,确保Agentic系统的稳定运行。

2. API网关概述

2.1 API网关的定义与作用

API网关是位于客户端和后端服务之间的中间层,负责请求路由、协议转换、安全认证、流量管理等功能。API网关的主要作用包括:

- 请求路由:根据请求路径将请求转发到相应的后端服务

- 协议转换:在不同协议之间进行转换,如HTTP到gRPC

- 安全认证:处理认证和授权,保护后端服务

- 流量管理:控制流量,防止过载

- 监控与分析:收集请求数据,进行监控和分析

2.2 API网关与传统架构的对比

特性 | API网关架构 | 传统架构 |

|---|---|---|

服务暴露 | 统一入口 | 直接暴露 |

安全管理 | 集中管理 | 分散管理 |

流量控制 | 统一控制 | 分散控制 |

监控分析 | 集中监控 | 分散监控 |

扩展性 | 易于扩展 | 不易扩展 |

维护成本 | 低 | 高 |

2.3 API网关在Agentic系统中的应用

- 统一入口:为Agentic系统提供统一的API入口

- 安全防护:保护Agentic系统免受恶意攻击

- 流量管理:控制请求流量,确保系统稳定

- 监控分析:收集系统运行数据,优化性能

- 协议转换:支持不同协议的客户端接入

3. API网关架构设计

3.1 核心组件

3.1.1 路由模块

路由模块负责根据请求路径将请求转发到相应的后端服务。

class Router:

def __init__(self):

self.routes = {}

def add_route(self, path, handler):

self.routes[path] = handler

def route(self, request):

path = request.path

if path in self.routes:

return self.routes[path](request)

else:

return self.handle_404(request)

def handle_404(self, request):

return {"status": 404, "message": "Not Found"}3.1.2 认证模块

认证模块负责处理请求的认证和授权。

class Authenticator:

def __init__(self):

self.token_store = {}

def generate_token(self, user_id):

token = self._generate_random_token()

self.token_store[token] = user_id

return token

def validate_token(self, token):

return token in self.token_store

def get_user_id(self, token):

return self.token_store.get(token)

def _generate_random_token(self):

import secrets

return secrets.token_hex(32)3.1.3 限流模块

限流模块负责控制请求流量,防止系统过载。

class RateLimiter:

def __init__(self, max_requests, time_window):

self.max_requests = max_requests

self.time_window = time_window # 秒

self.requests = {}

def is_allowed(self, client_id):

import time

current_time = time.time()

if client_id not in self.requests:

self.requests[client_id] = []

# 清理过期的请求记录

self.requests[client_id] = [t for t in self.requests[client_id] if current_time - t < self.time_window]

# 检查是否超过限制

if len(self.requests[client_id]) < self.max_requests:

self.requests[client_id].append(current_time)

return True

else:

return False3.2 架构模式

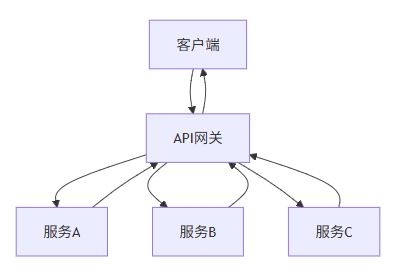

3.2.1 集中式API网关

集中式API网关是最常见的架构模式,所有请求都通过一个中心化的网关进行处理。

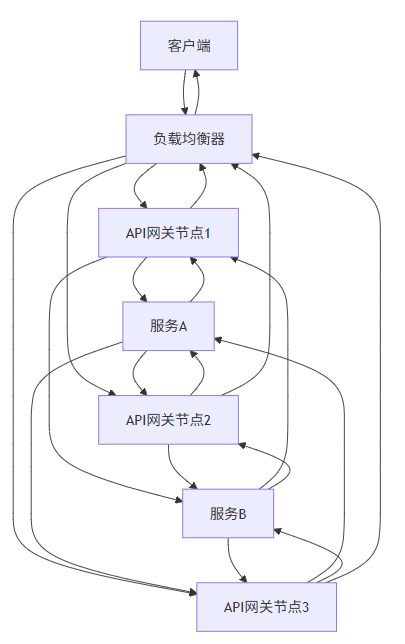

3.2.2 分布式API网关

分布式API网关将网关功能分布到多个节点,提高可用性和扩展性。

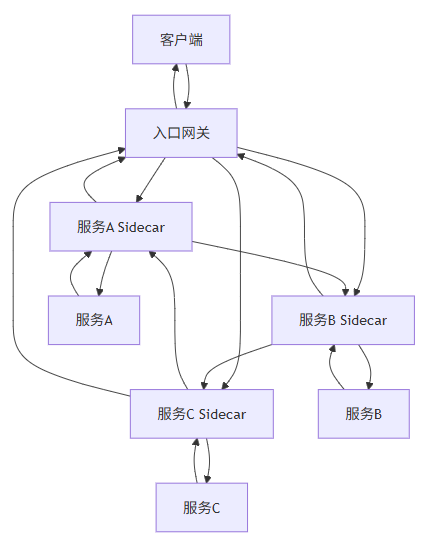

3.2.3 服务网格

服务网格将API网关功能下沉到每个服务实例,实现更细粒度的控制。

4. 流量管理策略

4.1 流量控制

4.1.1 限流策略

- 基于请求速率:限制单位时间内的请求数量

- 基于并发连接:限制同时处理的连接数量

- 基于资源使用:根据系统资源使用情况动态调整限流

4.1.2 熔断策略

当后端服务出现故障时,暂时停止向该服务发送请求,避免级联故障。

class CircuitBreaker:

def __init__(self, failure_threshold, recovery_time):

self.failure_threshold = failure_threshold

self.recovery_time = recovery_time # 秒

self.failures = 0

self.state = "CLOSED"

self.last_failure_time = 0

def allow_request(self):

import time

current_time = time.time()

if self.state == "OPEN":

# 检查是否可以尝试恢复

if current_time - self.last_failure_time > self.recovery_time:

self.state = "HALF_OPEN"

return True

else:

return False

elif self.state == "HALF_OPEN":

# 尝试一个请求

return True

else: # CLOSED

return True

def record_success(self):

if self.state == "HALF_OPEN":

self.state = "CLOSED"

self.failures = 0

def record_failure(self):

import time

self.failures += 1

self.last_failure_time = time.time()

if self.state == "CLOSED" and self.failures >= self.failure_threshold:

self.state = "OPEN"

elif self.state == "HALF_OPEN":

self.state = "OPEN"

self.failures = 04.2 负载均衡

4.2.1 负载均衡算法

- 轮询:按顺序将请求分配给后端服务

- 加权轮询:根据服务权重分配请求

- 最少连接:将请求分配给当前连接数最少的服务

- IP哈希:根据客户端IP哈希值分配请求,确保会话一致性

4.2.2 健康检查

定期检查后端服务的健康状态,避免将请求发送到故障服务。

class HealthChecker:

def __init__(self, services, check_interval):

self.services = services

self.check_interval = check_interval # 秒

self.healthy_services = set(services)

self.last_check_time = 0

def check_health(self):

import time

current_time = time.time()

if current_time - self.last_check_time > self.check_interval:

self.last_check_time = current_time

for service in self.services:

if self._is_service_healthy(service):

self.healthy_services.add(service)

else:

self.healthy_services.remove(service)

def get_healthy_services(self):

self.check_health()

return list(self.healthy_services)

def _is_service_healthy(self, service):

# 实现健康检查逻辑

import requests

try:

response = requests.get(f"http://{service}/health", timeout=2)

return response.status_code == 200

except:

return False4.3 流量路由

4.3.1 基于路径的路由

根据请求路径将请求转发到相应的后端服务。

4.3.2 基于Header的路由

根据请求Header将请求转发到相应的后端服务。

4.3.3 基于权重的路由

根据权重将请求分配到不同版本的服务,实现灰度发布。

class WeightedRouter:

def __init__(self):

self.routes = {}

def add_route(self, path, services):

"""

services: [(service_url, weight), ...]

"""

self.routes[path] = services

def route(self, request):

path = request.path

if path in self.routes:

services = self.routes[path]

return self._select_service(services)

else:

return None

def _select_service(self, services):

import random

total_weight = sum(weight for _, weight in services)

rand = random.uniform(0, total_weight)

current_weight = 0

for service, weight in services:

current_weight += weight

if rand <= current_weight:

return service

return services[0][0]5. 安全防护

5.1 认证与授权

5.1.1 JWT认证

使用JSON Web Token进行无状态认证。

import jwt

import datetime

def generate_jwt(user_id, secret_key):

payload = {

"user_id": user_id,

"exp": datetime.datetime.utcnow() + datetime.timedelta(hours=24)

}

return jwt.encode(payload, secret_key, algorithm="HS256")

def validate_jwt(token, secret_key):

try:

payload = jwt.decode(token, secret_key, algorithms=["HS256"])

return payload

except:

return None5.1.2 OAuth 2.0

使用OAuth 2.0进行第三方认证。

5.2 攻击防护

5.2.1 DDoS防护

- 速率限制:限制单个IP的请求速率

- 流量分析:分析流量模式,识别异常流量

- CDN集成:使用CDN分散流量

5.2.2 SQL注入防护

- 参数化查询:使用参数化查询避免SQL注入

- 输入验证:验证输入数据的格式和长度

- WAF:使用Web应用防火墙

5.2.3 XSS防护

- 输出编码:对输出数据进行编码

- CSP:使用内容安全策略

- 输入验证:验证输入数据的格式

5.3 数据加密

5.3.1 传输加密

使用HTTPS加密传输数据。

5.3.2 数据脱敏

对敏感数据进行脱敏处理。

def mask_sensitive_data(data, sensitive_fields):

for field in sensitive_fields:

if field in data:

data[field] = "***"

return data6. 性能优化

6.1 缓存策略

6.1.1 响应缓存

缓存API响应,减少后端服务的负载。

class ResponseCache:

def __init__(self, max_size, ttl):

self.cache = {}

self.max_size = max_size

self.ttl = ttl # 秒

def get(self, key):

import time

current_time = time.time()

if key in self.cache:

value, timestamp = self.cache[key]

if current_time - timestamp < self.ttl:

return value

else:

del self.cache[key]

return None

def set(self, key, value):

import time

current_time = time.time()

if len(self.cache) >= self.max_size:

# 移除最旧的缓存

oldest_key = min(self.cache, key=lambda k: self.cache[k][1])

del self.cache[oldest_key]

self.cache[key] = (value, current_time)6.1.2 边缘缓存

使用CDN在边缘节点缓存静态内容。

6.2 连接优化

6.2.1 连接池

使用连接池减少连接建立的开销。

import requests

from urllib3.util.retry import Retry

from requests.adapters import HTTPAdapter

session = requests.Session()

retries = Retry(total=3, backoff_factor=1)

session.mount('http://', HTTPAdapter(max_retries=retries, pool_connections=100, pool_maxsize=100))

session.mount('https://', HTTPAdapter(max_retries=retries, pool_connections=100, pool_maxsize=100))6.2.2 HTTP/2

使用HTTP/2减少连接开销和 latency。

6.3 异步处理

6.3.1 异步IO

使用异步IO处理并发请求。

import asyncio

import aiohttp

async def fetch(session, url):

async with session.get(url) as response:

return await response.text()

async def main():

async with aiohttp.ClientSession() as session:

tasks = [fetch(session, f"http://example.com/{i}") for i in range(100)]

results = await asyncio.gather(*tasks)

return results

asyncio.run(main())6.3.2 消息队列

使用消息队列处理异步任务。

7. 监控与分析

7.1 监控指标

7.1.1 系统指标

- QPS:每秒请求数

- 响应时间:请求响应时间

- 错误率:错误请求比例

- 吞吐量:数据传输量

- 资源使用率:CPU、内存、网络等资源使用情况

7.1.2 业务指标

- API调用次数:各API的调用次数

- 用户活跃度:用户使用情况

- 业务转化率:业务目标达成率

7.2 监控工具

7.2.1 Prometheus + Grafana

# prometheus.yml

scrape_configs:

- job_name: 'api_gateway'

static_configs:

- targets: ['localhost:8000']

metrics_path: '/metrics'

scrape_interval: 15s7.2.2 ELK Stack

使用ELK Stack(Elasticsearch, Logstash, Kibana)进行日志分析。

7.3 告警机制

7.3.1 阈值告警

当指标超过阈值时触发告警。

7.3.2 趋势告警

当指标趋势异常时触发告警。

8. 实战案例

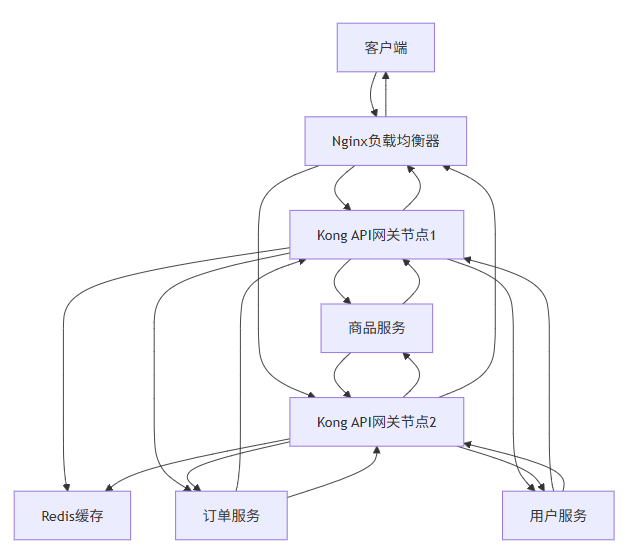

8.1 案例一:电商平台API网关

背景: 某电商平台需要构建高可用的API网关,处理大量并发请求。

部署方案:

- 使用Kong作为API网关

- 使用Nginx作为负载均衡器

- 使用Redis作为缓存

- 使用Prometheus + Grafana进行监控

架构图:

效果:

- 可用性:99.99%

- 响应时间:平均响应时间小于100ms

- 吞吐量:支持每秒10000+请求

- 扩展性:轻松应对流量峰值

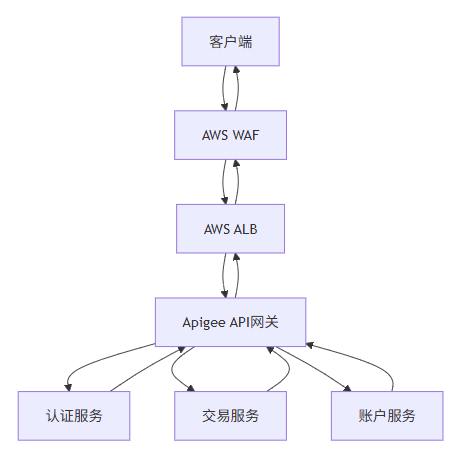

8.2 案例二:金融API网关

背景: 某银行需要构建安全、可靠的API网关,处理金融交易请求。

部署方案:

- 使用Apigee作为API网关

- 使用AWS ALB作为负载均衡器

- 使用AWS WAF进行安全防护

- 使用CloudWatch进行监控

架构图:

效果:

- 安全性:符合金融行业安全标准

- 可用性:99.99%

- 性能:处理复杂交易的响应时间小于500ms

- 合规性:满足PCI DSS等合规要求

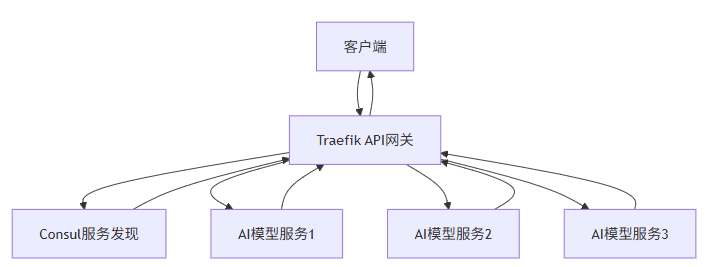

8.3 案例三:AI服务API网关

背景: 某AI公司需要构建API网关,处理AI模型推理请求。

部署方案:

- 使用Traefik作为API网关

- 使用Consul作为服务发现

- 使用Prometheus + Grafana进行监控

- 使用Jaeger进行分布式追踪

架构图:

效果:

- 弹性:自动扩缩容,应对流量波动

- 性能:支持批量推理,提高吞吐量

- 监控:实时监控模型性能和资源使用

- 可观测性:分布式追踪,快速定位问题

9. 最佳实践

9.1 设计最佳实践

- API设计规范:遵循RESTful API设计规范

- 版本管理:实现API版本控制

- 错误处理:统一错误处理机制

- 文档生成:自动生成API文档

9.2 部署最佳实践

- 高可用部署:多节点部署,避免单点故障

- 自动扩缩容:根据流量自动调整资源

- CI/CD:实现自动化部署和测试

- 蓝绿部署:零 downtime 部署

9.3 安全最佳实践

- 最小权限:遵循最小权限原则

- 密钥管理:使用密钥管理服务

- 定期审计:定期进行安全审计

- 漏洞扫描:定期进行漏洞扫描

10. 未来发展趋势

10.1 API网关的演进

- 智能化:使用AI进行流量预测和优化

- 服务网格集成:与服务网格深度集成

- 边缘计算:将API网关功能扩展到边缘设备

10.2 流量管理的发展

- 智能路由:基于AI的智能路由决策

- 自适应限流:根据系统状态自动调整限流策略

- 预测性扩容:基于流量预测自动扩容

10.3 安全防护的创新

- AI驱动的安全防护:使用AI检测和防御攻击

- 零信任架构:实现零信任安全模型

- 量子安全:应对量子计算的安全挑战

参考链接:

- 主要来源:Kong Documentation - Kong API网关文档

- 辅助:Traefik Documentation - Traefik API网关文档

- 辅助:Apigee Documentation - Apigee API网关文档

附录(Appendix):

API网关部署检查清单

- 选择合适的API网关产品

- 设计高可用架构

- 配置安全防护措施

- 实现流量管理策略

- 设置监控和告警

- 测试性能和扩展性

- 制定灾备方案

- 实现自动化部署

性能测试指标

指标 | 目标值 | 测量方法 |

|---|---|---|

QPS | > 10000 | 压力测试 |

99%响应时间 | < 100ms | 性能测试 |

错误率 | < 0.1% | 稳定性测试 |

可用性 | > 99.99% | 长期运行测试 |

关键词: API网关, 流量管理, 高可用, 安全防护, 性能优化, 监控分析, 负载均衡

在这里插入图片描述

在这里插入图片描述

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2026-04-14,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录