刚水完 OpenClaw,又爆了个 Harness

见字如面,我是一臻

图片

90后新手奶爸,探索Doris x AI

点击关注 👇 免费获取数智AI知识库

“🐦了个把月,今天来简单聊聊近期关于AI这块的一些感悟,再浅谈一下 OpenClaw 和 Harness。

Harness 怎么突然爆了

说实话,不知道大家是否同感:AI近两年迭代是真喵快,已经不再是AI一年,人间十年了,是AI一天,人间十年啊。

从去年 DeepSeek 爆火掀起的国内AI浪潮,再到各个AI基模厂商频出版本、冲榜单、刷xxx牛皮...Agent工程日渐强大,各大C高呼:AGI来了!

期间 Agent、MCP、Skills、Vibe Coding、OpenClaw、CLI、Hermes...Harness 热点层出不穷,感觉一天没关注、自己out了。

但技术热点的迭代更新,无论是换汤还是换药,总归是一次进步。

一臻觉着不用被营销过度输入,凡事自有其时,不必急于强求,也勿放任松散,带些许钝感力,理性地面对即可。

顺着这个思路,Harness(马具) 恰恰给了我们一种相对理性平和的抓手。

一开始看到这个名词,还以为又是一个让人刷到眼花的热点。

仔细一琢磨,好像并不全是:Harness 的出现,是为了把AI大模型的能力和系统的稳定性真正焊在一起的工程性方法论。

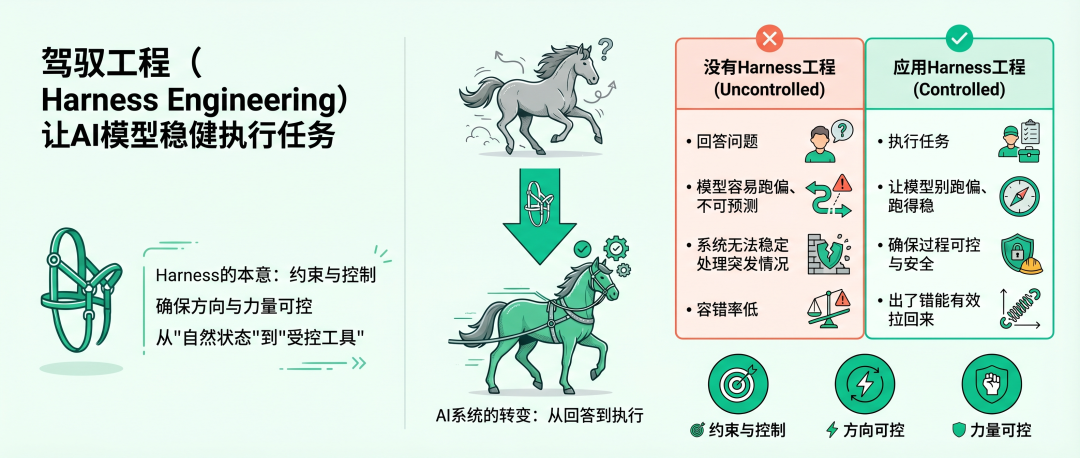

“Harness工程 即 驾驭工程:

例如在开发酒店智能体的时候,大家常常“很聪明”地在 Prompt 里这样写: “你是一个酒店专家,收到用户 query 后,先从 query 中提取出入住城市、入住时间、离店时间、人数等必备信息”

运行起来确实让人眼前一亮——大模型真听话,按部就班地把参数提取得干干净净。

你 double check 后调用酒店供应商 MCP,把搜索结果返回给用户,静静等待用户补充或调整信息。整个流程走得顺滑,跟一台精密的自动售货机没啥差别。

可问题很快就冒出来了:

1. 这真的是智能体吗?

智能体的核心定义是:在与环境交互的过程中,根据环境的反馈不断提炼经验,提升自身能力,真正适应环境。

工具调用只是交互手段,但我们刚才设计的流程几乎是静态的——参数提取、调用 MCP、返回结果,一条直线走到底。

经验从哪儿提取?

又怎么让 Agent 更深入地融入环境(环境 = 具体业务场景 + 当前用户)?

2. LLM 到底知不知道酒店搜索的真实流程?

于是换了又一种写法,把 meta prompt 直接丢给它:

“你是一个酒店专家,拥有丰富的酒店搜索和推荐经验。先根据你的判断写一份全面又简洁的 SOP 文档,然后严格按照这个 SOP 帮助用户解决问题。同时,根据用户每次反馈不断优化 SOP 文档,把 SOP 的更新写入文档本身,把用户型经验值写入 soul.md。下次同一用户进来时,先读取他的 soul.md,再读取 SOP 文档继续解决问题。”

这就完全不一样了。

这次不再是机械地告诉 LLM 一套固定流程,而是压榨它的能力和灵活性,给了它自我进化的入口和时机。

接下来,就要结合 LLM + 工程手段去管理这些文件:防止撑爆上下文窗口,人工复核 SOP 文档并补充具体业务细节,在合适的位置(比如标题块或标签)里提供 LLM 完成流程所需的工具路径、API、脚本位置,同时给出基础命令权限和手册,明确什么时候走 RAG、什么时候 Web Search,还结合 Sandbox 做执行环境隔离等等。

这就是一个最简单的 Skills 工程,如果还有其他的 Skill 文档,那我可以在 SOP 文档的头部写一个 yaml 块交代 name 与 desc,在 Agent 意图识别时读取进行选择,实现渐进式读取选择性引入,就可以使 Agent Clone 出多个分身来。

“以上的设计思路就是

Harness 工程,它包括了运行环境、约束规则与反馈闭环,真正的在原则范围内让 Agent 自主、可靠的完成任务的同时进行自进化。

正如下图所示,Harness 工程本身并不规定马该怎么跑,不要求马先迈左脚还 是右脚,而是为它装上马具,让它更可控的朝着你想去的方向奔跑,并且给它最大的自主化程度。

此外,OpenAI 在 2 月发布的《Harness engineering: leveraging Codex in an agent-first world》里,用真实项目数据说话:一个三人小队从空仓库起步,五个月零人工手写代码,靠 Codex 代理生成了 100 万行生产级代码、1500 个合并 PR。

平均每个工程师每天 3.5 个 PR,团队扩到七人后吞吐量反而更高,因为他们提前设计了环境、意图设定和反馈回路,代理自己就能跑完整流程,还内置垃圾回收机制扫描漂移并自动建议修复。

人只负责定大方向,不再天天敲键盘或周末清理那些看着对但实际跑不通的输出。

Anthropic 3 月底的《Harness design for long-running application development》则把长时任务的痛点拆得更清楚。

他们设计了 Planner、Generator、Evaluator 三角色分工:

Planner 先进行规划代理把大任务拆成可执行小块,Generator 负责增量执行,Evaluator 单独负责检查结果、迭代纠偏,还强制上下文重置,避免累积误差导致上下文焦虑。

4 月 8 日他们上线 Claude Managed Agents 公测,直接基于 Harness 做成托管服务,带沙箱执行、长会话持久化、多 Agent 协调、凭证管理和错误自动恢复。

开发者只管定义任务和工具,每会话小时加 0.08 刀,模型升级时 Harness 还能平滑切换,不用从头再来。

客观来看,这些实践都在指向同一个核心:模型再聪明,如果没有系统性的知识管理、流程约束和实时反馈,就很容易在真实业务里演示时惊艳、上线就卡壳。

so,Harness 突然爆火,还是有点东西的。

but,这跟 OpenClaw 有何关联?

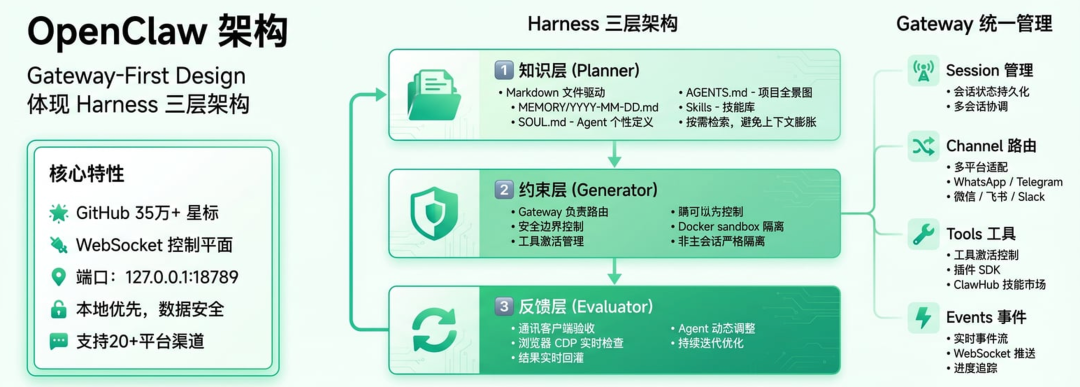

OpenClaw 体现的 Harness 三层架构

虽然 Harness 听着很有料,但 OpenClaw 把这些思路变成了本地就能摸到的完整工具(Hermes 如是)。

OpenClaw的 GitHub 在 4 月 11 日刚推 v2026.4.11,星标已经超过 35 万,核心是 Gateway-First 设计 -> WebSocket 控制平面(xxx:18789)统一管理 Session、Channel、Tools 和 Events:

知识层(Planner) 完全靠 Markdown 文件驱动——MEMORY 目录下每天一个 append-only 的 YYYY-MM-DD.md,只在需要时通过 memory tools 按需检索,避免上下文膨胀;SOUL.md 定义 Agent 个性,AGENTS.md 画出项目全景图,以及各种Skills。

约束层(Generator) 由 Gateway 负责路由、安全边界和工具激活,非主会话直接扔进 Docker sandbox 隔离。

反馈层(Evaluator) 通过通讯客户端、浏览器 CDP 实现真实验收,结果实时回灌给 Agent 调整下一步。

这种本地优先的架构设计,其实特别接地气,举个栗子:

一个内容营销创业公司,周一早上产品经理小李打开 OpenClaw,对 Agent 说了一句“按品牌调性做下周抖音文案,参考 MEMORY 里上月数据”。

相关 Harness 自动注入品牌指南和历史 engagement 数据:Planner 先负责研究和任务拆解,Generator 负责生成文案内容,Evaluator 根据真实互动指标打分迭代。

以前团队每周都要花半天手动校对文案,现在 Agent 第一次输出的内容就基本在线。

基于 Harness 的 OpenClaw ,把社区力量也发挥到极致,ClawHub 里几千个 Skills 可以自由组合,插件 SDK 带安装门控,开发者自定义能力几乎零门槛。

相比 Claude Managed Agents 的云托管,OpenClaw 零额外计费、数据全在本地、支持 20 多个平台渠道(Telegram、微信、飞书、WhatsApp 随便聊),会话剪枝策略可配,/compact 命令手动总结上下文,Presence 模拟人类打字让交互更自然。

最新版本还加强了队列验证和内存 wiki 检查,安全上非主会话 Docker allowlist/denylist 严格控制主机访问。

but,它仍面临着很多隐患和挑战,如数据安全、环境安全、能力边界模糊、 成本控制难度大等问题,这些隐患不仅限制了其大规模商业化落地,也对企业级 应用的稳定性与合规性提出了更高要求。

即便如此,它的价值也不可忽视。

时至近日,OpenAI 的 Codex Harness、Anthropic 的 Managed Agents、OpenClaw 和 Hermes 的出现,一起把 Agent 推向成熟。

它们共同说明:模型会换代,但工程边界不会消失,Harness 就是那个能随模型平移、保持可靠的核心。

结语

在 AI 一年 ≈ 人间十年的快节奏里,Harness 给了我们一个稳定的锚点,可谓是逐步在让 Agent 真正走进日常工作,而不是停留在演示阶段。

无论你是开发者、产品经理还是业务负责人,都值得去研究研究这个工程方法论,把 Agent 从偶尔惊艳的玩具,变成每天都能信赖的生产力伙伴。

技术总在变,但真正能带来改变的,是那些把聪明落到实处的系统性思考。

保持钝感力,理性平和,我们才能走得更远、更从容。

你觉着呢?

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-04-13,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录