技术实战:基于CLI与AgentSkill 构建工业级AI影视解说自动化链路

原创技术实战:基于CLI与AgentSkill 构建工业级AI影视解说自动化链路

原创用户12385129

发布于 2026-04-15 17:08:42

发布于 2026-04-15 17:08:42

一、 AI影视解说新范式:从工具堆砌到自动化 Pipeline 演进

进入 2026 年,短视频生产已从单纯的“工具使用”进入到“工程化自动生产”阶段。传统的 GUI(图形界面)工具虽然易上手,但在面对大规模账号矩阵运营、高频内容产出时,存在着工序割裂、无法脚本化、难以与大模型 Agent 集成等天然短板。

本文将分享一套基于 narrator-ai-cli 与 Skill 架构的自动化方案。该方案旨在通过一行命令或一段自然语言指令,打通从视频理解、文案生成到配音剪辑的完整闭环,实现影视解说场景的工业化落地。

二、 架构深度解析:Local-first(本地优先)模式下的视频处理策略

在视频处理领域,数据隐私与传输带宽一直是核心瓶颈。本方案采用了“本地优先”的混合架构,将计算压力与带宽压力进行分层处理:

- 本地执行层(Heavy Tasks): 利用本地算力通过 FFmpeg 及其工具链完成视频寻址、字幕 OCR/ASR 提取、关键帧抽取、音视频合成及渲染。确保 GB 级的原始视频素材无需上传至云端,保障数据隐私并节省数 GB 的带宽成本。

- 云端赋能层(Intelligence Tasks): 仅将轻量级的中间载荷(如字幕文本、关键帧图像序列、剪辑指令 JSON)发送至 API 接口,利用云端大模型完成风格学习、文案撰写及 TTS(语音合成)。

这种架构使整个生产链路对网络环境的依赖降低了 90% 以上,极大地提升了自动化任务的稳定性。

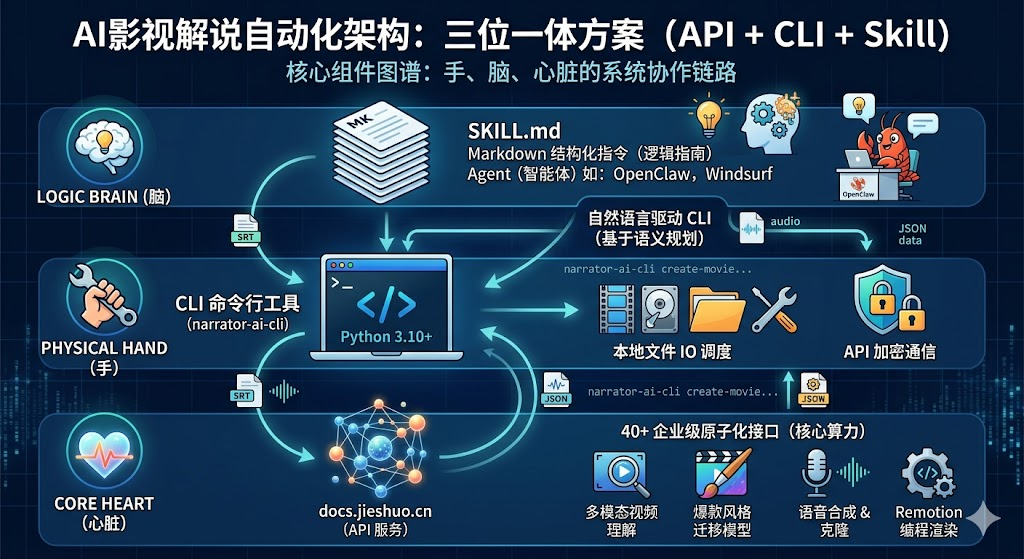

三、 核心组件图谱:API、CLI 与 Agent Skill 的三位一体方案

该自动化套件由三个核心组件构成,分别对应不同的工程需求:

- Open API: 提供 40+ 原子化接口,涵盖多模态理解、爆款风格迁移、Remotion 渲染等核心能力。

- narrator-ai-cli: 基于 Python 开发的命令行入口,封装了本地文件 IO 逻辑与 API 通信协议,是开发者编写自动化脚本(Bash/Python)的核心。

- narrator-ai-cli-skill: 采用结构化 Markdown 编写的智能体技能定义文件。它作为“逻辑指南”,允许具备命令行执行权限的 Agent(如 OpenClaw、Cursor、Windsurf 等)通过自然语言直接驱动底层 CLI。

四、 环境快速初始化:Python 依赖与 CLI 工具链的部署实战

- 系统要求

- Runtime: Python 3.10+ & Git

- OS: Windows 10/11 或 macOS 11+

- Dependencies: FFmpeg (CLI 已内置调用逻辑)

- 安装流程(针对国内开发环境优化)

在终端执行以下命令,利用 GitHub 加速镜像确保依赖项顺利下载:

# 执行自动化安装脚本

python -c "import urllib.request; exec(urllib.request.urlopen('https://raw.githubusercontent.com/jieshuo-ai/narrator-ai-cli/main/install.py').read())"# 或采用手动源码安装

git clone https://ghfast.top/https://github.com/jieshuo-ai/narrator-ai-cli.git

cd narrator-ai-cli

pip install -e .- 鉴权配置

通过 API Key 实现接口调用鉴权。支持子AppKey 体系,允许主账号对不同业务线分配独立配额,实现成本的精细化度量。

narrator-ai-cli config set app_key YOUR_APP_KEY五、 任务执行实战:命令行驱动(CLI)与智能体(Agent)自动化流

- CLI 模式:脚本化批量处理

针对 MCN 机构或批量内容生产场景,可通过命令行参数精确控制生成逻辑:

narrator-ai-cli commentary create-movie \

--movie-file ~/Videos/source_video.mp4 \

--platform "抖音" \

--dubbing male \

--bgm "FastBeat" \

--task-count 1 \

--output ./output/关键技术逻辑: CLI 会自动执行本地预处理,将提取的 SRT 与 Images 载荷提交给云端。系统在任务启动前会返回 total_consume_points(预估消耗点数),确保自动化脚本在超预算时能及时中断。

- Skill 模式:LLM Orchestration(大模型编排)

通过向 Agent 注入 SKILL.md,开发者可以使用自然语言驱动复杂的工程任务:

"使用‘悬疑氛围’模板处理

~/Videos/input.mp4,生成 3 稿不同风格的解说,完成后在本地合成 4K 视频。"

六、 核心技术拆解:爆款风格迁移模型与精准 TTS 停顿控制

- 风格学习(Two-step Process)

方案并未采用通用的 Prompt 工程,而是引入了风格学习模型:

- Step 1: 提交参考视频的字幕文本,生成

learning_model_id。系统通过 RAG 结合微调模型,提取参考素材的叙事节奏与“情绪钩子”。 - Step 2: 将该 ID 应用于新素材。这种方式保证了输出文案在句式分布和情绪起伏上与爆款视频高度对齐。

- 语音合成的精确停顿控制

为了解决 AI 配音常见的“机器味”,方案支持在文本中插入 SSML 类似的停顿语法:

“接下来我们要讲的<#1.2#>是一个你从未听过的故事。”

其中 <#1.2#> 指令将强制后端 TTS 引擎在合成时插入 1.2 秒的物理停顿,极大增强了影视解说的悬念感。

- SSE(Server-Sent Events)异步推送

接口层支持 Accept: text/event-stream。开发者无需频繁轮询 API 状态,后端会实时推送 task_process 与 task_completed 事件,这对于构建高响应的自动化监控台至关重要。

七、 场景选型指南:按需匹配 API、CLI 或 Skill 技术路径

虽然底层能力共享,但根据不同的工程背景与业务规模,你可以从以下三个维度进行选型:

1. API 模式:适用于原生产品集成

- 适用人群: SaaS 平台开发者、APP 研发团队。

- 集成深度: 极高。支持将 AI 影视解说能力直接嵌入到自有产品的业务流中。

- 技术优势: 极致的灵活性,支持大规模并发请求,完全自主控制文件存储(OSS/S3)与任务调度。

- 选型代价: 开发门槛较高,需自行处理网络重试、异步状态回调及文件分片上传。

2. CLI 模式:适用于极客创作者与 MCN 机构

- 适用人群: 熟悉 Python 的个人博主、技术型运营、MCN 运维团队。

- 集成深度: 高。通过 Bash 或 Python 脚本即可快速实现“一键自动化”或“定时任务”。

- 技术优势: Local-first(本地优先) 架构的集大成者。无需学习复杂的 API 鉴权细节,素材驻留本地,隐私性与稳定性达到工业级平衡。

- 选型代价: 需要具备基础的终端操作能力(Terminal/PowerShell)。

3. Skill 模式:适用于内容策划与 Agent 开发

- 适用人群: 影视博主、不具备代码能力的决策者、AI Agent 开发者。

- 集成深度: 灵活。直接注入到 OpenClaw、Cursor 或 Windsurf 等智能体中,让 Agent 成为你的“数字导演”。

- 技术优势: 零学习门槛。无需记忆参数,只需通过自然语言下达指令,Agent 自动完成逻辑编排与任务纠错。

- 选型代价: 依赖大模型的语义理解能力,对于极度复杂的长逻辑指令,偶发性存在理解偏差。

八、 总结与展望:构建工业级 AI 视频内容生产护城河

AI 内容生产正从“提示词工程”转向“工程化 Agent”阶段。本套方案通过将复杂的视频处理逻辑封装为可调用的原子化命令,降低了开发者构建垂直领域 AI 应用的门槛。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录