第03期·AI幻觉与可信度

DAILY AI KNOWLEDGE

🌀 AI 幻觉与可信度

每天搞懂一个 AI 知识点 · 第 03 期

2026.3.30

什么是 AI 幻觉?

你有没有遇到过这种情况:问 AI 一个问题,它给了一个听起来非常自信、非常专业的答案,但仔细一查,完全是胡说?

这就是 AI 幻觉(Hallucination)。

🚨 真实案例

有律师让 ChatGPT 帮忙找案例引用,AI 生成了几十条"判例",引用格式规范、案号完整、描述详尽——结果全是编造的,这位律师差点因此被吊销执照。

🧠 为什么 AI 会"幻觉"?

LLM 本质是"概率预测机器",它的目标是生成听起来合理的文字,而不是保证正确。当它不知道答案时,它不会说"我不知道",而是生成一个"听起来像正确答案"的内容。

🔬 幻觉的几种类型

类型 | 说明 | 例子 |

|---|---|---|

事实捏造 | 编造不存在的事实 | 虚构论文、不存在的人物 |

细节错误 | 大方向对,细节出错 | 时间、数字张冠李戴 |

过度自信 | 不确定也说得很肯定 | "这个函数一定是…" |

知识截止 | 训练后的事不知道 | 问最新的 API 版本 |

逻辑矛盾 | 前后表述不一致 | 同一段话前后矛盾 |

🛡️ 如何判断 AI 的回答可不可信?

✅ 高可信度

• 代码生成(可运行验证) • 格式转换 • 通用知识解释 • 给定信息后的逻辑分析

⚠️ 低可信度

• 具体数字/统计 • 论文/链接引用 • 最新事件信息 • 小众专业细节

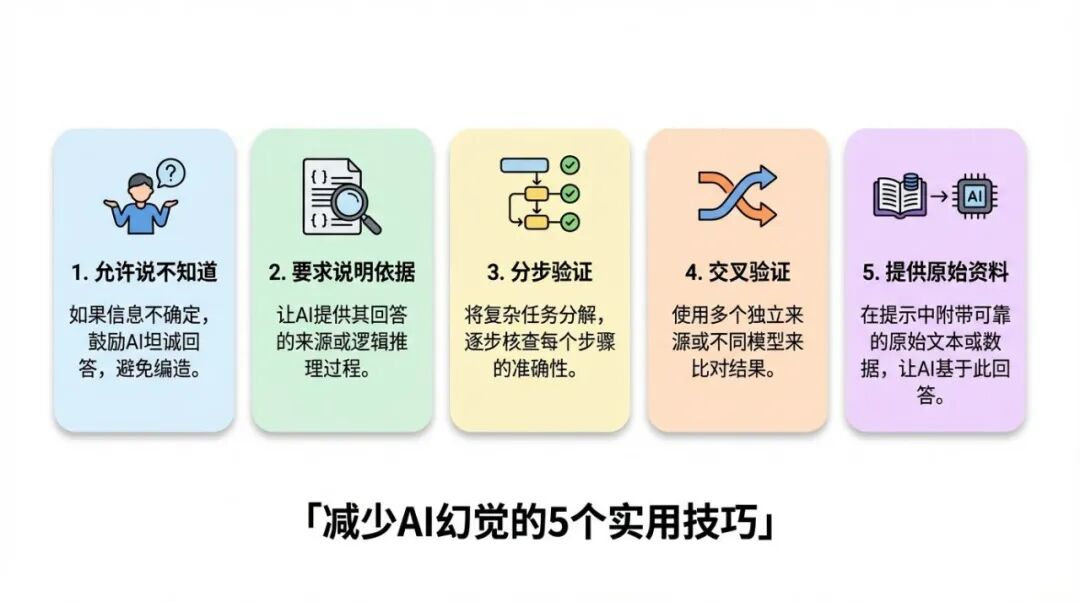

🔧 减少幻觉的 5 个实用技巧

1. 明确允许"不知道"

"如果你不确定,请直接说不确定,不要猜测"

2. 要求说明信息来源

"你的依据是什么?这个结论是基于什么推断的?"

3. 分步验证

先让 AI 给出推理过程,再让它得出结论,你可以在中间步骤发现错误。

4. 用已知信息交叉验证

先去验证 AI 说的一个你能核查的事实,再决定是否信任其他部分。

5. 提供参考资料,而非让 AI 凭空生成

❌ 容易幻觉

"帮我写一篇关于XX的技术文档"

✅ 更可靠

"基于以下资料,帮我整理成文档:[粘贴原始资料]"

🔗 和你工作的关联

🐛 Bug 分析

AI 给的根因分析要验证,不能直接采信

📋 测试用例生成

AI 可能编造不存在的接口参数,需要对照文档核查

📖 代码理解

让 AI 解释代码逻辑相对可靠,但让它猜测"为什么这样设计"要谨慎

🔍 告警分析

提供完整日志比让 AI 猜测更可靠,AI 给的方向要人工二次确认

📚 技术调研

AI 提供的技术方案框架可信,但具体 API 调用、版本号务必查官方文档

📌 一句话总结

AI 幻觉 = 模型在不知道答案时,仍然生成"听起来合理"的内容 识别高低风险场景 + 明确告知可以说"不知道" + 对关键信息交叉验证 = 安全用 AI 三板斧

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-03-30,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录