SKhynix:CXL内存扩展,以内存为中心的计算

SKhynix:CXL内存扩展,以内存为中心的计算

数据存储前沿技术

发布于 2026-04-02 10:56:34

发布于 2026-04-02 10:56:34

阅读收获

- AI推理加速:CXL扩展通道(2+1),高并发下吞吐提升30%,尤其Q2量化场景缓解带宽饥渴,指导LLM部署优化。

- 通用计算提效:SPEC CPU 2017基准中,内存敏感任务(如lbm_r)性能增33%,适用于HPC科学模拟,无需改动主板设计。

- 容量无损扩展:Redis工作集扩60%,YCSB压测吞吐稳定,降低TCO,实现单机大数据库承载。

- 池化实战验证:多服务器共享内存,Workload B/C下性能等同本地,破解云端内存碎片,提升利用率。

全文概览

在AI模型参数规模每两年暴增410倍,而GPU显存仅翻倍的“内存墙”下,传统服务器架构正面临严峻挑战:CPU通道数增至24+时,DIMM插槽被迫减至1个,单机容量扩展受阻,无法满足LLM推理、内存数据库等高负载需求。你是否曾为数据中心TCO居高不下而困扰?CXL(Compute Express Link)应运而生,作为PCIe-based的缓存一致性互联协议,它不仅支持单机带宽/容量扩展(如DRAM+CXL提升AI吞吐30%),还开启跨服务器内存池化时代。SK hynix、Samsung、Azure等巨头实测显示,CXL在Redis等IMDB场景下,池化内存吞吐媲美本地DRAM,推动服务器整合与资源高效利用。本文剖析CXL从单机补强到集群共享的全景,揭示其在AI/HPC/IMDB中的实战价值,帮助你洞察数据中心架构演进路径。

👉 划线高亮 观点批注

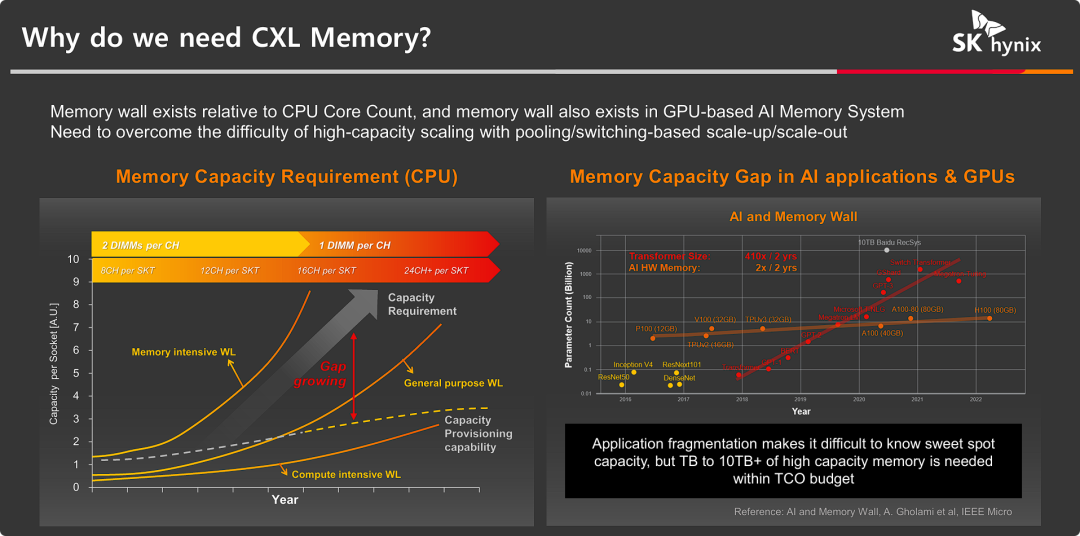

图片的核心在于论证传统内存架构在应对现代计算(尤其是 AI)时面临的瓶颈,并由此引出 CXL(Compute Express Link)内存的必要性。

- 传统架构的物理极限导致容量缺口: 随着 CPU 核心数增加,增加内存通道(Channel)会迫使每个通道的插槽(DIMM)数量减少,导致物理插槽容量扩展遭遇瓶颈,无法满足内存密集型业务的需求。

- 随着通道数(CH per SKT)从 8CH 增加到 24CH+,为了维持信号完整性,每个通道的插槽数从 2 DIMMs 减少到了 1 DIMM,这限制了内存容量的进一步堆叠。

- AI 模型演进速度远超硬件迭代: AI 模型的参数规模(每 2 年 410 倍)与 GPU 显存容量增长(每 2 年 2 倍)之间存在严重的非对称性。这种“内存墙”使单机内存容量成为制约大规模 AI 训练和推理的关键瓶颈。

- CXL 是打破内存瓶颈的必然路径: 传统的直接附加存储(DAS)模式已无法维持成本与容量的平衡。引入 CXL 内存,通过内存池化和交换技术实现海量容量扩展(TB 级以上),是降低 TCO 并满足高性能计算需求的唯一可行方案。

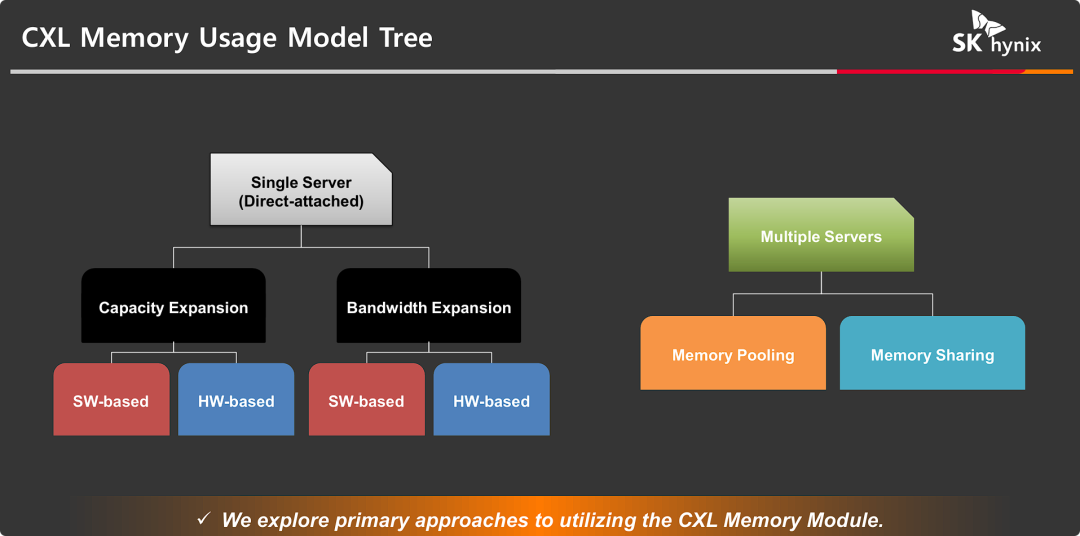

图片从逻辑架构层面展示了 CXL 技术在不同应用场景下的分类

- CXL 应用的双重定位: CXL 内存的使用模型被清晰地划分为“单机性能补强”和“集群资源池化”两大方向。前者关注单机的容量和带宽瓶颈,后者关注跨服务器的资源效率和协同。

- 单机扩展的灵活性: 针对单台服务器,CXL 提供了容量和带宽两种扩展维度,并支持从软件定义(SW-based)到硬件优化(HW-based)的不同实现层级,反映了 CXL 协议在现有系统中的兼容性与可演进性。

- 跨入资源池化时代: 图片右侧的“多服务器”分支预示了数据中心架构的演进趋势。通过内存池化(Pooling)和共享(Sharing),CXL 旨在打破服务器之间的内存孤岛,这是解决现代大规模工作负载(如大模型训练)成本问题的核心逻辑。

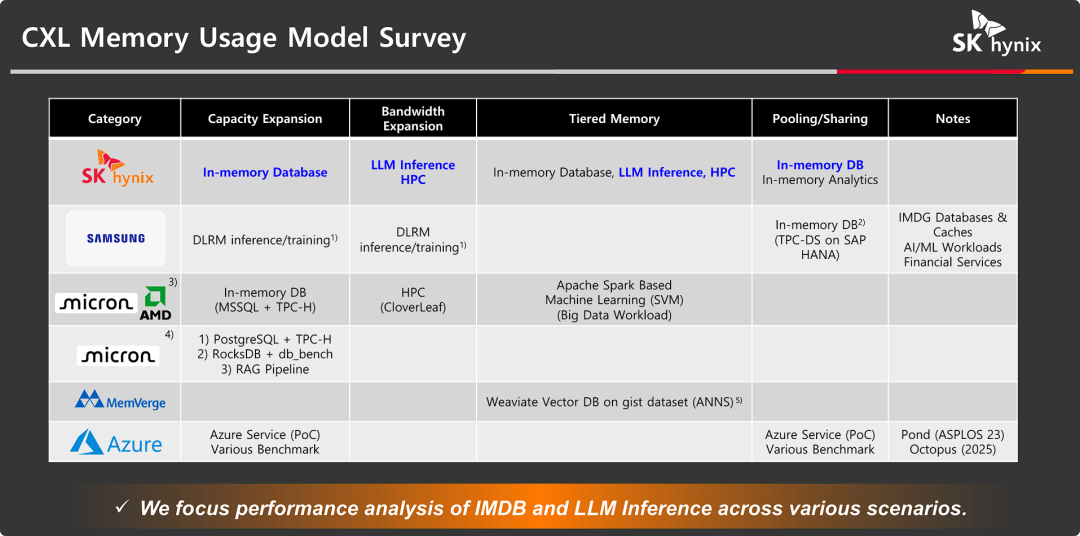

SK hynix、Samsung、Micron、MemVerge 和 Azure 等行业巨头对 CXL 技术的实际应用布局

- AI 与数据库是 CXL 的核心驱动力: 几乎所有头部厂商都将 LLM 推理、DLRM 和内存数据库 作为 CXL 落地场景的首选。这印证了前两张图片中提到的“内存墙”挑战在这些领域表现最为迫切。

- 技术应用从通用向垂直细化: CXL 的应用已不再局限于简单的“加容量”,而是深入到具体的软件栈(如 RAG 管线、向量数据库、Spark 机器学习)。这意味着 CXL 正在进入软硬结合的深度优化阶段。

- 云厂商推动池化架构落地: 以 Azure 为代表的云服务商正通过 Pond 和 Octopus 等项目,积极探索 CXL 内存池化在多租户环境下的商业可行性,目标是提升数据中心的整体资源利用率。

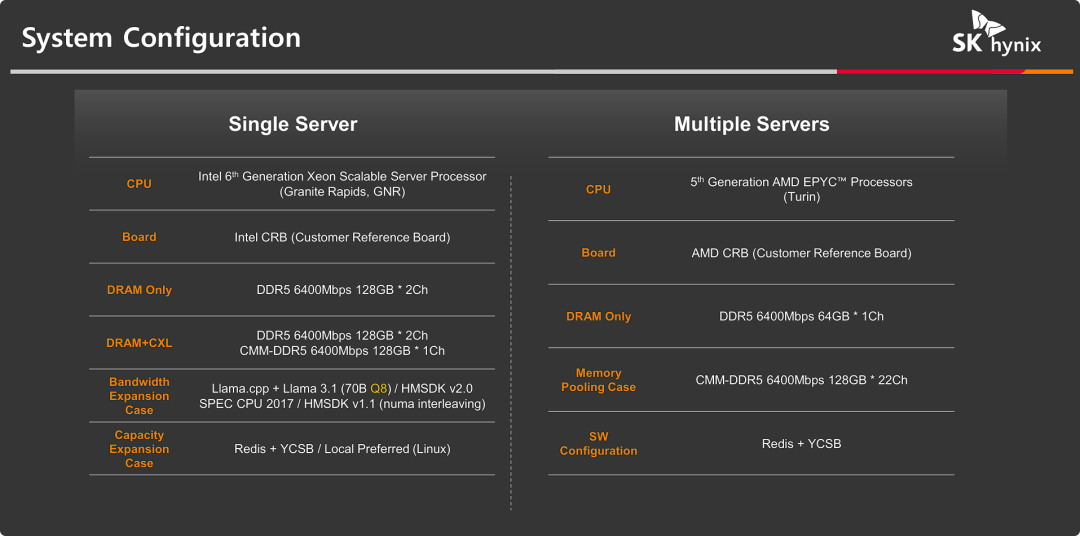

图表详细列出了 SK hynix 在进行 CXL 技术验证时所采用的具体硬件规格、软件环境以及针对不同用例的测试配置。它将实验环境划分为单服务器(Single Server) 和多服务器(Multiple Servers) 两个对照组。

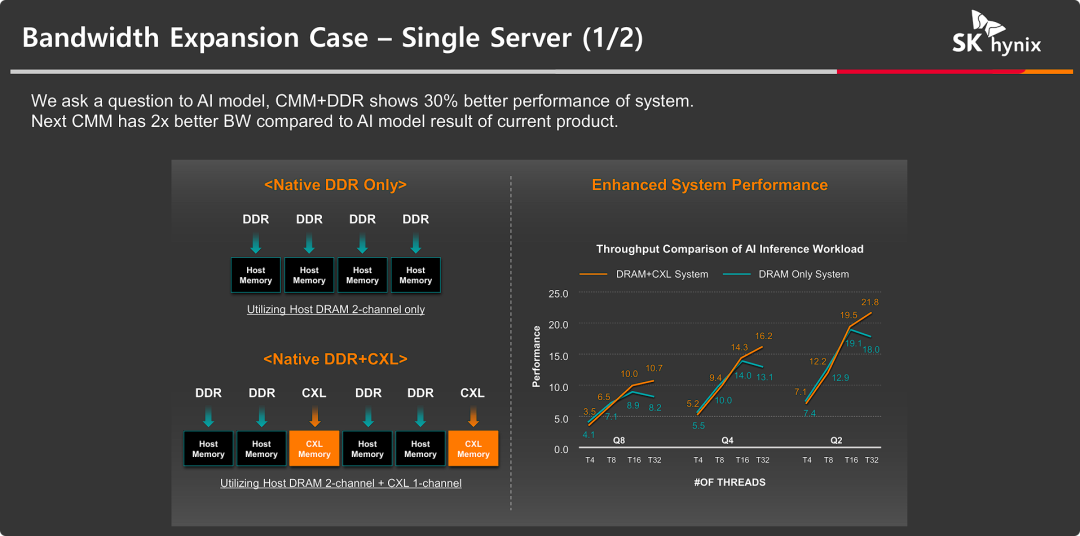

图片通过具体的 AI 推理(AI Inference)负载数据,展示了引入 CXL 内存模块后对系统整体吞吐量(Throughput)的显著提升

- 直接带宽增益转化为 AI 性能: 在单服务器中引入 CXL 内存,实质上是为 CPU 增加了额外的内存访问通道(从 2 通道扩展到 2+1 通道)。这种硬件层面的带宽补强直接转化为 AI 推理速度的提升,实测系统性能增益达 30%。

- 高并发下的优势更明显: 观察图表可以发现,随着线程数(Thread count)从 4 增加到 32,DRAM+CXL 系统与纯 DRAM 系统的性能差距不断拉大。这说明 CXL 内存能有效缓解高并发 AI 推理任务中的“带宽饥渴”问题。

- 对低比特量化更友好: 在 Q2 这种低比特量化场景下,系统对数据吞吐的效率要求极高。CXL 提供的额外带宽确保了即便在极高吞吐需求下,系统性能也不会过早遭遇瓶颈,为大语言模型(LLM)的快速响应提供了硬件支撑。

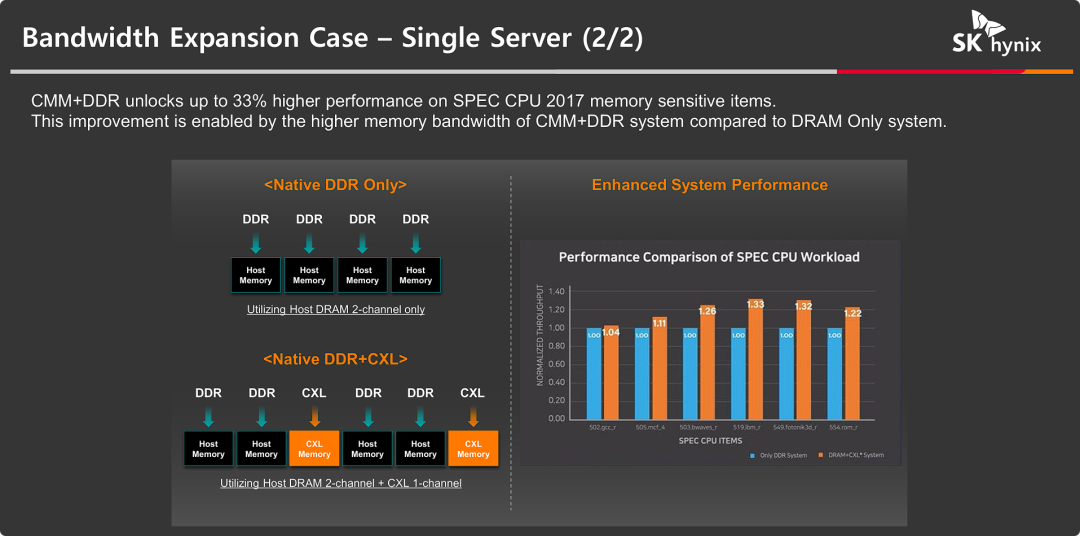

通过工业界公认的 SPEC CPU 2017 基准测试,展示了 CXL 内存对传统通用计算中“内存敏感型”任务的加速效果

- 通用计算同样获益: CXL 不仅仅是 AI 的“加速器”,对于科学计算、流体动力学(如

lbm_r)、气象预报(如fotonik3d_r)等传统高性能计算任务,CXL 带来的带宽补强同样能产生立竿见影的性能跨越。 - 突破单机带宽上限: 在不改变处理器插槽和现有 DDR 通道设计的前提下,通过 CXL 接口“借道”增加带宽,是解决服务器单机性能瓶颈的成本效益最优解。

- 负载敏感度差异: 测试数据表明,负载对内存带宽的依赖程度决定了 CXL 的增益幅度。对于

519.lbm_r这种极度渴求带宽的任务,33% 的提升意味着 CXL 可以将系统的计算潜力进一步释放,缩短任务完成时间。

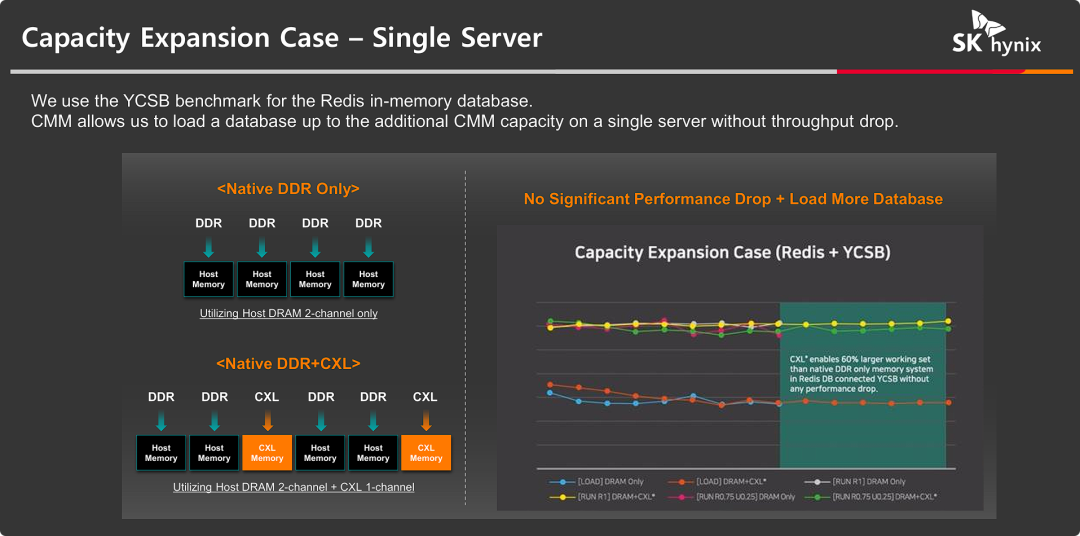

图片通过 Redis(一种主流的内存数据库)的实测数据,重点论证了 CXL 内存模块(CMM)在增加系统总容量的同时,如何保持系统的性能稳定性

- 打破单机容量天花板: 在传统的服务器架构中,内存容量受限于 CPU 插槽和主板设计。CXL 提供了一种几乎“无损”的扩容方式,实测可以轻松将 Redis 数据库的可承载工作集提升 60%。

- 性能损耗几近于零: 对于 Redis 这种典型的内存敏感型应用,虽然 CXL 内存的访问延迟理论上高于本地内存,但在多线程并发访问(YCSB 压测)的情况下,系统的整体吞吐量并未出现显著下滑。这意味着 CXL 能够作为有效的“扩展内存层”,完美平衡容量需求与性能表现。

- 优化 TCO 的新路径: 通过 CXL 增加低成本的大容量内存模块,而不是堆叠昂贵的高频原生 DDR 插槽,可以显著提升单台服务器的资源利用率,从而降低数据中心的总体拥有成本(TCO)。

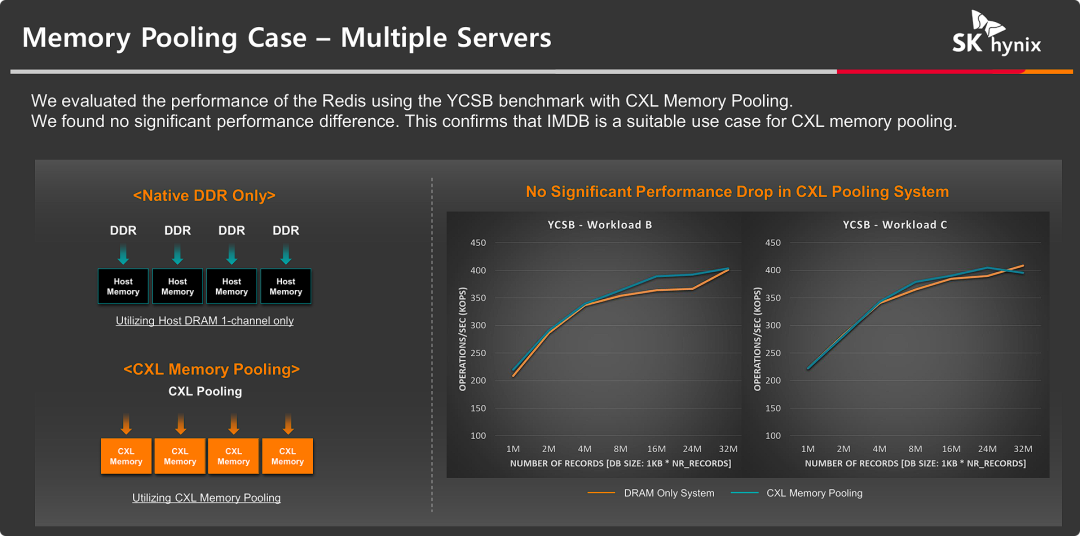

图片展示了 CXL 技术最核心的愿景之一:内存池化(Memory Pooling)。它证明了跨服务器共享内存资源在实际应用(如 Redis)中不仅可行,而且在性能上几乎可以媲美本地内存

- 性能损耗已不再是池化的障碍: 长期以来,业界担心跨节点访问池化内存会带来严重的延迟和性能下降。但实测表明,在 Redis 典型的读写负载下,CXL 池化内存的吞吐量表现与本地 DRAM 处于同一水平,这消除了池化技术商用化的主要顾虑。

- 使用了 YCSB Workload B(读多写少,通常比例为 95:5)和 Workload C(纯读操作)。

- 验证了内存数据库(IMDB)的适配性: Redis 等内存数据库对容量和性能极其敏感。CXL 池化技术能够在提供海量、弹性内存空间的同时,维持高并发处理能力,是解决云数据中心“内存碎片”问题的关键手段。

- 迈向“以内存为中心”的计算架构: 通过 CXL 实现多服务器共享内存,标志着数据中心正从传统的“单机独占内存”向“池化共享资源”转变。这不仅能显著提高内存利用率,还能让多台服务器协同处理超大规模数据集,而无需昂贵的数据搬迁。

幻灯片对 CXL(Compute Express Link)内存技术的价值主张进行了最终的提炼

- 从“性能补丁”到“架构重塑”: CXL 不仅仅是简单的带宽/容量补强工具,它通过“单机承载更大数据库”的能力,直接推动了数据中心的服务器整合(Server Consolidation)。这不仅是技术层面的进步,更是从资本支出(CAPEX)层面为客户提供了降低成本的方案。

- 全场景适配的成熟度: 总结强调了 CXL 在从高性能计算(AI/HPC)到互联网基础服务(IMDB/Redis)等多个维度的成功应用。这表明 CXL 协议生态已经趋于成熟,能够适应从高吞吐需求到海量并发访问的各种严苛环境。

- 内存池化迈向实战化: 重点提及“Memory Pooling”在 Redis 上的成功,再次确认了池化技术在解决“内存碎片化”问题上的卓越潜力。这是实现软件定义数据中心(SDDC)在内存层面的关键一环。

延伸思考

这次分享的内容就到这里了,或许以下几个问题,能够启发你更多的思考,欢迎留言,说说你的想法~

- CXL内存池化在多租户云环境(如Azure Pond)中,如何有效隔离安全风险并维持一致性性能?

- 面对CXL延迟略高于本地DRAM的现实,存储从业者应如何在软件栈(如RAG/Spark)中优化以最大化其AI/HPC价值?

- CXL单机扩展与池化模式下,产业链(如内存厂商与云商)并购趋势将如何重塑数据中心TCO格局?

原文标题:CXL Memory Use Cases: Insights into Expansion and Pooling[1]

Notice:Human's prompt, Datasets by Gemini-3-Pro

#FMS25 #CXL内存扩展 ---【本文完】---

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-03-28,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读