深度前瞻:GTC与OFC 2026双峰会来袭,千亿美金级AI光网络大时代全面开启!

深度前瞻:GTC与OFC 2026双峰会来袭,千亿美金级AI光网络大时代全面开启!

AI 男神说

发布于 2026-04-02 16:36:08

发布于 2026-04-02 16:36:08

算力的尽头,是网络。这绝不是一句空话。

当大模型的参数量以每年十倍的速度狂飙,单点计算能力的摩尔定律早已失效。如何将上万张、甚至十万张GPU连接成一个没有短板的超级大脑,成为了这场科技角逐的真正胜负手。

2026年3月,两场决定全球AI基础设施走向的顶级盛会将在同一周拉开帷幕——英伟达GTC 2026大会(3月16日至19日)与全球光纤通信大会(OFC 2026)。

在这个关键节点,市场被各种缩写词(CPO、NPO、LPO、OIO)裹挟,情绪高涨。但剥开这层喧嚣的迷雾,底层数据的真相往往有些反共识。穿透这些技术路线的表象,去算清每一张BOM(物料清单)里的成本结构,寻找技术跃迁与商业落地之间的“时间差”,才是捕获超额收益的唯一路径。

以下,是对当下AI网络市场最新动态的深度推演与拆解。

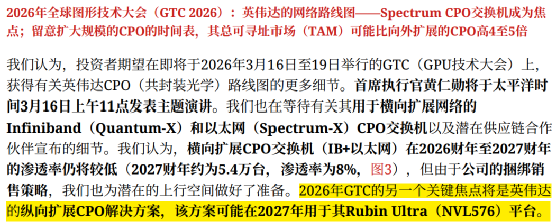

一、 破除CPO迷信:被高估的横向扩展,被低估的“千亿级”纵向突围

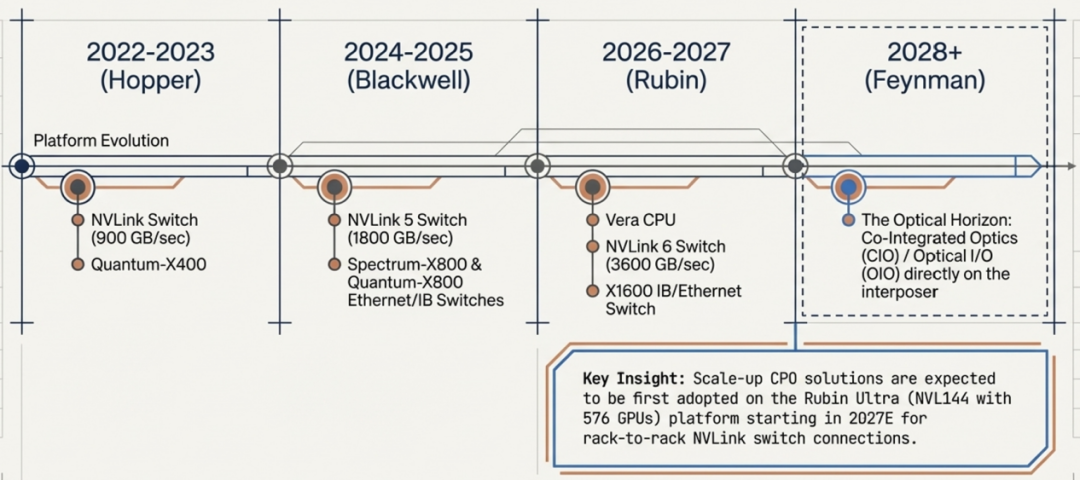

如果现在去问市场,光通信的未来是什么?十个人有九个会回答:CPO(共封装光学)。但绝大多数人并没有搞清楚,CPO的战场是被严格割裂为两块的:横向扩展(Scale-out,跨节点网络交换)与纵向扩展(Scale-up,节点内或机架间GPU直连)。

当前市场的聚光灯,几乎全打在了横向扩展的CPO交换机上,比如英伟达的Quantum-X和Spectrum-X系列。但真实的渗透率数据,却显得相当骨感。

在横向扩展网络中,2026至2027财年,CPO交换机(包含Infiniband和以太网)的渗透率将异常低迷。预计到2027财年,其渗透率仅为8%左右,对应出货量约为5.3万至5.4万台。

为什么走得这么慢?

因为这套方案目前实在太贵了。以一台配置4颗28.8T ASIC芯片的Quantum 3400 X800 CPO交换机为例,其内部塞进了72个1.6T的光引擎,光这72个引擎的物料成本就高达3.6万美元,占到了整机纯光学组件成本(8.32万美元)的43%。对于现阶段的云服务商而言,采用传统的可插拔收发器配搭电子交换机,在总拥有成本(TCO)上依然更具次优级的性价比。

但这是否意味着CPO是伪命题?

恰恰相反。真正的狂欢,藏在市场尚未完全定价的纵向扩展(Scale-up)之中。

大模型的张量并行计算,要求GPU之间进行近乎恐怖的无延迟数据交换。铜缆的物理极限已经被逼到了墙角,光进铜退在Scale-up层是不可逆的死板逻辑。 英伟达极大概率将在2027年推出的Rubin Ultra(NVL144,配备576个GPU)平台上,首次在机架间的NVLink交换机连接中采用Scale-up CPO方案。

数字对比极其震撼:到2030年,横向扩展CPO交换机的潜在可寻址市场(TAM)预计为235亿美元;而纵向扩展CPO的TAM,将如指数般暴增至1039亿至1040亿美元。这不仅仅是4到5倍的市场容量差距,更是从“可选方案”到“唯一解”的逻辑升维。

盯紧2027年这个时间窗口。谁能解决Scale-up CPO在3D封装、微环调制器(MRM)、光栅耦合器以及热管理材料上的良率难题,谁就能直接切走这块千亿美金蛋糕中最丰厚的一角。

二、 拆开BOM表找Alpha:价值链的残酷重塑

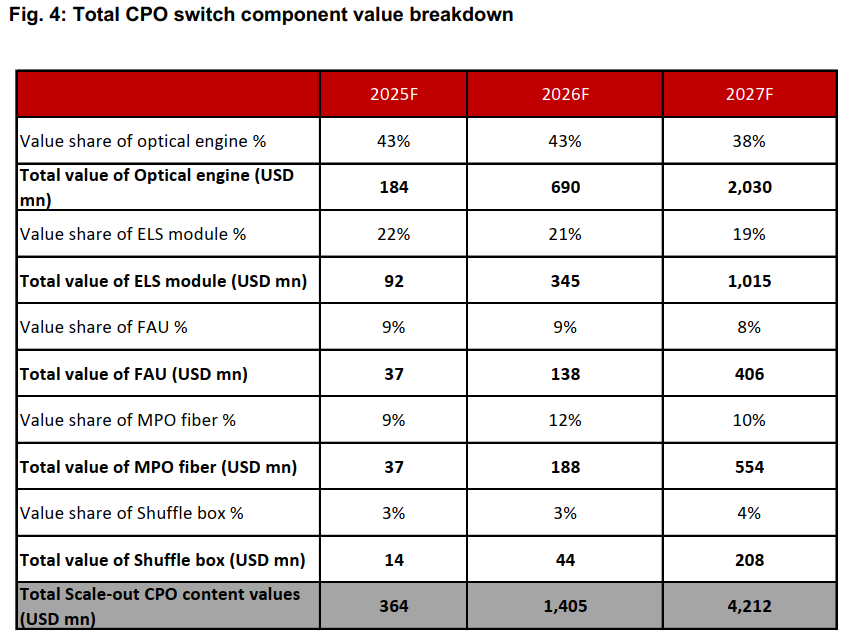

潮水退去,落后产能将被清洗。在CPO取代传统光模块的过程中,价值链正在发生剧烈的重构。如果按照2027年CPO交换机的预测物料成本来精细测算,价值的流向极其清晰。

在总组件价值中,光引擎(Optical Engine)和外置激光模块(ELS),价值占比分别约为38%和19%,总规模约10.15亿美元。

由于CPO将光引擎与高发热的交换ASIC贴在一起,传统光模块中内置的激光器根本承受不住这种高温烘烤,必须被移出封装体外,这就催生了对高功率连续波(CW)激光器的海量增量需求。

除此之外,极其考验对准精度和制造工艺的MPO多芯光纤与FAU(光纤阵列单元),将分别占据10%和8%的价值份额。

传统的光模块组装厂如果只有“拧螺丝”的能力,很快就会被踢出牌桌。未来的竞争是半导体晶圆级别的。我们看到台积电(TSMC)正凭借其COUPE(紧凑型通用光子引擎)技术,试图将电子芯片(EIC)与光子芯片(PIC)进行3D堆叠,试图掌控底层的制造标准。

但在下游,以中际旭创为代表的传统光模块龙头并未坐以待毙,他们正利用强大的供应链管控和制造成本优势,凶猛地切入CPO和NPO的价值链。技术的门槛固然高,但在规模化量产阶段,工程化落地能力和极端的成本控制才是更难被复制的护城河。

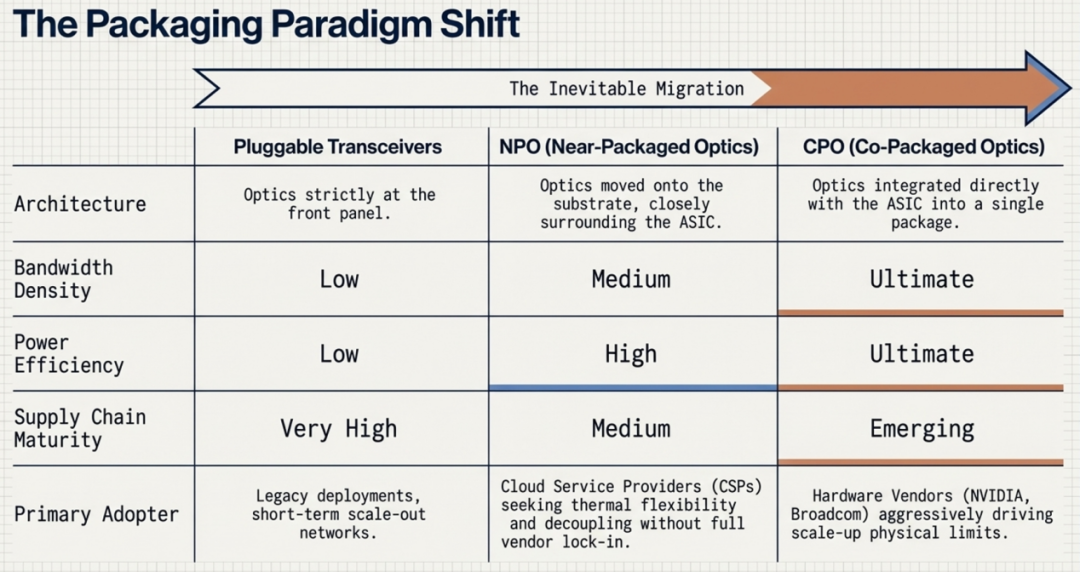

三、 巨头的身体很诚实:NPO与过度期的实用主义

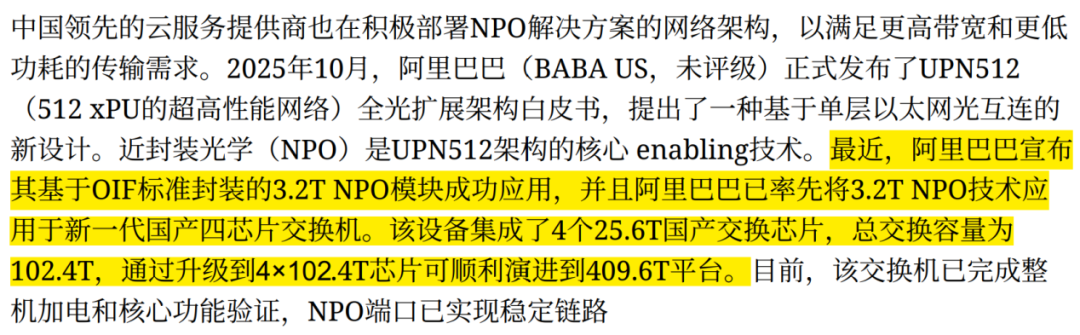

技术路线图总是画得宏大,但掏钱买单的云服务提供商(CSP)们,算盘打得比谁都精。在即将召开的OFC 2026上,一个不可忽视的趋势是:相比于激进的CPO,全球领先的CSP们在横向扩展网络中,仍然更偏爱NPO(近场封装光学)。

原因无他:供应链更成熟,系统容错率更高。CPO把光引擎和交换芯片彻底绑死,一荣俱荣,一损俱损;而NPO则退了一步,将光组件放在距离交换芯片几厘米的基板上。这几厘米的退让,换来的是极大的灵活性和维修便利性。

中国大厂在这条路上的狂奔尤为坚决。

2025年10月,阿里巴巴就发布了UPN512(支持512 xPU的超高性能网络)全光扩展架构白皮书,而NPO正是其核心的赋能技术。阿里甚至已经成功将其基于OIF标准封装的3.2T NPO模块,应用于总交换容量高达102.4T的新一代国产四芯片交换机中,并且进入了长期可靠性测试阶段。

投资有时候不需要去赌最性感的终局,而是去下注那些在通往终局的漫过渡期中,能够确切产生现金流的务实方案。

NPO,就是当前规模化落地的最大公约数。

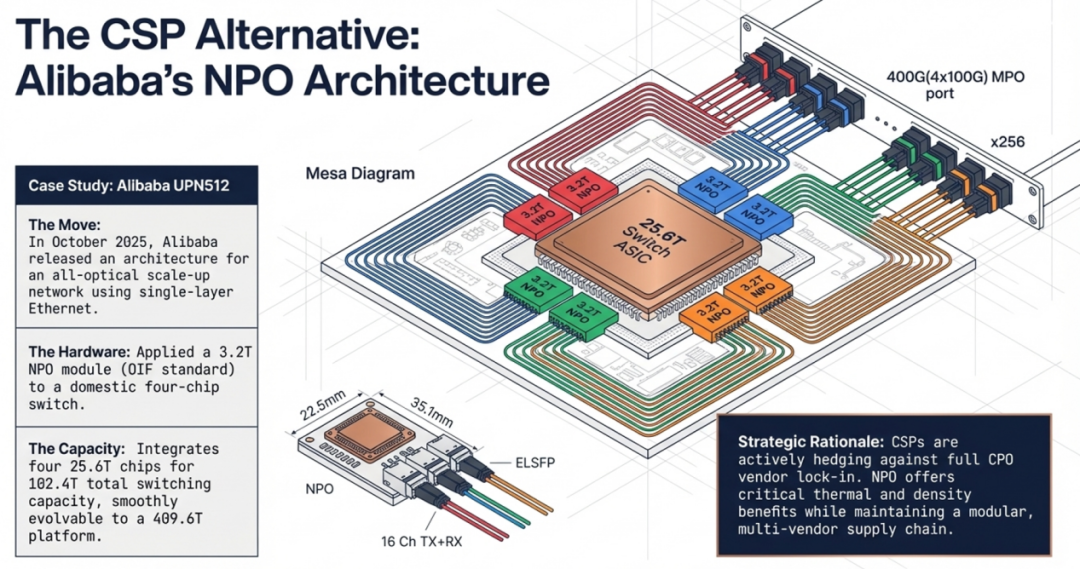

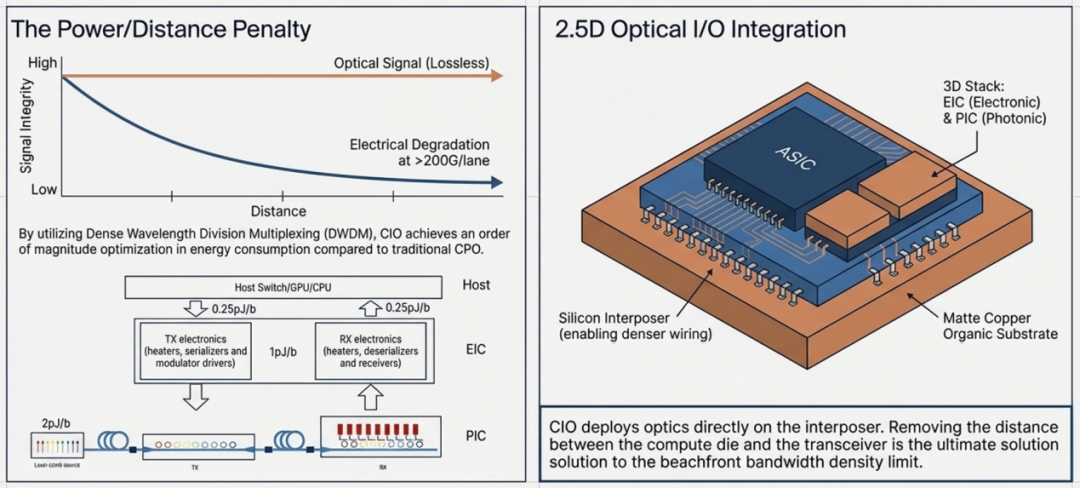

四、 物理极限倒逼材料革命:TFLN与OIO的终极形态

当单通道速率向200G甚至400G冲刺,传统的物理常数变成了最大的敌人。在3.2T可插拔光收发器时代,每通道400G调制器是核心命门。

长久以来,硅光子(SiPh)和磷化铟(InP)是行业的主力。但在单通道400G的极速面前,这两种材料的带宽瓶颈、损耗和线性度问题开始暴露。

此时,薄膜铌酸锂(TFLN)异军突起,正成为打破物理极限的关键材料。凭借超高带宽、极低的驱动电压和出色的热稳定性,TFLN被视为未来CPO和LPO大规模部署的必然选择。

POET Technologies与Quantum Computing Inc. 已经联手,目标在2026年下半年推出基于400G/通道 TFLN调制器的3.2T光引擎。在新材料导入期抢占先机,往往能获得最非理性的估值溢价。

如果把目光再放长远一些,到了2028年,英伟达的Feynman架构可能将引入一种更具颠覆性的形态——OIO(片间光互连)或CIO(共集成光学)。这是一种2.5D的集成方式,将光学器件直接部署在中介层上。结合DWDM(密集波分复用)链路架构,OIO能将能耗进行数量级级别的优化,从根本上打破传统电互连的带宽密度上限。

在GTC 2026上,如果黄仁勋针对OIO释放出任何具体的时间表,都将是一次行业级的地震。

五、 协议暗战与基础设施的全面军备竞赛

除了光组件本身,底层网络协议和交换芯片的较量同样血雨腥风。

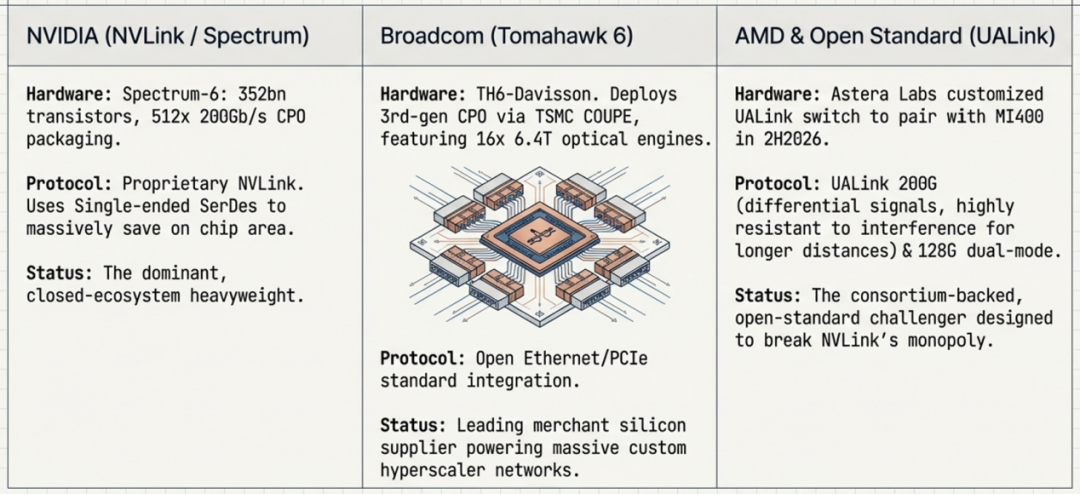

交换芯片方面,英伟达与博通的对决已进入白热化。英伟达将在2026年推出集成3520亿个晶体管的Spectrum-6以太网交换芯片,采用CPO封装,支持102.4Tb/s的横向扩展交换容量。博通(Broadcom)则亮出了Tomahawk 6-Davisson芯片,其内部集成了16个基于台积电COUPE技术的6.4T光引擎,单层就能支持512个XPU的连接。

更激烈的战场在互连协议。

英伟达的NVLink系统通过单端SerDes实现极高效的传输,在Vera Rubin NVL72中,单GPU的全对全带宽可达3.6 Tb/s。但天下苦“封闭生态”久矣,以AMD为首的联盟正在强推UALink协议。

UALink起初基于PCIe协议并引入以太网结构,其差分信号设计在长距离传输上抗干扰能力更强。AMD即将在2026年发布的Helios AI机架和MI400系列GPU,就将全线上马全新的UALink 200G协议。Astera Lab等第三方厂商也将在2026年下半年推出定制的UALink交换机芯片,旨在打破NVLink的垄断。两大阵营的割据,必然会为独立芯片设计公司和第三方光通信器件商撕开巨大的生存空间。

与此同时,连接这些庞大集群的底层毛细血管——光纤,也迎来了量价齐升的超级周期。

2026年1月,Meta与康宁签下了高达60亿美元的长期光纤电缆订单。在国内,仅2025年前11个月,三大运营商集采的G.654.E光纤就达到318万芯公里,同比暴涨25倍。针对AI计算特制的空芯反谐振光纤正在加速落地,亨通光电(600487 CH)计划新增的500万芯公里/年特种光纤产能,预计在2026年第一季度就能批量交付。

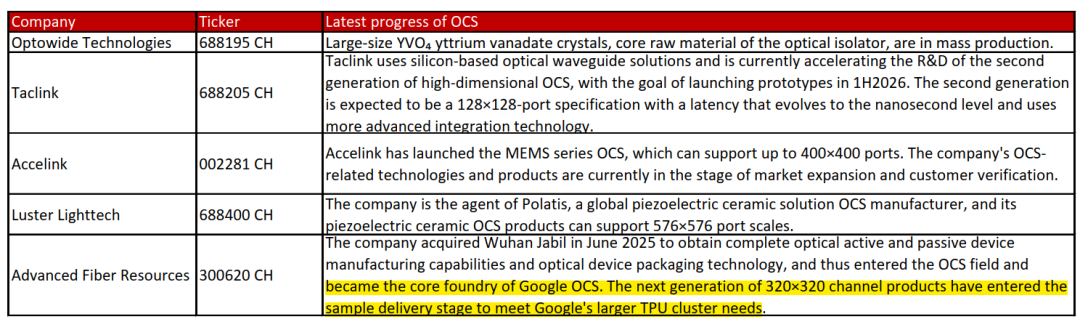

在动态的光路调度层面,OCS(全光交换技术)的商业化速度也远超预期。谷歌在TPU v7集群上对OCS的坚定应用,直接带飞了整条产业链。

中国的厂商反应极快,仕佳光子、太辰光(Taclink,目标2026年上半年推出128×128端口纳秒级产品)、光迅科技(支持400×400端口)以及深度绑定谷歌的光库科技(320×320通道产品进入送样阶段),都在疯狂抢夺这一增量市场。

结语

在这个被AI加速折叠的时代,算力基础设施的迭代速度令人窒息。从1.6T到3.2T,从可插拔到NPO到Scale-up CPO再到终极的片间互连OIO,资本的流动正在极其精准地寻找下一个瓶颈突破口。

当所有人都在为GPU的算力狂欢时,真正的聪明钱,已经在光纤的暗处悄然落子。在这场千亿美金的网络重构中,唯有深刻理解技术周期的错位与产业链价值的转移,才能在沸腾的泡沫中攫取真正的Alpha。

(备注:本文仅为深度拆解的冰山一角,关于CPO核心各组件的详细BOM成本测算模型、海内外核心标的估值对比及未公开的技术路线图演进细节,完整报告内容请去知识星球下载阅读。)

END

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-03-16,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读