别再说不懂零拷贝了!一文带你搞透这个让系统性能飙升的黑科技

别再说不懂零拷贝了!一文带你搞透这个让系统性能飙升的黑科技

悠悠12138

发布于 2026-04-02 16:52:43

发布于 2026-04-02 16:52:43

前段时间在公司做文件服务器优化的时候,发现传输大文件时CPU占用率特别高,内存也吃得厉害。后来研究了一下零拷贝技术,性能提升简直不要太明显!今天就来跟大家聊聊这个让无数程序员又爱又恨的零拷贝到底是个什么东西。

说起零拷贝,很多人第一反应就是"不就是不拷贝数据嘛",但实际上这个理解太浅了。我刚开始接触的时候也是这么想的,结果踩了不少坑。零拷贝的核心思想确实是减少数据拷贝次数,但它背后的原理和实现方式可比想象中复杂多了。

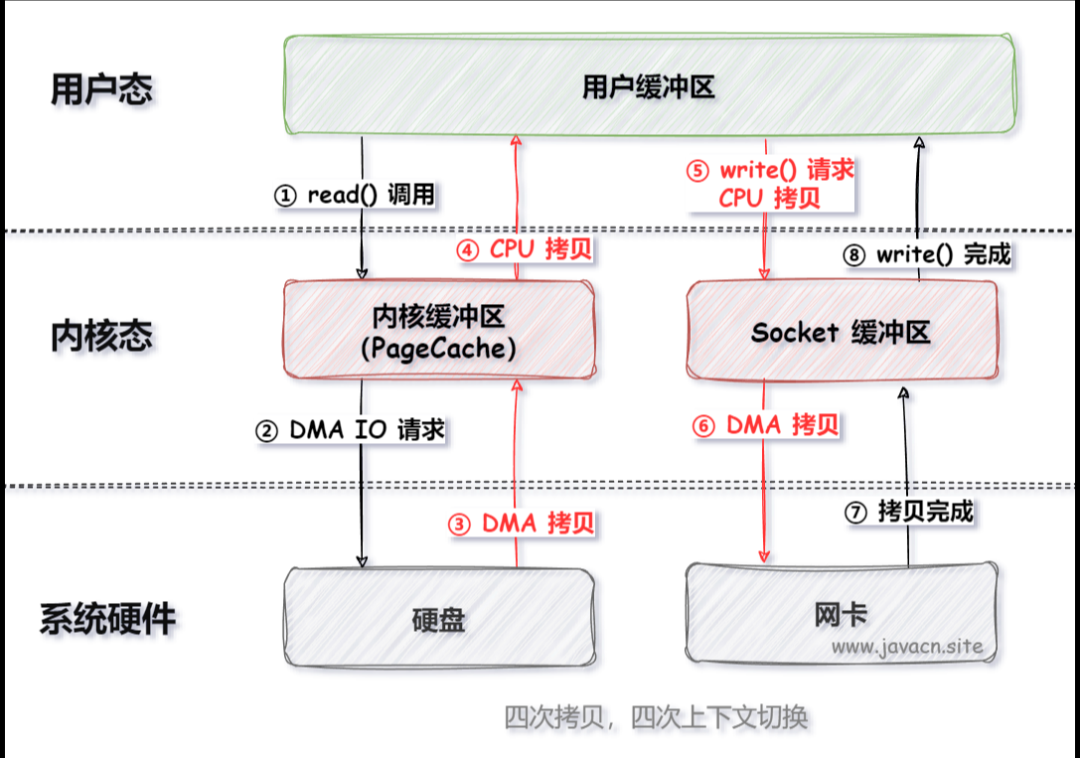

传统IO的痛点在哪里

我们先来看看传统的文件传输是怎么工作的。假设你要从磁盘读取一个文件然后通过网络发送出去,这个过程看起来很简单,但实际上系统内部发生了很多事情。

// 传统的文件传输代码

int fd = open("bigfile.txt", O_RDONLY);

char buffer[4096];

while((n = read(fd, buffer, sizeof(buffer))) > 0) {

write(sockfd, buffer, n);

}就这么几行代码,但数据在内存中却要经历好几次拷贝:

- 1. 磁盘 -> 内核缓冲区(DMA拷贝)

- 2. 内核缓冲区 -> 用户空间缓冲区(CPU拷贝)

- 3. 用户空间缓冲区 -> socket缓冲区(CPU拷贝)

- 4. socket缓冲区 -> 网卡(DMA拷贝)

这里面有两次CPU拷贝,而CPU拷贝是最耗费资源的。我之前在处理一个日志收集系统的时候,每天要传输几十GB的日志文件,光是这些拷贝操作就把服务器的CPU跑到80%以上。

更要命的是,数据还要在用户态和内核态之间来回切换,每次切换都有开销。想象一下,你在家里搬东西,本来可以直接从一个房间搬到另一个房间,结果非要先搬到客厅,再从客厅搬到目标房间,这不是浪费力气嘛。

零拷贝的几种实现方式

mmap + write:内存映射的巧妙应用

mmap是我接触的第一个零拷贝技术,它的思路很巧妙。不是直接把文件读到用户空间,而是把文件映射到用户空间的虚拟内存中。

void *mapped = mmap(NULL, file_size, PROT_READ, MAP_PRIVATE, fd, 0);

write(sockfd, mapped, file_size);这样做的好处是什么呢?数据不用从内核空间拷贝到用户空间了,因为用户空间直接访问的就是内核缓冲区的数据。拷贝次数从4次减少到3次:

- 1. 磁盘 -> 内核缓冲区(DMA拷贝)

- 2. 内核缓冲区 -> socket缓冲区(CPU拷贝)

- 3. socket缓冲区 -> 网卡(DMA拷贝)

我在一个图片服务器项目中用过mmap,效果还不错。但要注意的是,mmap有个坑,如果文件在映射期间被其他进程修改了,可能会收到SIGBUS信号导致程序崩溃。所以在生产环境中,一定要做好异常处理。

sendfile:直接在内核空间搬运数据

sendfile是Linux提供的一个系统调用,专门用于文件传输。它的思路更直接:既然数据最终要从文件传到socket,那就直接在内核空间完成这个操作,用户空间根本不参与。

#include <sys/sendfile.h>

ssize_t sendfile(int out_fd, int in_fd, off_t *offset, size_t count);

// 实际使用

off_t offset = 0;

sendfile(sockfd, filefd, &offset, file_size);sendfile把拷贝次数进一步减少到2次:

- 1. 磁盘 -> 内核缓冲区(DMA拷贝)

- 2. 内核缓冲区 -> 网卡(DMA拷贝)

注意这里没有CPU拷贝了!数据直接从内核缓冲区通过DMA传输到网卡。这就是真正的零拷贝,CPU基本不参与数据搬运工作。

我在优化一个视频流媒体服务器的时候用过sendfile,传输同样大小的文件,CPU使用率从70%降到了20%,效果相当明显。不过sendfile也有限制,它只能用于文件到socket的传输,而且不能对数据进行修改。

splice:管道的妙用

splice是Linux 2.6引入的系统调用,它可以在两个文件描述符之间移动数据,而不需要在用户空间和内核空间之间拷贝。

#include <fcntl.h>

ssize_t splice(int fd_in, loff_t *off_in, int fd_out,

loff_t *off_out, size_t len, unsigned int flags);splice最常见的用法是配合管道使用,可以实现更灵活的零拷贝操作。比如你想从一个socket读取数据然后写入到另一个socket,用splice就很合适。

DMA的重要作用

说到零拷贝,就不得不提DMA(Direct Memory Access)。DMA允许硬件设备直接访问内存,不需要CPU参与。在零拷贝中,DMA负责磁盘到内存、内存到网卡的数据传输,CPU只需要设置好传输参数就行了。

想象一下,你是一个工厂的老板,以前工人要亲自搬运每一箱货物,现在有了传送带(DMA),工人只需要按个按钮,货物就自动传输到目的地了。这就是DMA在零拷贝中发挥的作用。

实际应用场景和注意事项

什么时候适合用零拷贝

不是所有场景都适合零拷贝,我总结了几个适用的场景:

- 1. 大文件传输:比如文件下载服务器、视频流媒体服务器

- 2. 高并发的静态文件服务:比如CDN、图片服务器

- 3. 数据代理服务:比如反向代理、负载均衡器

我之前做过一个日志收集系统,每天要处理几TB的日志文件。最开始用的是传统的read/write方式,服务器经常因为CPU过高而响应缓慢。后来改用sendfile之后,同样的硬件配置下处理能力提升了3倍。

踩过的坑

零拷贝虽然好用,但也有一些坑需要注意:

文件大小问题:sendfile在某些系统上对文件大小有限制,超过2GB的文件可能需要分块传输。我就遇到过这个问题,传输大视频文件的时候总是传到一半就断了,后来才发现是这个原因。

网络拥塞:零拷贝减少了CPU开销,但如果网络带宽成为瓶颈,性能提升就不明显了。有一次我优化了半天,发现瓶颈在网络上,零拷贝的效果就不太明显。

错误处理:使用mmap时要特别注意SIGBUS信号,文件被截断或者磁盘空间不足都可能触发这个信号。

// 简单的信号处理

void sigbus_handler(int sig) {

printf("SIGBUS caught, file may have been truncated\n");

// 做一些清理工作

}

signal(SIGBUS, sigbus_handler);不同技术的性能对比

我在测试环境中做过一些性能对比,传输1GB文件的结果大概是这样的:

- • 传统read/write:耗时45秒,CPU使用率85%

- • mmap + write:耗时35秒,CPU使用率60%

- • sendfile:耗时25秒,CPU使用率30%

当然这个结果会因为硬件配置、网络环境等因素有所不同,但趋势是明显的。

实际生产中的应用

Nginx中的零拷贝

Nginx是零拷贝技术的重度用户,它在配置中提供了sendfile选项:

http {

sendfile on;

tcp_nopush on;

tcp_nodelay on;

}开启sendfile之后,Nginx在处理静态文件时就会使用零拷贝技术,这也是Nginx能够处理高并发静态文件请求的重要原因之一。

Java中的零拷贝

Java NIO也提供了零拷贝支持:

FileChannel fileChannel = new FileInputStream(file).getChannel();

SocketChannel socketChannel = SocketChannel.open();

fileChannel.transferTo(0, file.length(), socketChannel);transferTo方法底层就是使用的sendfile系统调用。

监控和调优

在生产环境中使用零拷贝技术,监控很重要。我通常会关注这几个指标:

- 1. CPU使用率:零拷贝最直接的效果就是降低CPU使用率

- 2. 内存使用情况:特别是使用mmap时要注意内存映射的大小

- 3. 网络吞吐量:看看是否真的提升了传输效率

- 4. 系统调用次数:可以用strace工具查看

# 监控系统调用

strace -c -p <pid>

# 查看网络统计

ss -i

# 监控内存映射

cat /proc/<pid>/maps总结

零拷贝技术确实是个好东西,但不是银弹。在合适的场景下使用,效果会很明显;如果场景不合适,可能效果就不那么理想了。

我的建议是,在做性能优化的时候,先分析瓶颈在哪里。如果是CPU在数据拷贝上消耗过多,那零拷贝就很有用;如果瓶颈在磁盘IO或者网络带宽上,那可能需要考虑其他优化方案。

实际使用中,sendfile是最常用的,因为它简单有效;mmap适合需要对文件内容进行随机访问的场景;splice则适合更复杂的数据流处理。

记住,技术没有好坏之分,只有合适不合适。零拷贝也是一样,在合适的地方用好了,就是利器;用错了地方,可能还不如传统方法。

希望这篇文章能帮到正在做性能优化的朋友们。如果你们在实际使用中遇到什么问题,欢迎留言讨论。毕竟技术这东西,光看理论是不够的,还得在实践中不断摸索和总结。

最后,如果觉得这篇文章对你有帮助,别忘了点赞转发,让更多的朋友看到。我会继续分享更多运维实战经验,帮助大家在技术路上少走弯路。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-03-27,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录