OpenAI 官宣联手博通!Sam Altman 亲自下场造芯,狂砸 10GW 算力冲刺 AGI

OpenAI 官宣联手博通!Sam Altman 亲自下场造芯,狂砸 10GW 算力冲刺 AGI

不二小段

发布于 2026-04-09 18:49:08

发布于 2026-04-09 18:49:08

重磅官宣!

AI 行业的「军备竞赛」再次升级,这次主角是 OpenAI。

就在刚刚,OpenAI CEO Sam Altman 与芯片巨头博通 (Broadcom) CEO Hock Tan 共同宣布了一项颠覆性的战略合作:

双方将联手部署高达 10 吉瓦 (GW) 的、由 OpenAI 亲自设计的定制 AI 加速器。

这是什么概念?

通常单个数据中心功耗通常在 100-200 兆瓦 (MW) 级别,1 GW 就已经是超大规模。而 10 GW 的电力消耗,足以驱动数十个乃至上百个这样的大型数据中心。

按照 Sam Altman 形容,这些 AI 基础设施建设,堪称「人类历史上最大的联合工业项目」。

更关键的信息是,这次合作不仅仅是买芯片,而是 OpenAI 亲自下场设计芯片和系统。

在 OpenAI 官方播客中,Sam Altman、Greg Brockman 与博通 CEO Hock Tan、半导体解决方案总裁 Charlie Kawwas 坐在一起,披露了这次合作背后的大量核心细节:

- • 全栈垂直整合:OpenAI 不仅设计芯片 (ASIC),还与博通共同设计整个机架系统,从晶体管蚀刻一直优化到终端用户看到的 token 输出。

- • AI 设计 AI 芯片:OpenAI 总裁 Greg Brockman 透露,他们已经开始用自家的 AI 大模型来辅助设计这款新芯片,并取得了「巨大的芯片面积缩减」,效率远超人类专家。

- • 明确的工作负载优化:这款定制芯片并非要取代通用 GPU,而是为 OpenAI 最核心、最确定的未来工作负载(尤其是推理)进行深度优化,追求极致的「每瓦智能」效率。

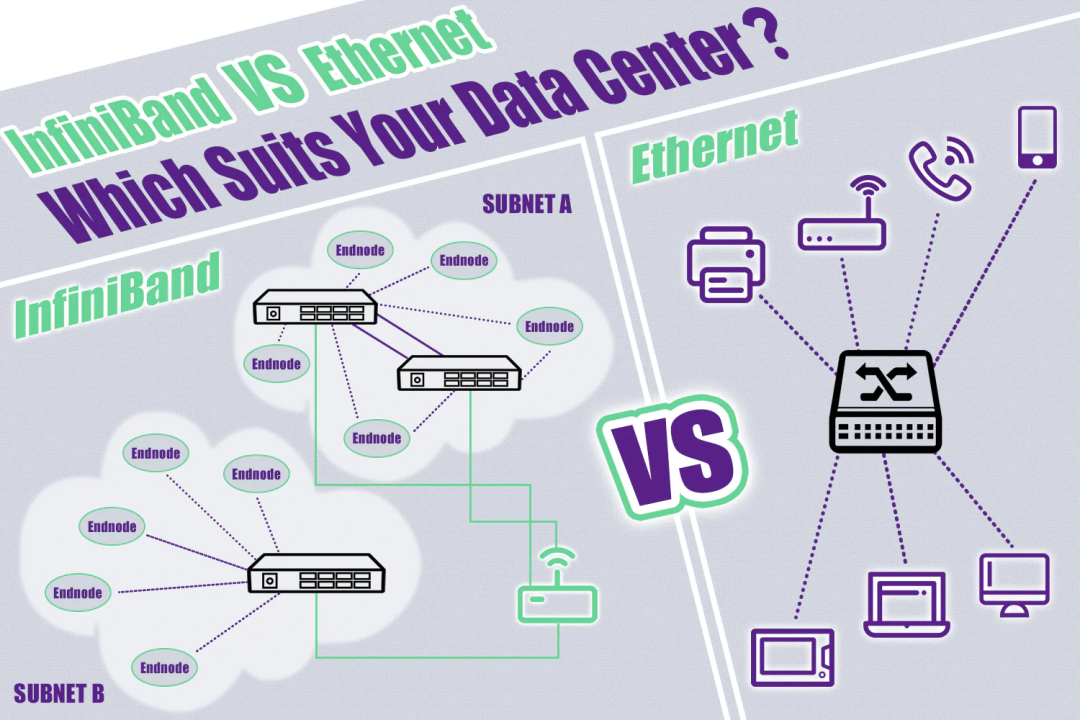

- • 开放的以太网生态:整个集群将完全采用博通的以太网解决方案进行横向和纵向扩展,而非目前主流的 InfiniBand。

- • 部署时间线:首批系统将于 2026 年下半年 开始部署,并在 2029 年底 前完成全部 10 GW 的部署。

这一消息,标志着继 Google (TPU)、Amazon (Trainium) 之后,全球最重要的 AI 公司 OpenAI 也正式加入了自研芯片的行列,并试图通过与半导体巨头的深度绑定,重新定义下一代 AI 基础设施的范式。

10 GW 算力联盟

首先,让我们看看这次合作的核心内容。根据公告,合作模式如下:

- 1. OpenAI 负责设计:OpenAI 将主导 AI 加速器和整个系统的架构设计。这意味着他们可以将过去数年在训练和部署 GPT 系列模型中积累的宝贵经验、对未来模型架构的预判,直接「写」进硬件里。

- 2. 博通负责开发与部署:博通作为全球顶级的半导体公司,将利用其强大的芯片开发能力、制造供应链和系统集成经验,将 OpenAI 的设计变成现实,并最终以完整的机架形态进行部署。

- 3. 全系统方案:合作范围远不止一颗芯片。它包括了博通端到端的以太网、PCIe 和光连接解决方案,是一个完整的、可大规模部署的「机架级」系统。

Sam Altman 在播客中反复强调「垂直整合」的重要性:

我们能够思考从蚀刻晶体管,一直到你向 ChatGPT 提问时最终输出的那个 token 的整个系统。通过对整个技术栈进行优化,我们可以获得巨大的效率提升,这将带来更好的性能、更快的模型和更便宜的模型。

这正是自研芯片的最大魅力所在。当算法和硬件不再是两个独立的团队隔着墙沟通,而是融为一体、协同设计时,优化的天花板将被彻底打开。

而 10 GW 这个数字背后,则是 OpenAI 对未来算力需求的惊人预判。

Sam Altman 透露,OpenAI 内部曾有过一个天真的想法:「我们只要优化 10 倍,就能解决所有问题了。」但现实是,「你优化了 10 倍,需求却涌来了 20 倍」。

从最初只有 2 MW 的小集群,到今年底将超过 2 GW,再到未来几年新增这 10 GW,OpenAI 的算力规模正在以指数级增长。Sam 认为,即便拥有了如此庞大的算力,只要模型质量持续提升、成本持续下降,世界对高质量智能的需求会「超高速地」将其吸收殆尽。

Greg Brockman 则给出了一个更长远判断:

为了实现我们让 AGI 惠及全球的愿景,10 GW 的算力还远远不够,那只是沧海一粟。

这不仅仅是为了满足 ChatGPT 数亿用户的需求,更是为了一个更宏大的未来——一个每个人都拥有 24/7 运行的 AI 智能体的世界。

Greg 设想,如果全球 80 亿人(未来可能是 100 亿)每个人都需要一个专属的加速器在后台为他们工作,那么人类距离「算力富足」还有极其遥远的距离。

让 AI 来设计 AI 芯片

如果说「10 GW」代表这次合作的广度,那么「AI 设计芯片」就是其深度的最佳体现。

Greg Brockman 介绍了更多细节。他表示,在与博通团队合作设计这款定制芯片的过程中,OpenAI 已经开始应用自家的 AI 模型设计芯片。

结果如何?

我们实现了巨大的芯片面积缩减。你将人类专家已经优化过的组件交给模型,投入大量算力,模型就能提出自己的优化方案。

Greg 举了一个例子:AI 模型提出的许多优化方案,事后人类专家复盘时会说,「是的,这个方案在我的待办列表上,但可能排在第 20 位,我可能需要再花一个月才能想到并验证它。」

AI 的介入,极大地加速了设计和优化的进程。在一个关键的截止日期前,团队甚至面临一个选择:是停下来分析模型给出的优化方案,还是相信模型、继续往前推进直到 deadline?他们选择了后者。

这标志着一个重要的范式转移:EDA (电子设计自动化) 正在从「自动化」走向「智能化」。AI 不再仅仅是执行人类规则的工具,而是成为能够自主发现和创造更优设计的合作伙伴。

这个「AI for Science」的经典案例,正在 OpenAI 内部形成一个强大的正向飞轮:

更强的 AI 模型 -> 设计出更高效的 AI 芯片 -> 更高效的芯片能训练出更强的 AI 模型。

这或许才是 OpenAI 投入巨大精力自研芯片的终极目的——打造一个自我加速、不断进化的智能创造引擎。

为何非要亲自造芯?

OpenAI 并非一开始就执着于算力。Greg Brockman 回忆道,公司成立之初,大家普遍认为通往 AGI 的路径是「想法」和「算法」,算力只是实现这些想法的工具。

转折点发生在 2017 年。

团队在训练玩视频游戏 Dota 2 的 AI 时,经验性地发现了一个惊人的事实:规模 (Scale) 本身就是通往更强智能的最有效路径。

我们发现,算力投入加倍,智能体的表现就能加倍。我们必须把这条路推到极致。

从那一刻起,OpenAI 开始密切关注整个芯片生态。他们与当时涌现出的各种 AI 芯片创业公司交流,向他们反馈未来模型对硬件的需求。

然而,结果却令人沮丧。

坦白说,很多公司根本不听我们的。你告诉他们未来的模型会是这样,但他们不相信。当你在一个可以看到未来方向,却无法影响他人路线图的位置上时,这是非常令人沮丧的。

这种挫败感,最终促使 OpenAI 决定「将一部分能力掌握在自己手中」。他们需要一种能够完全根据自己对 AI 未来的理解、为特定工作负载量身定制的硬件。

博通 CEO Hock Tan 对此表示了高度认同。他解释了不同工作负载对芯片设计的不同要求:

- • 训练 (Training):需要极高的计算能力 (TFLOPS) 和强大的网络互联能力,因为训练任务涉及海量的数据并行和模型并行。

- • 推理 (Inference):则更侧重于内存带宽和访存效率,因为需要快速响应单个用户的请求。

由此推测,OpenAI 这次设计的芯片,虽然没有明确表示,但从 Sam Altman 多次提到「服务全球用户的需求」和「降低成本」来看,其初期目标很可能高度偏向于推理负载。

这与通用 GPU 的设计方法形成了鲜明对比。通用 GPU 需要适应各种快速变化的研究需求,而定制芯片则可以专注于在一个已经相对成熟和确定的领域追求极致的效率。

正如 Sam Altman 所说:

我们将继续需要大量的 GPU,它们在快速研究中的灵活性是惊人的。但当我们对未来的形态越来越有信心时,一个为特定工作负载高度优化的系统,将能让我们从每瓦特电力中榨取出更多的智能。

控制自己的命运,这就是 OpenAI 亲自造芯最根本的答案。

为什么是博通?

在这场宏大的合作中,博通的角色同样至关重要。它不仅是芯片代工厂,更是 OpenAI 选择的技术合作伙伴和生态构建者。

1. 让定制芯片成为可能

Sam Altman 指出,在过去,像 OpenAI 这样的公司想要制造一款有竞争力的芯片是极其困难的,「困难到我们根本不会去想」。

而博通通过其领先的 IP、设计服务和供应链整合能力,极大地降低了定制芯片的门槛,使得非传统芯片公司也能参与到硬件创新中来。

Sam 开玩笑说:「不幸的是,他们也为我们所有的竞争对手这样做。但希望我们的芯片是最好的。」

2. 押注开放的以太网

一个值得注意的技术细节是,这次合作的 10 GW 集群将完全基于以太网 (Ethernet) 进行扩展。

博通半导体解决方案集团总裁 Charlie Kawwas 博士强调,定制加速器与基于标准的以太网扩展方案相结合,能够提供成本和性能最优化的下一代 AI 基础设施。

这在当前由英伟达主导的、以专有高速互联技术 InfiniBand 为主流的 AI 集群市场中,是一个非常重要的信号。以太网作为一个更加开放和标准化的技术,拥有更广泛的生态系统和潜在的成本优势。

也许通过 OpenAI 和博通的这次大规模部署,将会推动 AI 数据中心网络向以太网迁移的趋势。

3. 下一代硬件技术路线图

Charlie Kawwas 还透露了博通未来在 AI 硬件上的技术演进路线:

- • Chiplet (芯粒) 和 2.5D/3D 封装:通过将多个小芯片封装在一块基板上,突破单颗芯片的面积和性能极限。Charlie 提到,「我们正在将多个 Chiplet 封装在一个 2 倍光罩大小的空间里」。

- • 3D 堆叠:在垂直方向上堆叠芯片,进一步提升集成度和性能密度。「我们正在讨论将这些芯片堆叠起来,进入 Z 轴维度」。

- • CPO:将光学器件和交换芯片封装在一起,实现超高带宽、低功耗的片上光互联。Charlie 提到博通最新的 100T 交换芯片就集成了光学器件。

这些技术将共同推动 AI 集群的性能「至少每 6 到 12 个月翻一番」,为 GPT-6、GPT-7 乃至更遥远的 AGI 奠定硬件基础。

小结

最后总结一下,我们可以从 OpenAI 与 Broadcom 的这次合作中看到怎样的趋势:

- 1. 规模法则至上:AI 前沿的竞争,在很大程度上就是算力规模的竞争。

- 2. 垂直整合为王:顶级的 AI 公司将不再满足于只做软件,而是会深度参与硬件定义,通过软硬件协同设计来构筑护城河。

- 3. 定制芯片兴起:针对特定工作负载(尤其是推理)的定制 AI 芯片,将成为通用 GPU 的重要补充,甚至是主流选择之一。

- 4. 开放生态的胜利:以以太网为代表的开放标准,正在 AI 基础设施领域展现出强大的生命力。

这场 10 GW 的算力赌局,赌的是 OpenAI 对未来的判断:对 AGI 的追求,本质上是对近乎无限算力的追求。

正如播客中所说,他们正在共同定义「文明的下一代操作系统」。

他们不再仅仅是算力的消费者,更要成为算力的定义者和创造者。他们正在为自己,也为整个 AI 行业,铺设通往未来的基石。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-10-13,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录