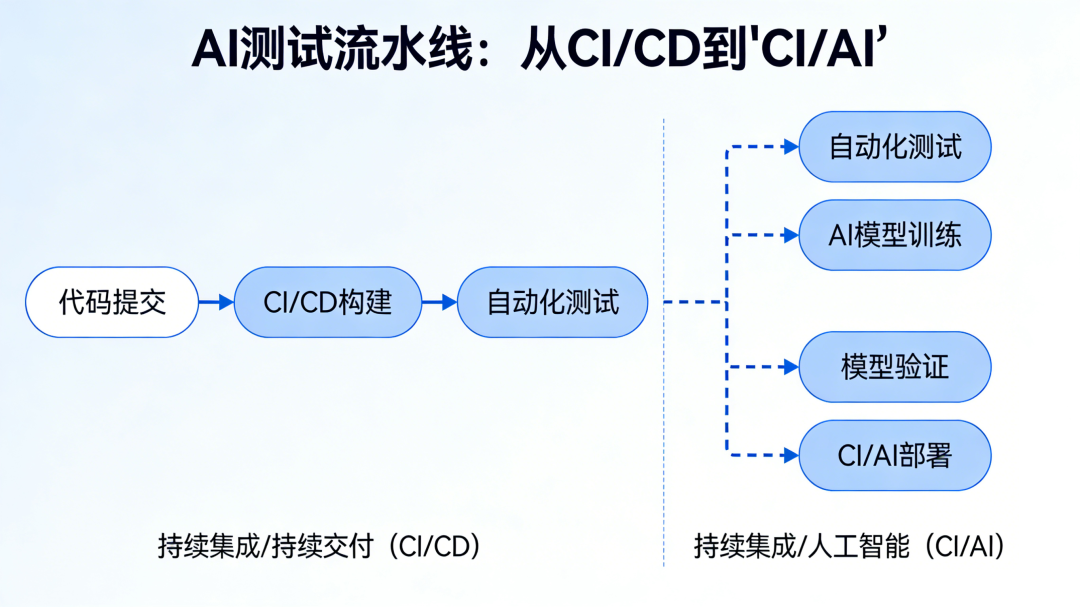

AI测试流水线:从CI/CD到"CI/AI"

AI测试流水线:从CI/CD到"CI/AI"

AI智享空间

发布于 2026-04-14 21:54:17

发布于 2026-04-14 21:54:17

CI/CD是现代软件工程最重要的基础设施共识之一。

自动构建、自动测试、自动部署——这套流水线将人从重复的发布操作中解放出来,让“每天多次发布”从奢望变成了行业标配。几乎所有有工程文化的团队,都把CI/CD流水线的成熟度视为团队能力的重要标尺。

但这条流水线正在遭遇一个越来越真实的瓶颈:测试环节正在成为整条链路上最慢、最脆、也最难扩展的部分。

测试套件越来越庞大,运行时间越来越长,误报率居高不下,维护成本持续攀升。工程师花在“修测试”上的时间,有时甚至超过了花在“写功能”上的时间。CI/CD承诺的高频发布,被测试环节的沉重负担拖慢了脚步。

AI介入测试流水线,正在提供一个重构这个瓶颈的机会。但这里存在一个必须厘清的关键分野:“在CI/CD中加入AI工具”与“构建真正的CI/AI流水线”,是两件本质不同的事。前者是工具叠加,后者是范式重构。工具叠加只能缓解症状,范式重构才能解决结构性问题。

本文将从以下维度展开分析:

- 瓶颈的本质:传统测试流水线为何越来越重

- 工具叠加与范式重构的分野:两种AI引入方式的根本差异

- CI/AI的核心能力层:智能化流水线的真实构成

- 信任与治理:自动化程度提升后的新挑战

- 迁移路径:从CI/CD到CI/AI的务实演进策略

一、瓶颈的本质:测试为何成了流水线的拦路虎

要理解CI/AI解决了什么,首先需要诚实地审视CI/CD中测试环节的结构性问题。

传统测试流水线的设计逻辑是静态堆叠:功能增加,测试用例增加;测试用例增加,运行时间增加;运行时间增加,反馈周期拉长;反馈周期拉长,发布频率下降。这是一个单向的恶化螺旋,几乎所有运行超过两年的测试套件都会陷入其中。

一个典型的团队痛点场景:某B端SaaS团队在产品运行三年后,完整回归测试套件的运行时间已经超过四小时。工程师不得不在每次提交后等待小时级的反馈,或者选择只运行部分测试——后一种选择埋下了无数缺陷逃逸的隐患。测试覆盖率在纸面上是85%,但实际上每次发布能被充分验证的功能范围,远低于这个数字。

问题的根源不在于测试用例写得不好,而在于静态的测试策略无法适应动态的代码变更。每一次代码提交,实际影响的功能范围是不同的,但测试套件无法感知这种差异,只能每次都全量运行。这是CI/CD时代测试环节最核心的结构性缺陷。

核心差异:传统流水线用静态覆盖应对动态变更,这是一场永远赢不了的军备竞赛。CI/AI的出发点,是让测试策略本身具备动态适应能力。

二、两种引入方式:工具叠加与范式重构的本质差异

当“AI测试”的概念出现时,许多团队的第一反应是:把AI工具接入现有流水线,让它辅助生成测试用例或分析测试报告。这是工具叠加的逻辑。

工具叠加式引入的特征是:AI被插入流水线的某个节点,作为一个独立的处理单元存在。它接收输入,产生输出,然后将结果交还给原有流程。流水线的整体结构没有改变,AI只是让其中某个步骤变得更快或更准。

这种引入方式的效果是真实的,但有限的。它解决了局部效率问题,却没有触及测试流水线的结构性缺陷——静态覆盖策略依然存在,全量运行依然是常态,反馈周期的改善也有天花板。

范式重构式引入的特征是截然不同的:AI不只是流水线中的一个节点,而是流水线的决策大脑。它持续感知代码变更的语义,动态决定每次运行应该覆盖哪些测试,实时评估测试结果的可信度,并根据历史数据调整未来的测试策略。

一家金融科技公司的演进轨迹可以说明两者的差距。第一阶段,他们引入AI工具自动生成测试用例,效率提升明显,但测试运行时间没有缩短。第二阶段,他们引入了变更影响分析能力,让AI根据每次代码提交的差异动态选择测试集——完整回归从四小时压缩到了25分钟,且缺陷发现率没有下降。第二阶段改变的不是测试工具,而是测试决策的主体。

核心差异:工具叠加让流水线的每个步骤更好,范式重构让流水线的决策逻辑更智能。前者是优化,后者是升维。

三、CI/AI的核心能力层:智能化流水线真正需要什么

“CI/AI”不是一个产品名称,而是一种流水线设计哲学。它需要几个核心能力层的协同支撑:

第一层:变更语义理解。能够分析每次代码提交的实际影响范围——不只是文件级别的diff,而是功能语义层面的影响图。哪些功能模块的行为可能被这次改动影响?这些模块对应哪些用户场景?这一层是动态测试决策的基础。

第二层:测试优先级动态排序。基于变更影响分析、历史缺陷密度和当前风险权重,实时对测试集进行优先级排序。高风险变更触发更深度的覆盖,低风险变更允许更快的轻量验证。这一层让“快”与“稳”不再是非此即彼的选择。

第三层:测试结果智能分析。能够区分真实缺陷与误报,识别测试结果中的异常模式,将重要发现自动提升优先级,将已知噪声自动过滤。工程师看到的不再是原始测试报告,而是经过智能筛选的质量信号。

第四层:策略自我迭代。基于测试结果反馈和缺陷逃逸记录,持续调整测试策略——哪些场景的覆盖需要加强,哪些测试长期没有发现问题可以降低频率。流水线会随着系统的成熟而变得更聪明。

这四层能力的协同,才构成真正意义上的CI/AI。缺少任何一层,都只是部分实现。

核心差异:CI/CD的流水线是静态配置的,CI/AI的流水线是动态学习的。前者的智能上限由配置时的设计决定,后者的智能下限由初始设计决定但没有上限。

四、信任与治理:自动化程度提升后的新挑战

当测试流水线的自动化程度大幅提升——AI决定测什么、怎么测、结果如何解读——一个新的管理挑战随之而来:你如何建立对这套系统的合理信任,同时避免盲目依赖?

这个挑战在CI/CD时代已经存在,但程度不同。传统流水线的行为是确定的,工程师能够追溯每一个步骤的执行逻辑。AI驱动的流水线的行为是概率性的,某些决策的依据不是明确的规则,而是训练数据和模型权重。

盲目信任型团队的典型特征是:看到测试通过就认为可以发布,不追问AI选择了哪些测试、为什么选这些、还有哪些没被覆盖。这种信任在大多数情况下是安全的,但在系统发生结构性变化或AI模型出现偏差时,可能产生严重的质量盲区。

主动治理型团队建立的是一套并行的信任校验机制:

- 定期的全量基准测试:不依赖AI的动态筛选,按固定周期运行完整测试套件,校验AI的覆盖决策是否遗漏了重要场景

- 缺陷逃逸溯源机制:每次线上缺陷发生后,追溯AI在该功能领域的测试决策,识别系统性偏差

- 覆盖决策的可解释性要求:要求AI提供测试集选择的理由,让工程师能够对不合理的决策提出异议

一个航空软件供应商的实践是值得参考的样本:他们为CI/AI流水线设置了一个“影子模式”——AI动态测试与传统全量测试并行运行,持续对比两者的发现结果。这个机制不只是校验AI的准确性,更是在逐步建立工程师对AI决策的理性信任。

核心差异:盲目信任让AI决策成为黑箱,主动治理让AI决策可审计、可校验、可迭代。信任需要被验证,而验证本身就是治理的核心。

五、迁移路径:从CI/CD到CI/AI的务实演进

对于大多数团队而言,“从CI/CD升级到CI/AI”不是一次性的架构替换,而是一个分阶段的能力演进过程。试图一步到位往往导致系统复杂度失控,反而延缓了价值的交付。

两种常见的错误迁移模式:

激进替换型:短期内将现有测试流水线大幅改造,引入多个AI能力层,系统复杂度骤增,工程师对新系统缺乏充分理解,问题排查困难,团队信心受损,最终在压力下退回到旧模式。

永久试点型:在一个子项目上试点CI/AI,取得不错的局部效果,但始终停留在试点阶段,未能形成全团队的能力迁移。试点成为了一个展示窗口,而不是一个演进起点。

成熟的分阶段演进路径大致遵循以下节奏:

- 第一阶段(建立可观测性):在现有流水线中增加测试数据的结构化收集——哪些测试运行时间最长、失败率最高、历史发现缺陷最多。这些数据是后续AI决策的训练基础,也让团队开始用数据语言理解测试

- 第二阶段(引入变更影响分析):将动态测试集选择作为第一个AI能力引入,这是投入产出比最高的起点,效果可见且风险可控

- 第三阶段(建立智能报告层):引入测试结果的AI分析,减少误报噪声,提升工程师对测试结果的信噪比

- 第四阶段(闭合反馈回路):将线上缺陷数据反馈到测试策略调整,让流水线具备自我迭代的能力

核心差异:激进替换追求一步到位,分阶段演进追求持续交付价值。前者把迁移本身当目的,后者把每个阶段的实际改善当成果。

结尾

那么,对于正在考虑“从CI/CD到CI/AI”演进的管理者,应该从哪里真正开始?

答案不是一个工具选型决定,而是一次思维方式的切换:从“我需要一个更好的测试工具”,切换到“我需要一套更智能的测试决策机制”。

前者的终点是买一个产品,后者的终点是建立一种能力。

几点具体的行动建议:

- 先做测试流水线的健康体检:统计当前测试套件的运行时长分布、误报率、历史缺陷发现率和维护成本。没有这份基准数据,任何AI引入都无法评估其真实价值。

- 从变更影响分析开始切入:这是CI/AI最高价值的第一步,也是风险最低的入口。能够动态决定每次运行哪些测试,比任何其他AI能力都更直接地改善发布效率。

- 为AI决策建立可解释性机制:要求流水线的AI组件提供决策依据,而不只是输出结果。可解释性是建立工程师信任的基础,也是发现系统偏差的前提。

- 将缺陷逃逸数据纳入流水线的评估指标:不要只用测试覆盖率或运行时间评估CI/AI的价值,要同步追踪线上缺陷中有多少是测试流水线本应发现而未发现的。这个指标才是流水线有效性的真实镜子。

CI/CD改变了软件发布的频率,CI/AI正在改变软件质量保障的智能程度。

这两次变革有一个共同点:真正受益的,不是最早开始的团队,而是最清醒地理解了“为什么要变”的团队。清醒先于行动,方向先于速度。工具会继续进化,但对工具背后逻辑的理解,始终是工程师和管理者最持久的竞争力。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-04-05,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录