帖子

文章

问答

帖子

文章

问答

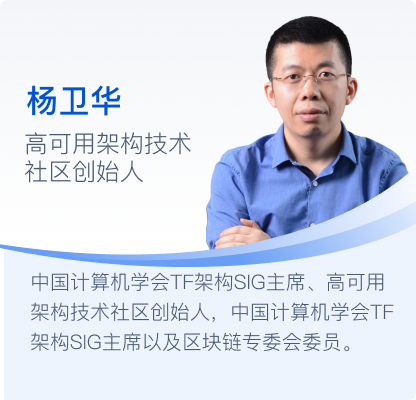

主席顾问团

Linux 内核社区最新合并的 coding-assistants.rst 首次正式规范了 AI 参与代码贡献,要求提交信息必须标注所用的模型与分析工具。该指南的核心原则是“人类必须负全责”,明确 AI 不得代替人类签署开发者来源证书,提交者需亲自审查代码并确认符合 GPL-2.0 协议。这种“不禁止、不鼓励、只追责”的做法在 Hacker News 上被评价为“正常得让人意外”,但也引发了关于 AI 生成代码若不受版权保护可能导致 GPL 无法执行的法律担忧。该规范暂未触及这一版权盲区,而是将风险直接留给提交者,标志着在 AI 能力向开发者日常工具链“外化”的趋势下,顶级开源项目的维护者而非 AI 公司,已经开始亲自下场制定游戏规则。

微软安全响应中心(MSRC)刚发了一篇博客,说他们用 Anthropic 的 Claude Mythos Preview 做漏洞发现和响应,效果比之前的模型有实质性提升。AI 能 7×24 扫

"实质性提升"。AI 能 7×24 扫描漏洞,速度和覆盖面远超人工。关键是他们没把这当噱头,而是直接嵌进了开发流程里——agentic red teaming,代码写完就扫,扫完就修。有个细节:这次模型是通过 Microsoft Foundry 上的 gated research preview 提供的,不是随便能用。你觉得 AI 做安全审计,离真正替代人工还有多远?

AI 是“降本神器”还是“背锅侠”。说“有了 AI 开发就没门槛”的,确实挺离谱;但要因此全盘否定 AI,也不客观。

它现在确实好用:写脚本、搭监控、起脚手架,效率提升很直接,能省不少时间。但一到核心架构或复杂逻辑,比如 WebSocket 流隔离、数据流拆分,AI 还是容易一本正经地给出跑不通的方案,甚至连测试命令都能编错。你省下的时间,往往又花在给它做 Code Review 和排坑上。现在又多了 openclaw 这类工具,门槛看起来更低了,但本质没变——工具再强,也只是工具。说到底,AI 更像个很强的“副驾”:能提速,但方向盘还得自己握着。不然真出事,背锅的还是你。

QClaw 搭多 Agent 配合 Skill 蒸馏,目前看已经过了纯“整活”阶段,具备了实用的业务价值。在私域社群运营或跑特定垂直领域的 SOP 时,把人物设定或专业黑话蒸馏成 Skill,能极大减少多 Agent 调用的上下文污染,做出来的 Bot 明显更有“内行感”。但实际落地的坑也很深:一是遇到复杂逻辑推演容易“降智”,因为蒸馏往往只学到皮毛,缺乏推理深度;二是极易过拟合,比如在严肃的架构讨论里突然触发群友的玩梗口癖,场面会极其尴尬。

个人感觉,这是解决 Agent 个性化与执行效率平衡的极佳思路。但想真正跑通,极其依赖前期数据清洗和微调的“脏活累活”。不愿意下这番苦功,这套方案再炫也只是个高级玩具。

AI发展日新月异,有时候还没学完的技能,就被新技术取代了。三月爆火的龙虾,到了四月又出新换Hermes Agent。有网友调侃,只要学的慢,就不用学。

难道AI这条路就没有一个可以学习的不变的框架体系吗?

回想起来,AI所需的工程能力还是那些,ReAct的思想框架相对稳定。我们仍在控制AI的记忆,幻觉

有没有小伙伴在用Pulumi来做基础设施即代码(IaC)管理的?最近考虑从Terraform转到Pulumi,主要想利用TypeScript来编写配置。不知道实际操作中,Pulumi的学习曲线和生产环境稳定性怎么样?能否分享一下使用心得或坑点?🛠️

OpenAI 这次把企业 AI 的方向说得很直白,不再只是给每个岗位塞一个 copilot,而是想把模型变成统一智能层,让 agent 跨系统、跨数据、跨工具协同,再叠一层 AI superapp。真正值得关注的不是功能多了多少,而是企业软件的组织方式可能要改了。以后比的也许不是谁先接入模型,而是谁先把权限、上下文和多 Agent 流程跑顺。大家觉得,企业 AI 下一步会先卡在技术,还是卡在组织改造?

Anthropic 这次在 Google Cloud Next 预告里,把重心直接放在 long-running agents、多 Agent 架构和 evals,我觉得这很说明阶段变了。行业已经不只是比模型跑分,而是开始比任务能跑多久、上下文怎么拆、子代理怎么验证、回归怎么做。对开发团队来说,下一轮差距可能不在 prompt,而在整套 Agent 工程能力。你觉得今年最该补的是模型能力,还是评测与编排?

🚀【科技热点】

Gemma 4发布四款模型并采用Apache 2.0全面开源,最小的E2B仅激活2B参数即可在手机和树莓派上完全离线运行,支持128K上下文和多模态输入。

31B Dense版在AIME 2026数学推理上从20.8%跃升至89.2%,代码能力从29.1%升至80.0%,Agent工具调用从6.6%提升至86.4%。

E2B的2B参数手机模型在GPQA Diamond上达到43.4%,已追平上一代Gemma 3 27B桌面模型的42.4%,实现单位参数智能密度的突破。

开源地址:https://huggingface.co/google/gemma-4-31B-it

川普风格评论:

这波发布很聪明,真的聪明。

开源、分层规格、从手机到服务器全覆盖,这叫把市场每个入口都拿下。

最关键不是“参数多大”,而是“谁在用、在哪用、多久能用起来”。

如果你让开发者今天就能跑,明天就会有生态,后天就是你的地盘。

高性能计算圈可能要变天了。NVIDIA 收购 SchedMD,最值得关注的不是并购本身,而是 Slurm 这种几乎成了 AI/HPC 集群默认调度层的基础软件,后面会不会更深地和 GPU、网络、系统栈绑在一起。对企业来说,这也许能换来更顺滑的一体化体验;但对多云、异构算力和开源中立性来说,反而可能埋下新的锁定风险。大家觉得,调度层和硬件栈越绑越紧,会让 AI 基础设施更高效,还是更封闭?

技术同盟成员

更多 >活动日历

线上直播

线下沙龙

线下沙龙

线上直播

线下沙龙

线下沙龙

线下沙龙

线下沙龙

线下沙龙

线下沙龙

线下沙龙

线下沙龙

线下沙龙

提问已提交,平台将在审核通过后自动邀请对方回答

您可前往问题详情页查看问题进展 查看详情>